任务中的眼动追踪

描述

在任务编辑器的左上侧面板中,点击“编辑”旁边的物理信号菜单以打开它并访问任务的眼动追踪设置。

![]()

要在任务中启用眼动追踪,请勾选“在此任务中启用眼动追踪”复选框。在研究开始之前,参与者将被提示选择他们想要使用的网络摄像头,以便于选择连接的外部摄像头或内置系统。主要的眼动追踪校准将在启用眼动追踪的第一个任务开始之前自动进行。此外,如果您为此任务启用眼动追踪,则将在每次试验之前检查头部姿势。

使用复杂形状作为遮罩和AOI的SVG和多边形

作为设计过程的一部分,您可能希望考虑利用SVG和多边形 形状对象 来创建可以作为遮罩或AOI的复杂形状。SVG可以上传到Labvanced,而多边形可以直接在应用编辑器中绘制。这两个选项允许您创建复杂形状/区域,然后将它们作为您在Labvanced中进行眼动追踪实验的基础。

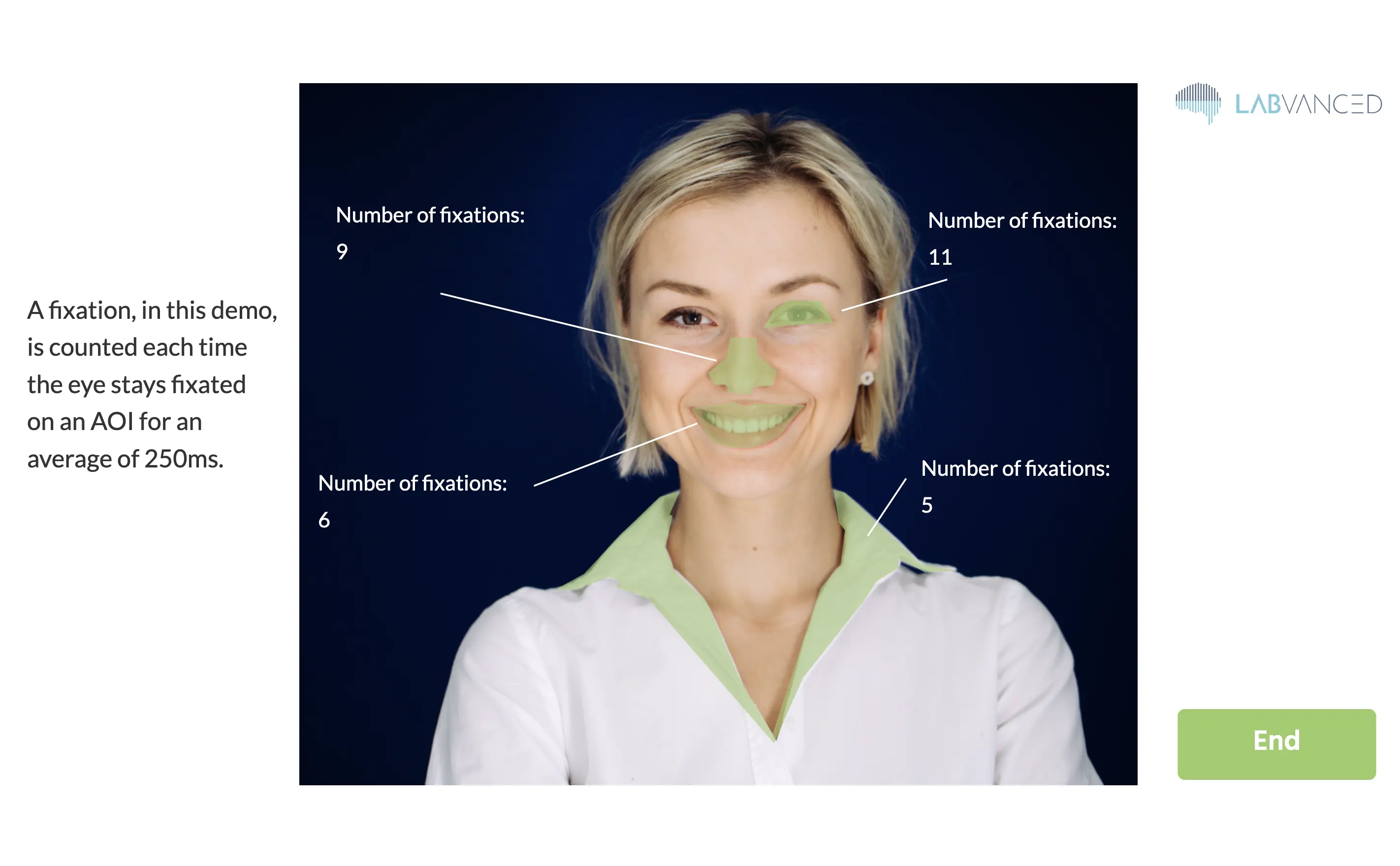

例如,您可以实现多边形形状作为“触发器”,以便每当参与者注视其时,计算那些注视的变量就会增加一个!您可以在这里查看如何设置:https://www.labvanced.com/page/library/61117,点击“检查”并打开任务以查看结构,或点击“参与”以参加。下面的图片显示了演示的结果。

请注意,在上述演示中,使用了最快的校准设置(大约1分钟),以便您能够快速通过实验。

试验间注视

在任务的眼动追踪设置中,您可以定义在试验之间显示的注视次数。这些试验间注视具有以下目的:

- 它们用于计算每个试验之前眼动追踪的准确性。

- 如果您启用“每次试验漂移校正”,则漂移将被计算为显示的注视点与预测的注视位置之间的中位数差异。此后的每次试验中的每个注视预测将根据此预估偏移自动修正。

录制眼动追踪

以下是录制注视位置 [X,Y] 坐标时间序列的推荐方法。

- 创建一个触发器为“眼动追踪”的事件,每次预测到新的注视位置时会自动执行。

- 要录制新的注视位置,请添加动作“设置/记录变量”。在此动作的左侧,创建一个新的记录变量以存储注视位置。

- 为了存储一对x和y坐标,最好选择格式为“数组”。

- 如果您想记录随时间变化的所有注视位置,则将记录类型切换为“所有变化/时间序列”。

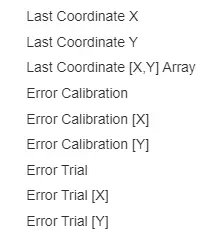

- 在动作的右侧值选择菜单中,从“眼动追踪”子菜单中选择“最后坐标[X,Y]数组”(见图)。

结果记录的注视坐标将以用于在您的框架上定位元素的设计单位为单位,这样您就可以轻松地将坐标与您的刺激位置关联。

数据输出

每个注视数据记录4个基本值:

- X:框架单位中的x(水平)位置

- Y:框架单位中的y(垂直)位置

- T:注视的精确/修正时间戳

- C:注视检测的置信度(0表示眼睛闭合或没有脸/眼睛可见,1表示100%置信度)

眼动追踪的准确性

请注意,预测的注视坐标的准确性因不同的受试者及其相应的环境(即光照和相机)而异。因此,我们提供了预测误差的估计。这些估计误差可以在“设置/记录变量”动作的值选择菜单中访问。误差值是预测的注视坐标和显示的目标注视位置之间的平均欧几里得距离。除了这些欧几里得距离外,还有仅对水平([X])或垂直([Y])误差分量的误差估计。误差值有两种类型:

- “误差校准...”值是使用在初始校准期间捕获的注视的验证集计算得出的。

- “误差试验...”值是使用试验间注视计算得出的。