Déclencheur OpenAI

Aperçu

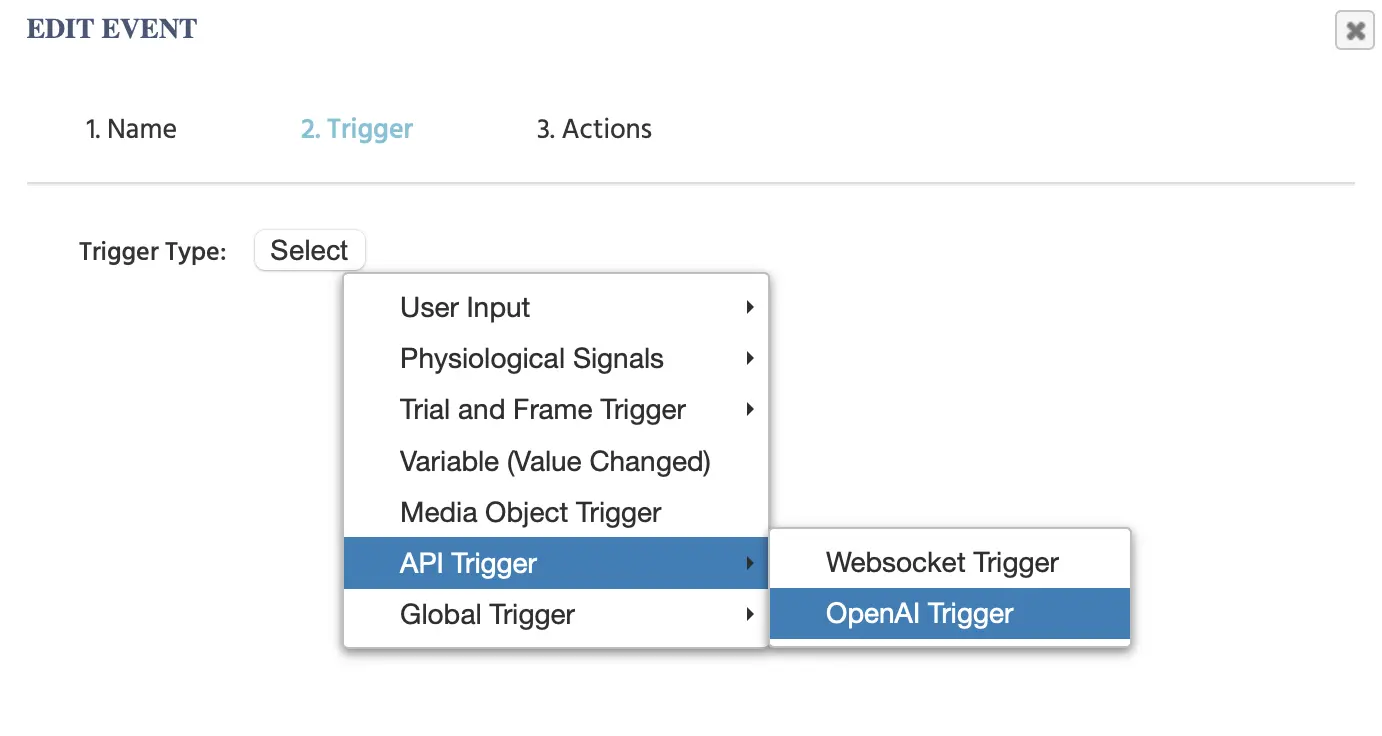

Le Déclencheur OpenAI (répertorié sous API Triggers dans le menu principal) peut être utilisé pour initier une action basée sur des informations entrantes d'OpenAI. En utilisant ce déclencheur, vous pouvez spécifier quel type d'informations entrantes sera utilisé comme déclencheur, telles que des réponses basées sur du texte, des images ou de l'audio, via la sélection d'un des différents Model Types répertoriés.

REMARQUE : Pour que cette option soit disponible, vous devez d'abord lister votre clé API dans l'onglet Settings.

Sélectionner cette option affichera les paramètres suivants :

Types de Modèle Disponibles

En utilisant le menu déroulant Type de Modèle, les options suivantes sont disponibles :

| Type de Modèle | Description |

|---|---|

ChatGPT | Réponses entrantes basées sur du texte d'OpenAI |

Génération d'Image | Réponses basées sur des images entrantes |

Générer de l'Audio | Réponses basées sur de l'audio entrantes |

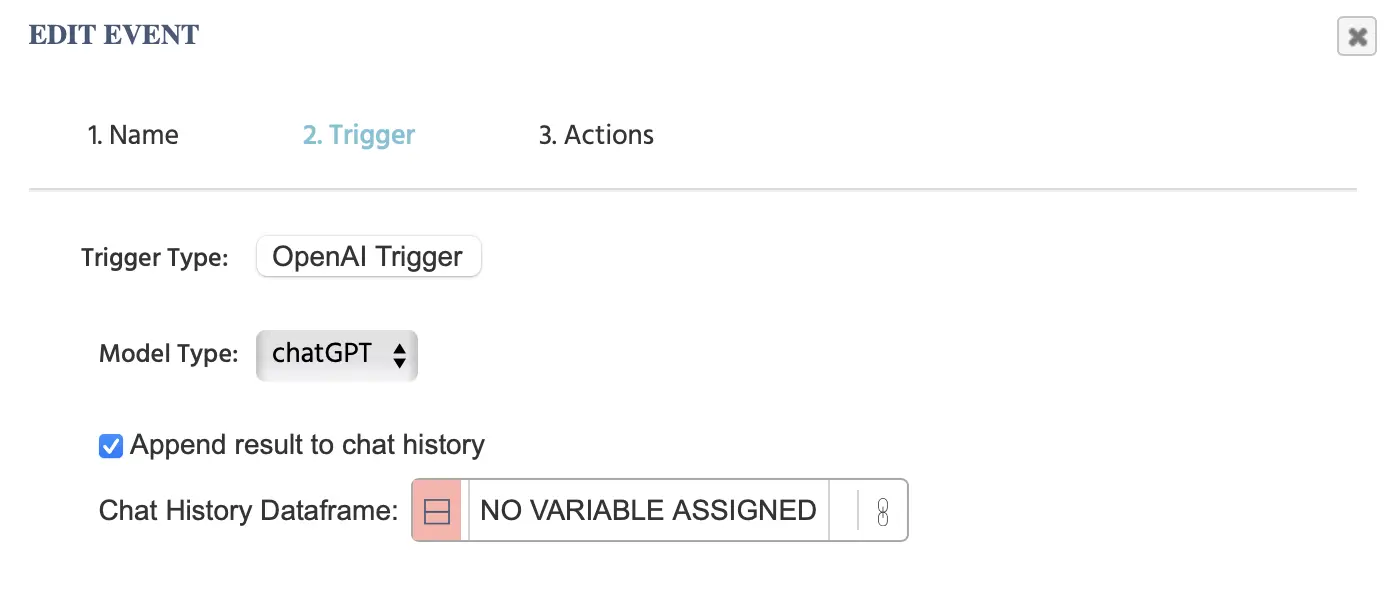

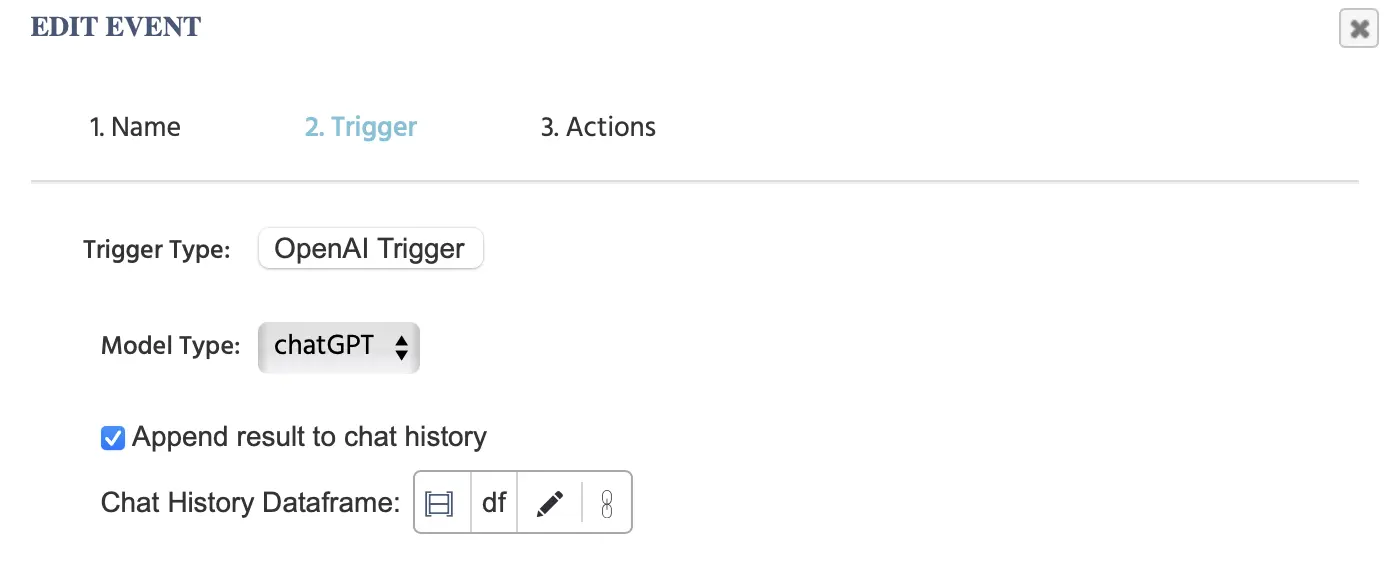

Type de Modèle ChatGPT

Dans l'exemple ci-dessous, le cadre de données qui a été assigné s'appelle ‘df’ et le résultat du ‘Déclencheur OpenAI’ sera ajouté à ce cadre de données. Ce cadre de données doit avoir deux colonnes. La première colonne désignera le ‘rôle’ et la deuxième colonne le ‘message de chat.’ Les valeurs de l'action seront automatiquement ajoutées au cadre de données qui est lié ici.

REMARQUE 1 : Si vous utilisez également l’action ‘Envoyer à OpenAI’, alors vous devez utiliser le même cadre de données que vous avez indiqué ici.

REMARQUE 2 : Référez-vous également à ce didacticiel où nous construisons une étude étape par étape, intégrant ChatGPT pour une étude texte-à-texte avec un chat et utilisant ces options de déclencheur.

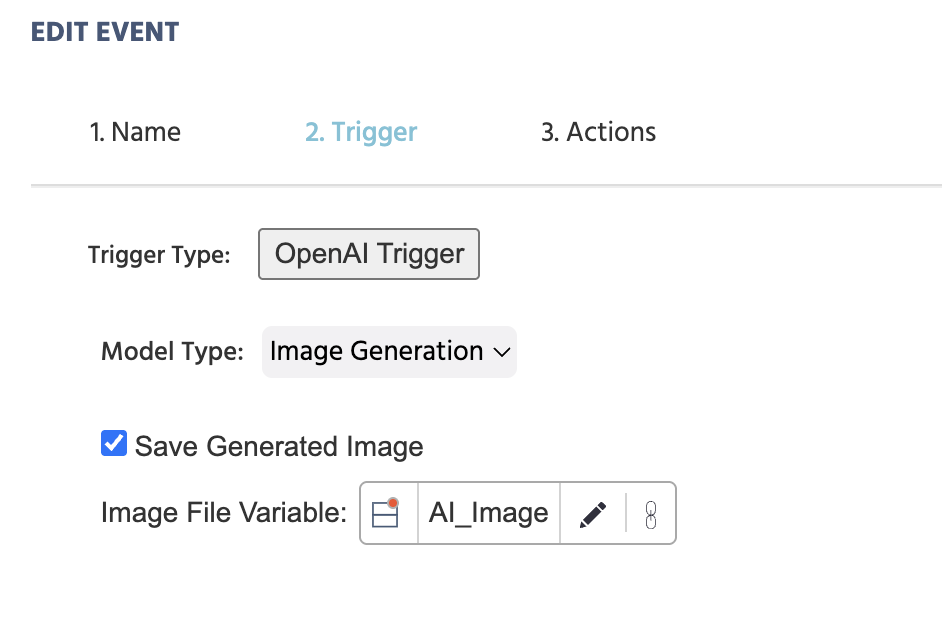

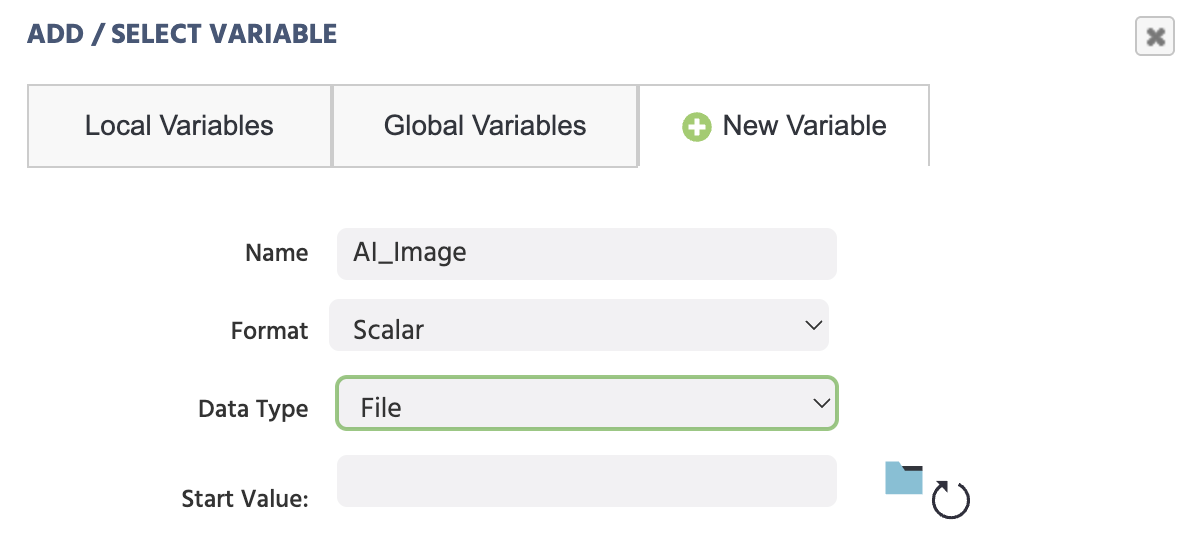

Génération d'Image - Type de Modèle

Avec cette option, vous pouvez indiquer une image générée à sauvegarder et également spécifier dans quelle variable elle doit être sauvegardée.

REMARQUE : Lorsque vous assignez et créez la variable particulière ici, n'oubliez pas d'indiquer le type de variable comme Fichier, afin que le fichier image puisse y être stocké.

Démo Utile : Consultez cette démo qui utilise la génération d'image via le Déclencheur OpenAI et l'action. Le participant est invité à saisir un prompt et ce prompt est ensuite utilisé pour générer une image.

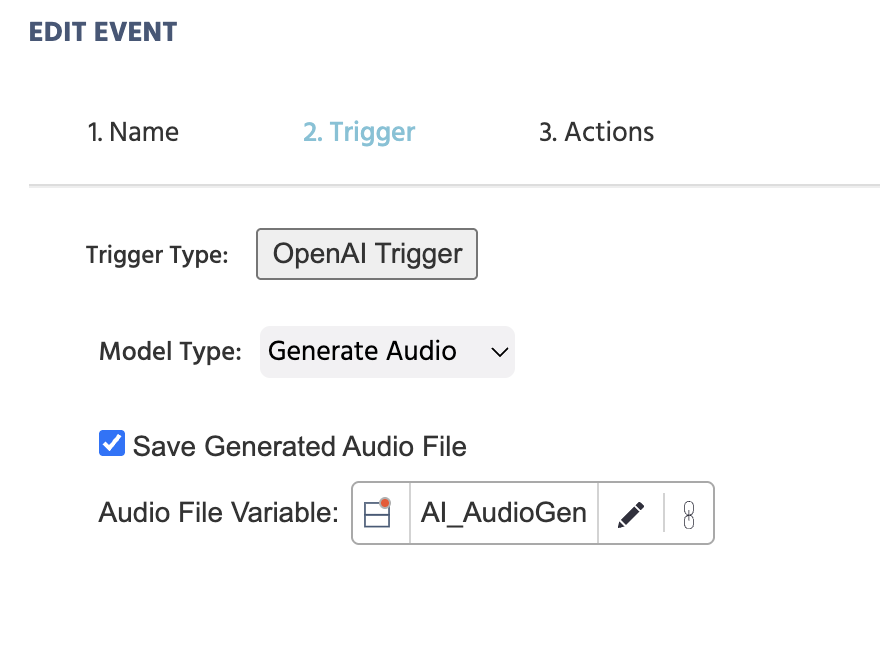

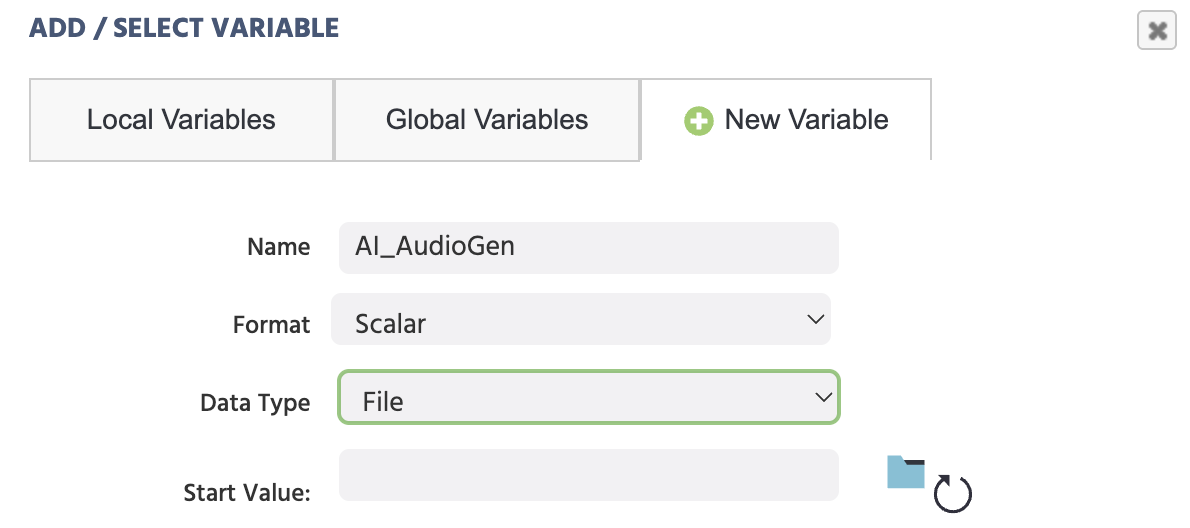

Générer de l'Audio - Type de Modèle

Avec cette option, vous pouvez indiquer un fichier audio généré à sauvegarder et également spécifier dans quelle variable il doit être sauvegardé.

REMARQUE : Lorsque vous assignez et créez la variable particulière ici, n'oubliez pas de choisir le type de variable comme Fichier, afin que le fichier audio puisse y être stocké.

Actions Utiles

Remarque : Après avoir sélectionné le déclencheur OpenAI dans le système d'événements, vous avez la possibilité d'utiliser et de référencer des valeurs OpenAI spécifiques au déclencheur à travers diverses actions avec le menu de sélection de valeur.