Déclencheur de Détection des Émotions

Table des matières

Aperçu

Le déclencheur de détection des émotions dans Labvanced est utilisé pour initier automatiquement des événements ou enregistrer des réponses lorsque l'état émotionnel d'un participant est détecté. C'est un élément clé de la détection des émotions de Labvanced qui permet aux chercheurs de lier la présentation de stimuli ou les changements de tâches directement aux réactions émotionnelles en temps réel, rendant les expériences plus dynamiques et permettant une mesure plus précise de la manière dont les émotions influencent le comportement, l'attention ou la prise de décision.

Note: Tout le traitement se fait côté client, garantissant la conformité au RGPD et assurant qu'aucune donnée faciale n'est jamais transmise ou stockée à l'extérieur.

Enregistrement des Données de Détection des Émotions

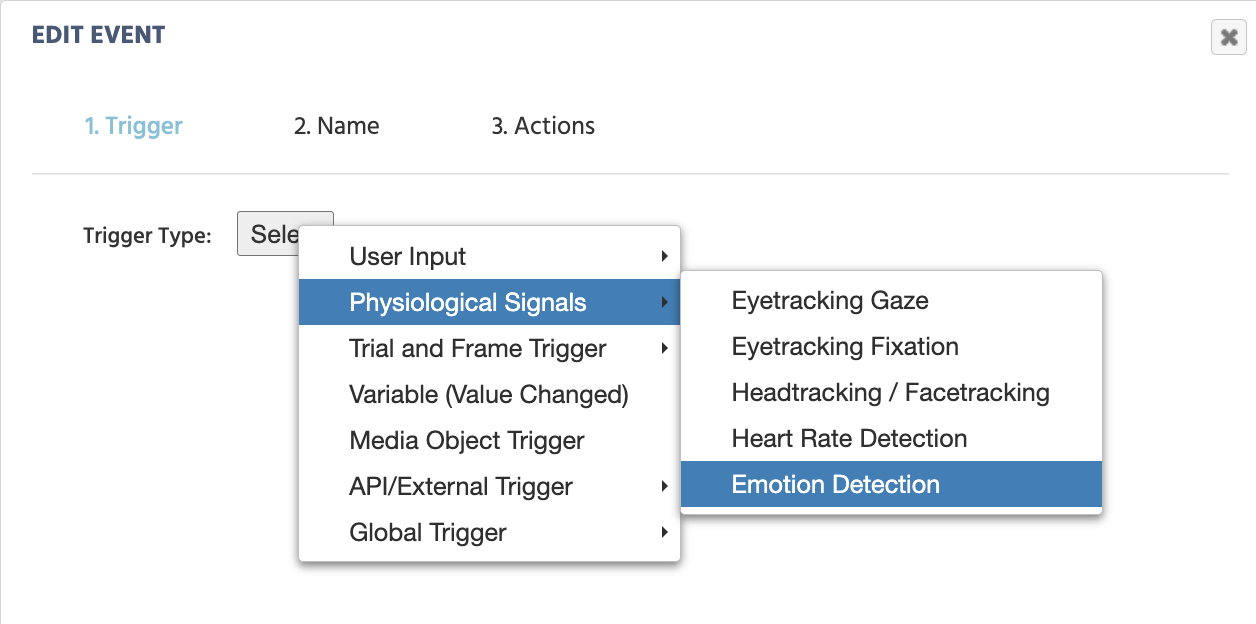

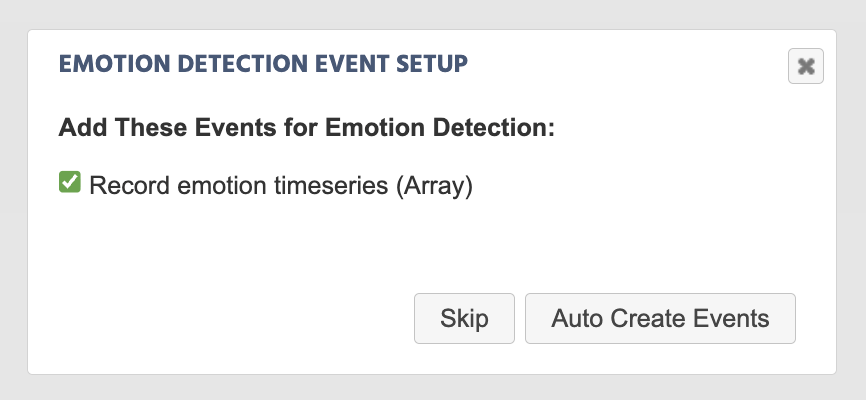

Après avoir sélectionné le déclencheur et donné un nom à l'action, une boîte de dialogue apparaîtra vous invitant à configurer les événements pertinents pour l'enregistrement des données de détection des émotions :

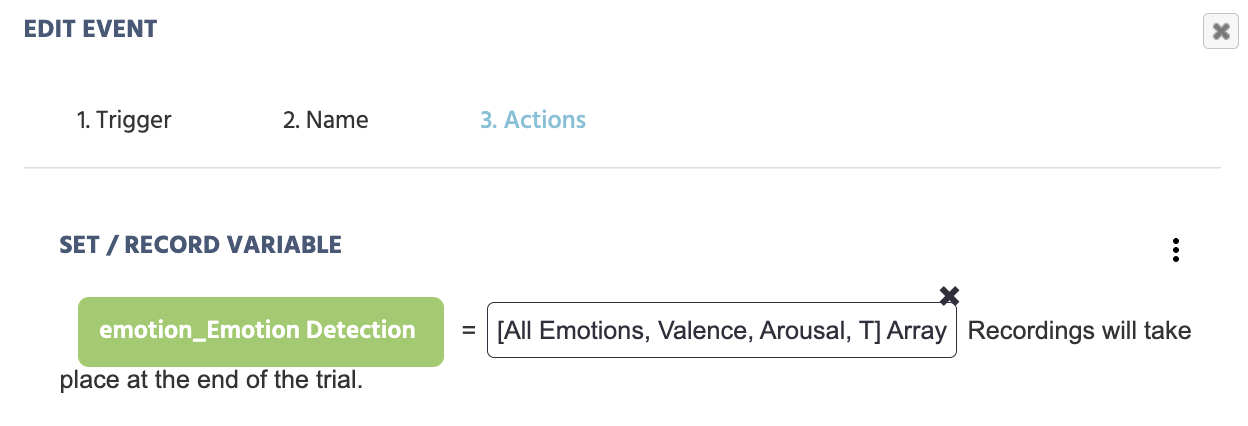

À la suite de la création automatique de cet événement, l'action suivante sera créée (comme montré sur l'image ci-dessous). Le nom de la variable emotion_Détection des Émotions est attribué et la valeur spécifique au déclencheur [Toutes les Émotions, Valence, Arousal, T] est indiquée comme les valeurs à enregistrer lors de la collecte de données.

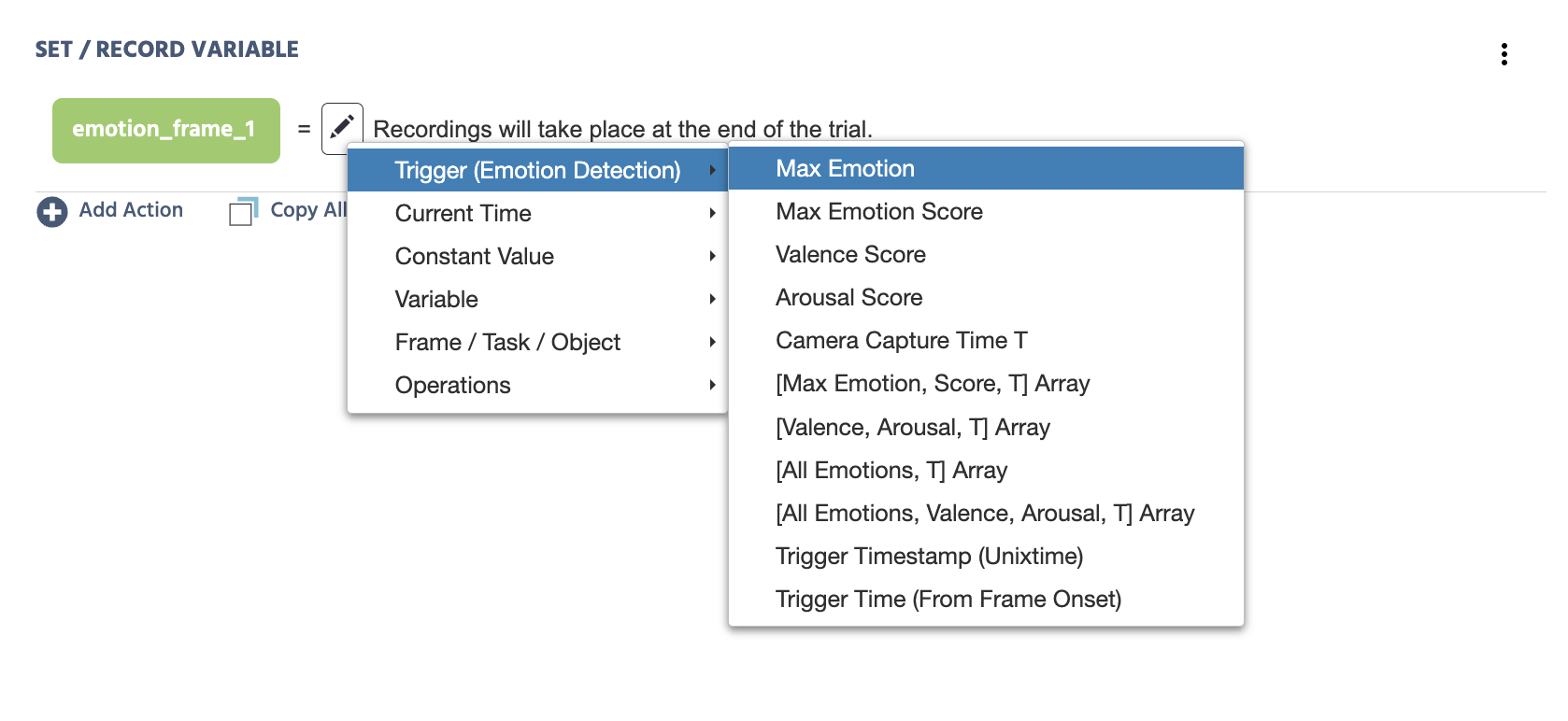

À partir de là, le nom de la variable peut être édité via le panneau Variables, et les valeurs de déclencheur peuvent également être réaffectées à d'autres valeurs. Voir ci-dessous pour plus d'options via le Menu de Sélection des Valeurs.

Aperçu des Données de Détection des Émotions Collectées dans Labvanced

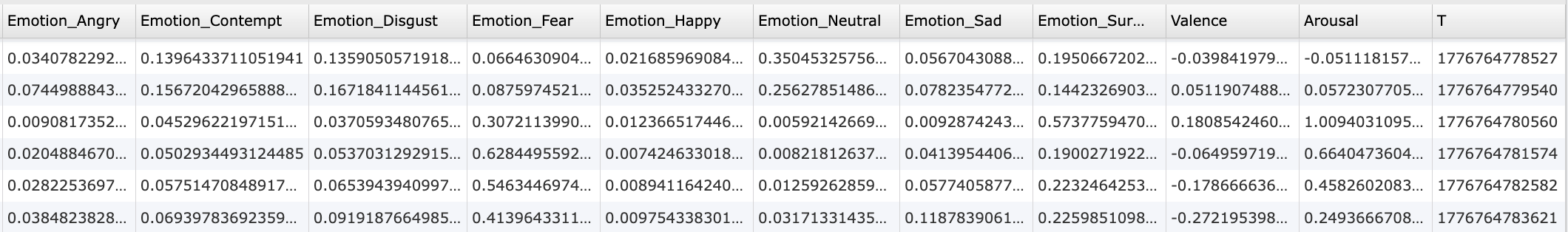

Voici un exemple de données enregistrées à la suite de l'activation de l'événement ci-dessus dans votre tâche dans Labvanced :

Activation de la Détection des Émotions

Afin que le déclencheur de détection des émotions fonctionne, les paramètres pertinents doivent être activés et activés sous le Contrôles de Tâche et Paramètres, comme expliqué ci-dessous.

Paramètres de l'Étude - Activer la Détection des Émotions

Dans l'onglet Paramètres, accédez à Physiologie → Détection des Émotions et cochez la case afin d'activer la détection des émotions dans votre étude.

Paramètres de la Tâche - Activer la Détection des Émotions

Sous la section Contrôles de Tâche dans l'éditeur de tâche, accédez à l'onglet Signaux Physiologiques et cliquez sur la case à cocher afin que la détection des émotions soit active dans la tâche particulière.

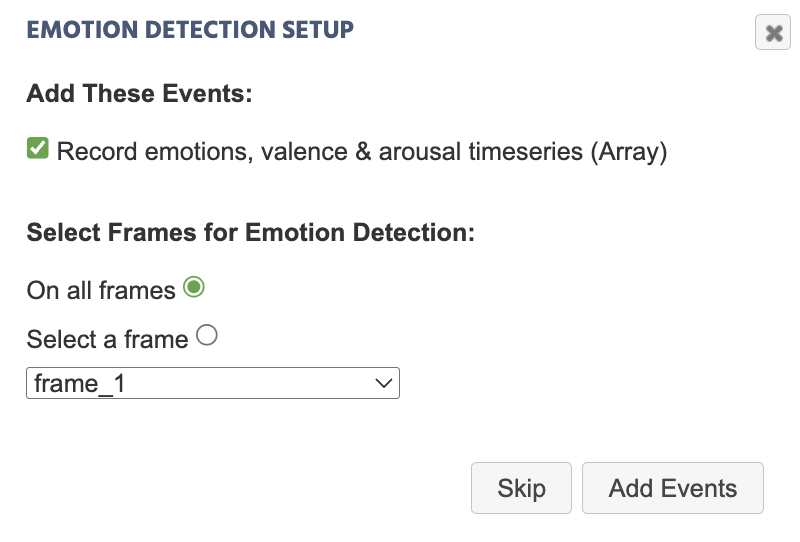

Après avoir activé la détection des émotions en cochant la case, une boîte de dialogue apparaîtra vous demandant d'indiquer si un événement pour l'enregistrement des valeurs de détection des émotions doit être créé, ainsi que le cadre sur lequel l'enregistrement doit se produire :

Valeurs Spécifiques au Déclencheur pour la Détection des Émotions

Après avoir sélectionné le Déclencheur de Détection des Émotions, les options suivantes sont disponibles dans le Menu de Sélection des Valeurs.

| Valeur | Description |

|---|---|

Max Emotion | L'émotion maximale détectée. Valeur chaîne avec les paramètres suivants disponibles : angry, contempt, disgust, fear, happy, neutral, sad, surprise. |

Max Emotion Score | Le score de l'Max Emotion détectée. |

Valence Score | Le score numérique pour la détection de la valence. |

Arousal Score | Le score numérique pour l'arousal détecté. |

Camera Capture Time T | La valeur d'horodatage ajustée en fonction de quand la capture d'image (c'est-à-dire la capture photo) s'est produite, ce qui est requis pour effectuer des calculs de détection des émotions. Note : Bien que l'Horodatage du Déclencheur soit une valeur de quand le déclencheur a été initié, il faut quelques millisecondes à l'algorithme pour capturer l'image localement, puis traiter le score émotionnel. Ainsi, la valeur de Camera Capture Time T est un horodatage plus précis à utiliser. |

[Max Emotion, Score, T] Array | Un tableau qui contient les valeurs suivantes : Max Emotion (étiquette chaîne) score (numérique), Camera Capture T (Unixtime). |

[Valence, Arousal, T] Array | Un tableau qui contient les valeurs suivantes : Valence (numérique), Arousal (numérique), Camera Capture T (Unixtime). |

[All Emotions, T] Array | Enregistre les scores pour toutes les 8 émotions et le Camera Capture T (Unixtime). Référez-vous aux 8 premières colonnes et à la dernière colonne de l'image d'aperçu dans la section d'enregistrement des données ci-dessus pour avoir une idée des données collectées avec cette valeur spécifique au déclencheur sélectionnée. Note : Les valeurs des 8 émotions sous All Emotions sont relatives les unes par rapport aux autres car les scores de toutes les 8 émotions s'additionnent à 1. |

[All Emotions, Valence, Arousal, T] Array | Enregistre les scores numériques pour toutes les 8 émotions, valence, arousal, et le Camera Capture T (Unixtime). Référez-vous à l'image d'aperçu dans la section d'enregistrement des données ci-dessus pour avoir une idée des données collectées avec cette valeur spécifique au déclencheur sélectionnée. Note : Les valeurs des 8 émotions sous All Emotions sont relatives les unes par rapport aux autres car les scores de toutes les 8 émotions s'additionnent à 1. |

Trigger Timestamp (Unixtime) | L'horodatage du déclencheur en UNIXTIME. Note : Référez-vous à la valeur Camera Capture T car c'est une valeur plus précise pour quand la détection des émotions a eu lieu, comme expliqué ci-dessus. |

Trigger Time (From Frame Onset) | Temps (en millisecondes) que le déclencheur s'est produit depuis le début de l'image / démarrage. |

Exemples Pratiques Présentant le Déclencheur de Détection des Émotions

Contrôle du Progrès de l'Expérience en Fonction de l'État Émotionnel

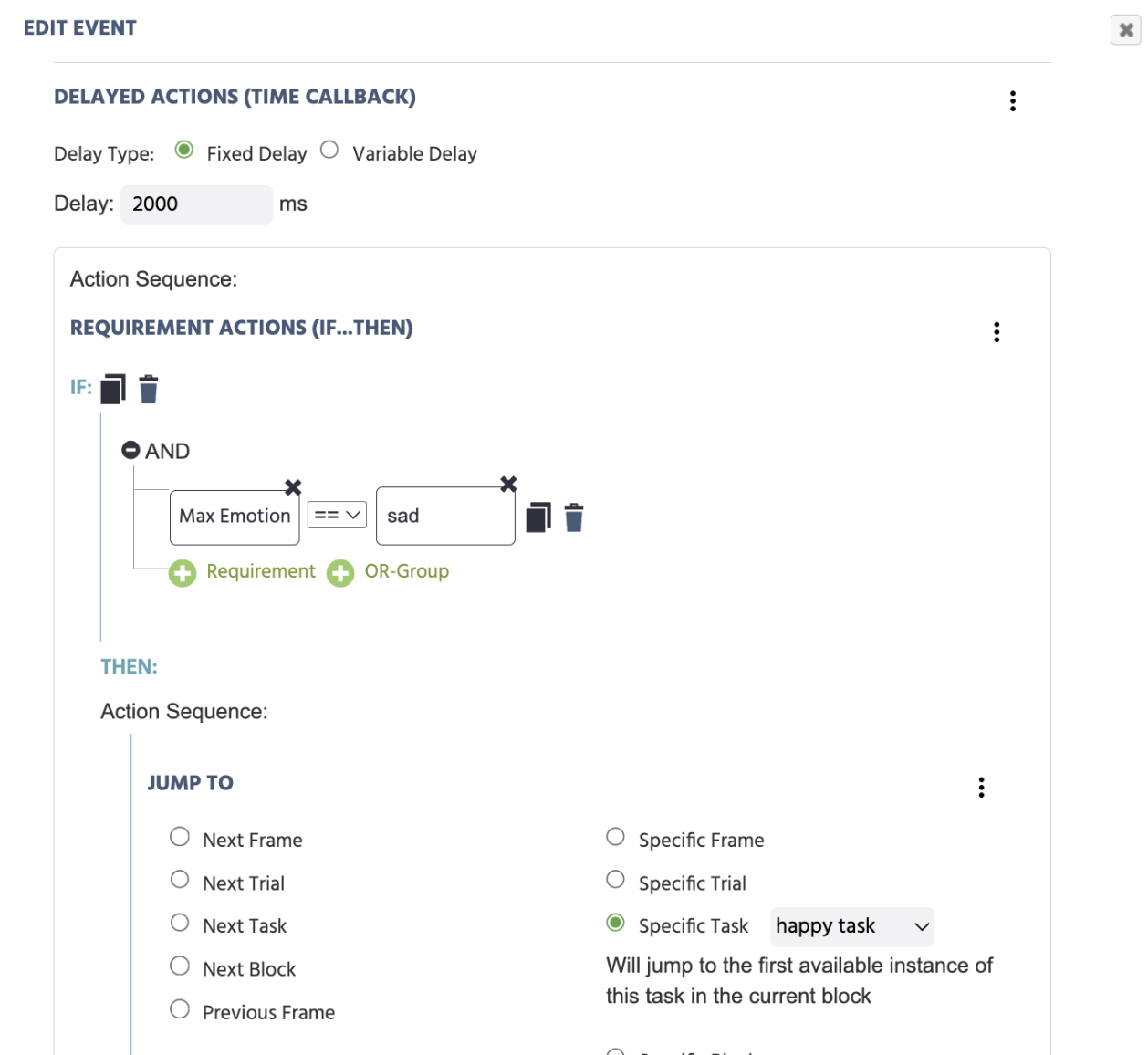

Dans cet exemple, une Action Retardée contient une Action de Condition (Si...Alors) pour spécifier qu'après un retard de 2000 millisecondes, si le Max Emotion est égal à sad, pour passer à Jump To une tâche spécifique.

Détection des Émotions en Temps Réel

Une série d'images est présentée, le participant est invité à imiter l'expression. L'émotion la plus forte détectée de l'expression du participant est rapportée, ainsi que les valeurs de valence et d'arousal.