Emotionserkennung Trigger

Inhaltsverzeichnis

Überblick

Der Emotionserkennung Trigger in Labvanced wird verwendet, um automatisch Ereignisse auszulösen oder Antworten aufzuzeichnen, wenn der emotionale Zustand eines Teilnehmers erkannt wird. Dies ist eine Schlüsselkomponente von Labvanced's Emotionserkennung, die es Forschern ermöglicht, die Präsentation von Stimuli oder Änderungen von Aufgaben direkt mit emotionalen Reaktionen in Echtzeit zu verknüpfen, wodurch Experimente dynamischer werden und eine genauere Messung ermöglicht wird, wie Emotionen Verhalten, Aufmerksamkeit oder Entscheidung treffen beeinflussen.

Hinweis: Alle Verarbeitungen erfolgen client-seitig, um die Einhaltung der DSGVO sicherzustellen und zu garantieren, dass keine Gesichtsdaten jemals extern übertragen oder gespeichert werden.

Aufzeichnung von Emotionserkennungsdaten

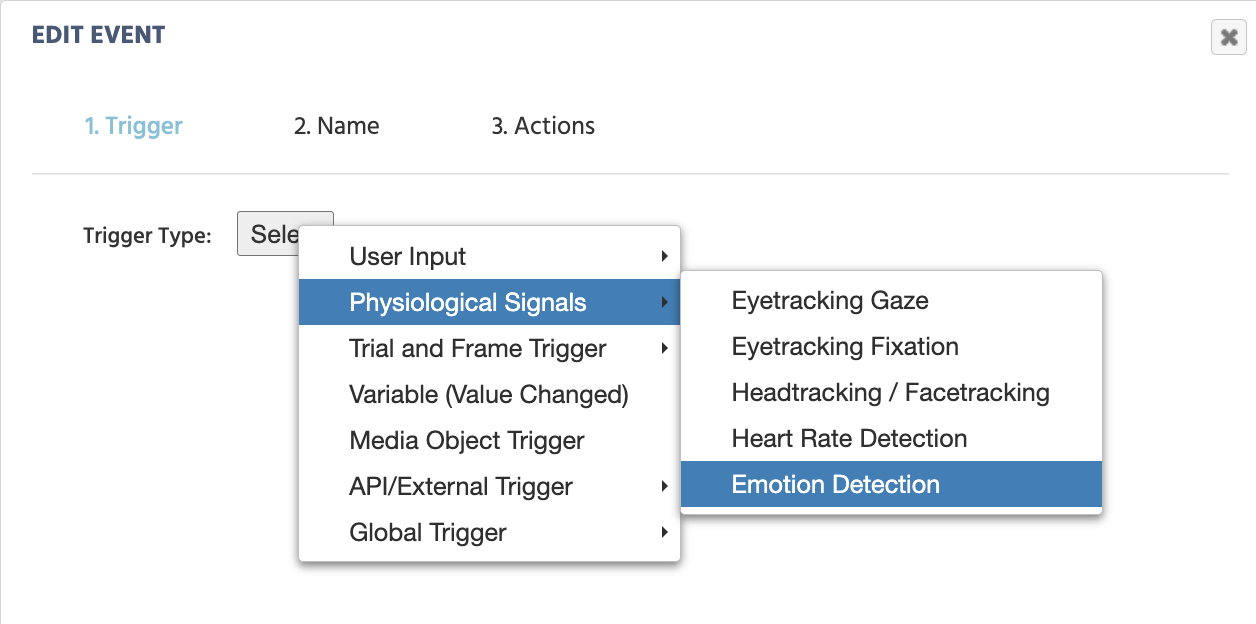

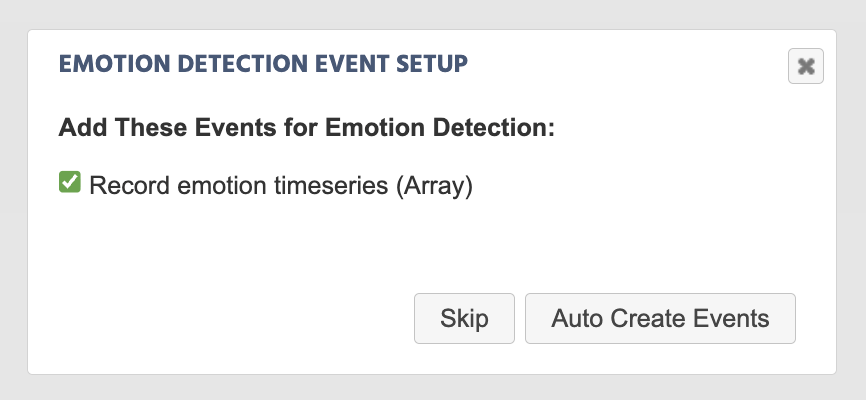

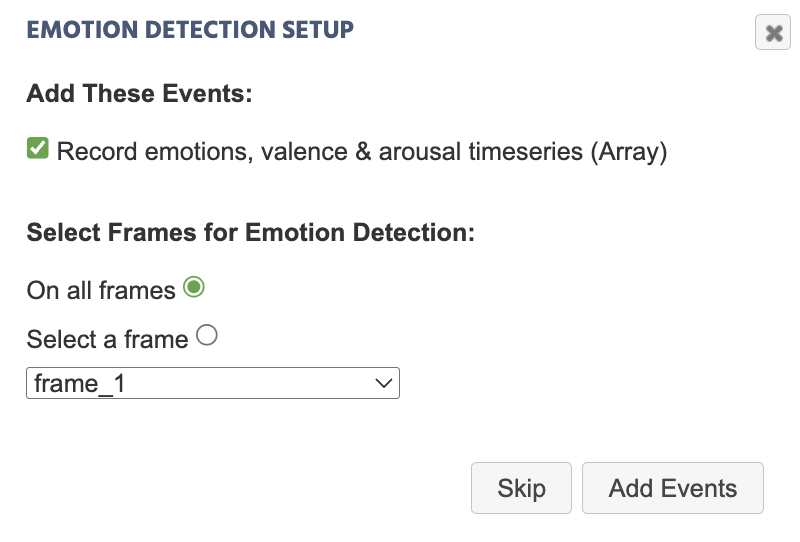

Sobald Sie den Trigger ausgewählt und der Aktion einen Namen gegeben haben, erscheint ein Dialogfeld, das Sie auffordert, die relevanten Ereignisse für die Aufzeichnung von Daten zur Emotionserkennung einzurichten:

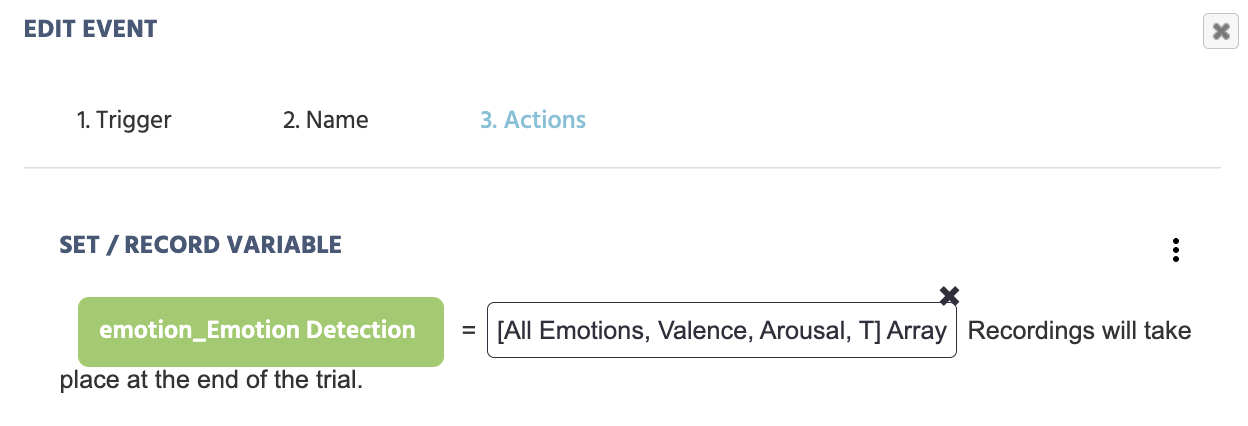

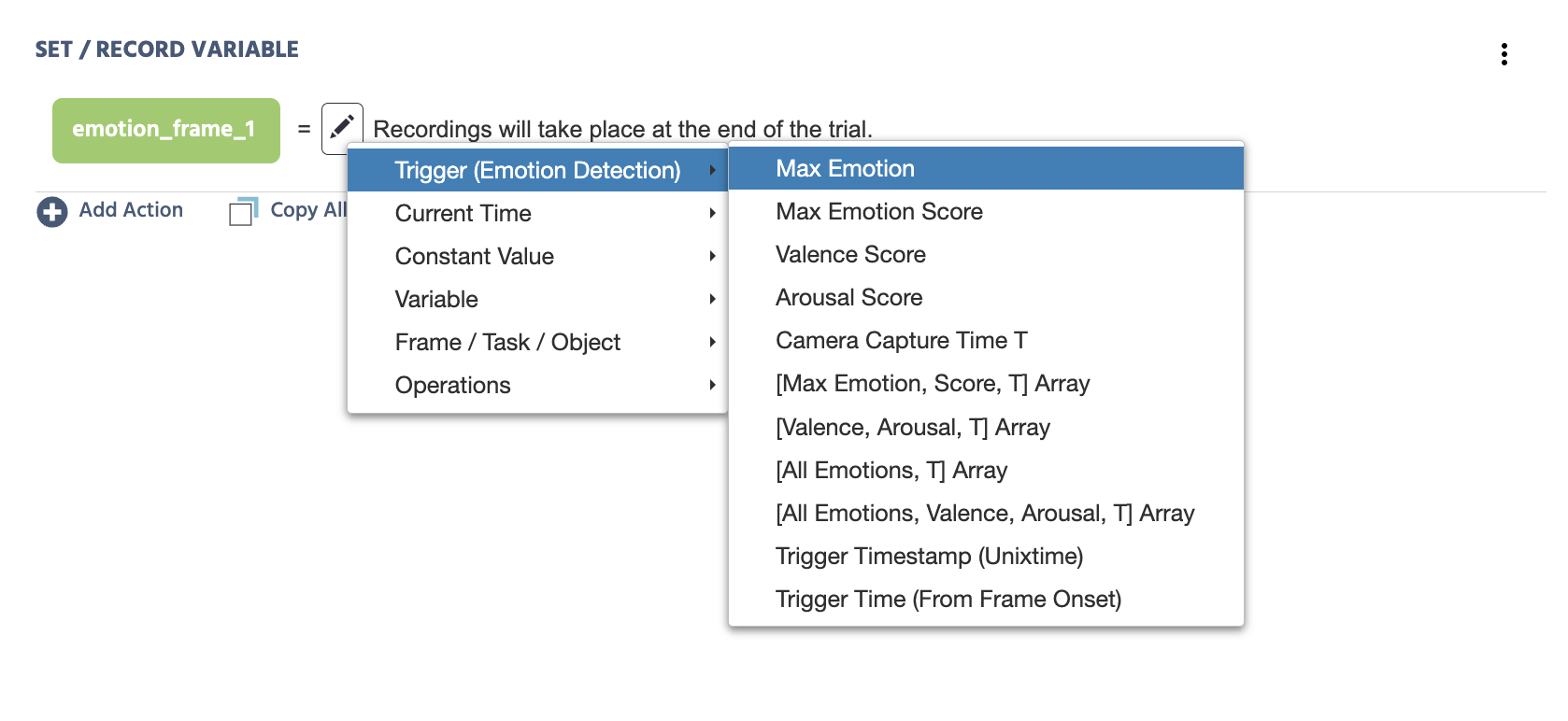

Als Ergebnis der automatischen Erstellung dieses Ereignisses wird die folgende Aktion erstellt (wie im Bild unten gezeigt). Der Variablenname emotion_Emotion Detection wird zugewiesen und der trigger-spezifische Wert des [All Emotions, Valence, Arousal, T] Arrays wird als die Werte angezeigt, die während der Datensammlung aufgezeichnet werden.

Von hier aus kann der Variablenname weiter im Variablen-Panel bearbeitet werden, und die Triggerwerte können ebenfalls auf andere Werte umgezogen werden. Siehe unten für weitere Optionen über das Werte-Auswahlmenü.

Vorschau der in Labvanced gesammelten Emotionserkennungsdaten

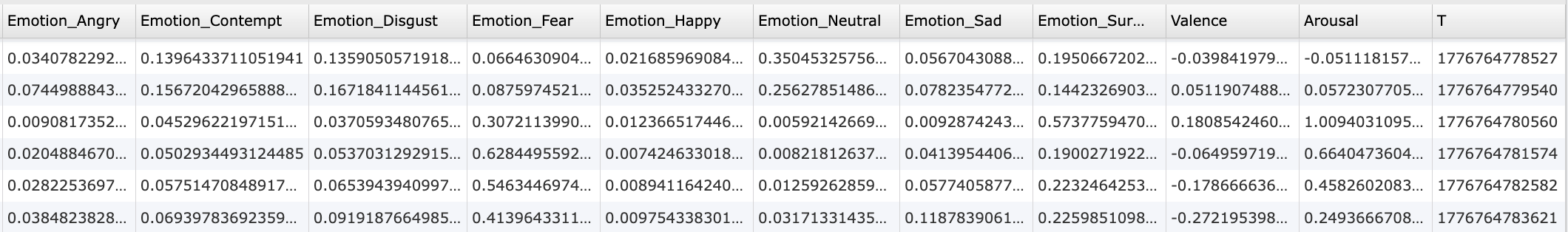

Unten finden Sie ein Beispiel für Daten, die als Ergebnis der Aktivierung des oben genannten Ereignisses in Ihrer Aufgabe in Labvanced aufgezeichnet wurden:

Aktivierung der Emotionserkennung

Damit der Emotionserkennung Trigger funktioniert, müssen die relevanten Einstellungen unter sowohl den Aufgabensteuerungen als auch den Einstellungen aktiv aktiviert und eingeschaltet sein, wie unten erklärt.

Studiensettings - Emotionserkennung aktivieren

Im Tab Einstellungen navigieren Sie zu Physiologie → Emotionserkennung und aktivieren das Kontrollkästchen, um die Emotionserkennung in Ihrer Studie zu aktivieren.

Aufgabeneinstellungen - Emotionserkennung aktivieren

Unter dem Abschnitt Aufgabensteuerungen im Aufgabeneditor navigieren Sie zum Tab Physiologische Signale und klicken auf das Kontrollkästchen, damit die Emotionserkennung in der betreffenden Aufgabe aktiv ist.

Nach der Aktivierung der Emotionserkennung durch Klicken auf das Kontrollkästchen erscheint ein Dialogfeld, das Sie auffordert, anzugeben, ob ein Ereignis zur Aufzeichnung von Werten zur Emotionserkennung erstellt werden soll, sowie auf welchem Frame die Aufzeichnung stattfinden soll:

Trigger-spezifische Werte für die Emotionserkennung

Nach der Auswahl des Emotionserkennung Trigger sind die folgenden Optionen im Werte-Auswahlmenü verfügbar.

| Wert | Beschreibung |

|---|---|

Max Emotion | Die maximale Emotion, die erkannt wurde. Zeichenfolgenwert mit den folgenden verfügbaren Parametern: angry, contempt, disgust, fear, happy, neutral, sad, surprise. |

Max Emotion Score | Der Wert der Max Emotion, die erkannt wurde. |

Valence Score | Der numerische Wert für die Valenz-Erkennung. |

Arousal Score | Der numerische Wert für die erfasste Erregung. |

Camera Capture Time T | Der angepasste Zeitstempelwert basierend auf dem Zeitpunkt, an dem die Bildaufnahme (d.h. die Kamerafotografie) stattfand, die zur Durchführung von Berechnungen der Emotionserkennung erforderlich ist. Hinweis: Während der Trigger-Zeitstempel einen Wert angibt, wann der Trigger initiiert wurde, braucht der Algorithmus einige Millisekunden, um das Bild-Frame lokal aufzunehmen und dann den emotionalen Wert zu verarbeiten. Daher ist der Wert Camera Capture Time T ein genauerer Zeitstempel. |

[Max Emotion, Score, T] Array | Ein Array, das die folgenden Werte enthält: Max Emotion (Zeichenfolgenlabel) Wert (numerisch), Kameraerfassungs-T (Unixtime). |

[Valence, Arousal, T] Array | Ein Array, das die folgenden Werte enthält: Valenz (numerisch), Erregung (numerisch), Kameraerfassungs-T (Unixtime). |

[All Emotions, T] Array | Zeichnet die Werte für alle 8 Emotionen und den Kameraerfassungs-T (Unixtime) auf. Siehe die ersten 8 Spalten und die letzte Spalte der Bildvorschau im Abschnitt zur Datenaufzeichnung oben für einen Eindruck der mit diesem trigger-spezifischen Wert ausgewählten gesammelten Daten. Hinweis: Die Werte der 8 Emotionen unter All Emotions sind relativ zueinander, da die Werte aller 8 Emotionen zusammen 1 ergeben. |

[All Emotions, Valence, Arousal, T] Array | Zeichnet die numerischen Werte für alle 8 Emotionen, Valenz, Erregung und den Kameraerfassungs-T (Unixtime) auf. Siehe die Bildvorschau im Abschnitt zur Datenaufzeichnung oben für einen Eindruck der mit diesem trigger-spezifischen Wert ausgewählten gesammelten Daten. Hinweis: Die Werte der 8 Emotionen unter All Emotions sind relativ zueinander, da die Werte aller 8 Emotionen zusammen 1 ergeben. |

Trigger Timestamp (Unixtime) | Der Trigger-Zeitstempel in UNIXTIME. Hinweis: Siehe den Wert für die Kameraerfassung T, da dies ein genauerer Wert ist, wann die Emotionserkennung stattfand, wie oben erklärt. |

Trigger Time (From Frame Onset) | Zeit (in Millisekunden), seit der der Trigger vom Frame-Anfang / -start aufgetreten ist. |

Praktische Beispiele mit dem Emotionserkennung Trigger

Kontrolle des Experimentablaufs basierend auf dem emotionalen Zustand

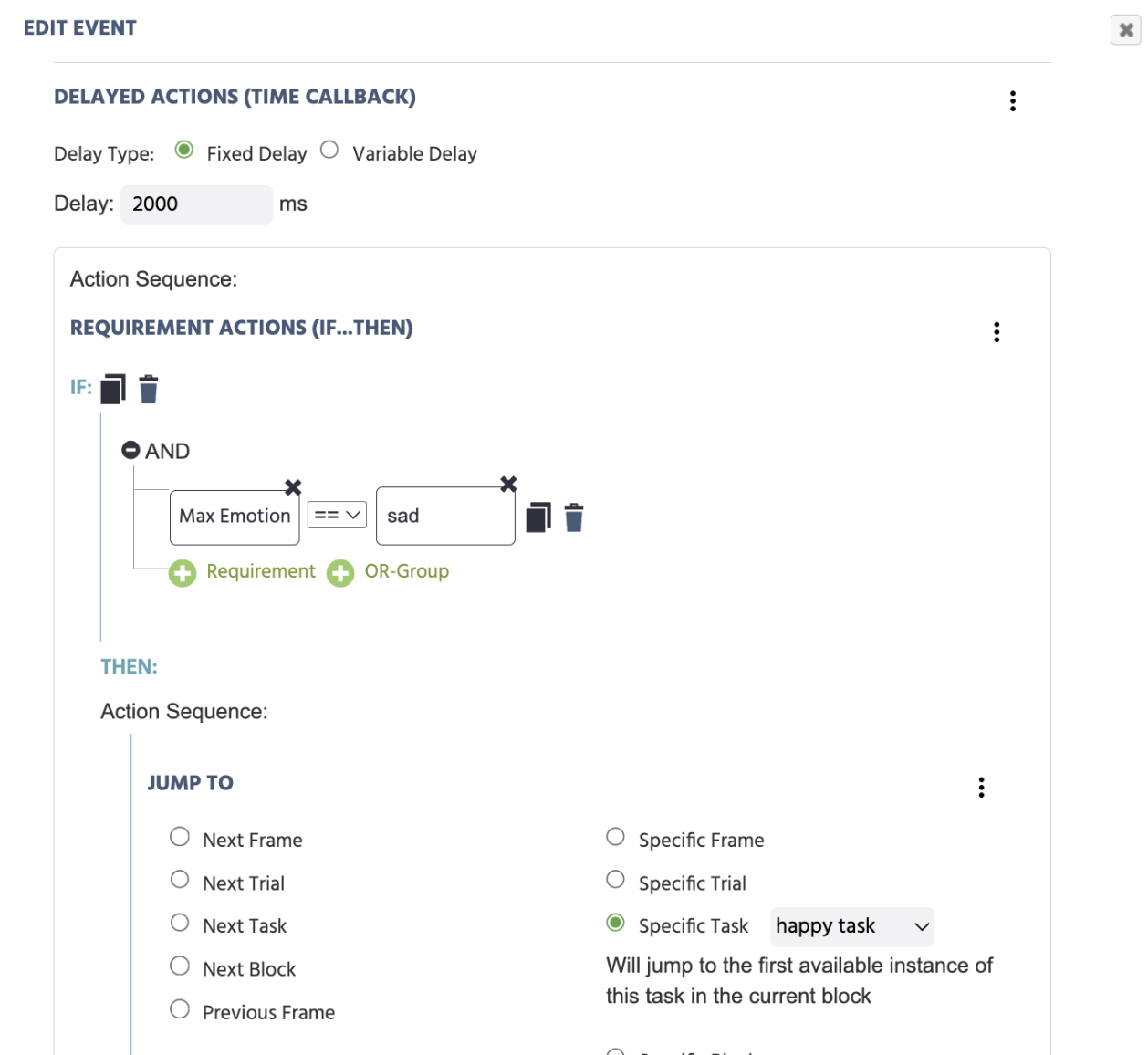

In diesem Beispiel enthält eine Verzögerte Aktion eine Anforderungsaktion (Wenn...Dann), um anzugeben, dass nach einer Verzögerung von 2000 Millisekunden, wenn die Max Emotion gleich sad ist, auf eine spezifische Aufgabe Jump To fortgeschritten werden soll.

Emotionserkennung in Echtzeit

Eine Reihe von Bildern wird präsentiert, der Teilnehmer wird gebeten, den Ausdruck nachzuahmen. Die höchste Emotion, die aus dem Gesichtsausdruck des Teilnehmers erkannt wurde, wird zusammen mit den Valenz- und Erregungswerten gemeldet.