ゲームパッド / ジョイスティックコントローラー - 基本的なセットアップ

概要

このウォークスルーでは、ゲームパッド / ジョイスティックトリガーに基づいて、どのように研究を構築できるかを詳しく見ていきます。基本的に、ゲームコントローラーまたはジョイスティックがLabvancedに接続され、適切なイベントが設定されて、コントローラーの特定の使用に応じて何が発生するかが指定されます。

以下は、この機能の動作例です:

上の例では、参加者がゲームパッドデバイスを使用して画像の位置と回転を変更しています。画像はキーを使用して上下に移動し、軸(スティック)を使用して回転します。これらの入力オプションはLabvancedのイベントトリガーメニューを使用して指定されます。デモ目的のために、データ値は画像の右側に表示されています。キーが押されると、その数値ID値が表示され、軸スティックが使用されると、値が自動的に更新されます。通常の研究では、これらの値は表示されませんが、ここではこのデータがどのように見えるか、また画像に対してその後の効果が何であるかを示すために表示されています。

上記のデモをインポートして、自分のコントローラーを使用してカスタマイズできます: https://www.labvanced.com/page/library/64055

セットアップ - ゲームパッド / ジョイスティックの接続

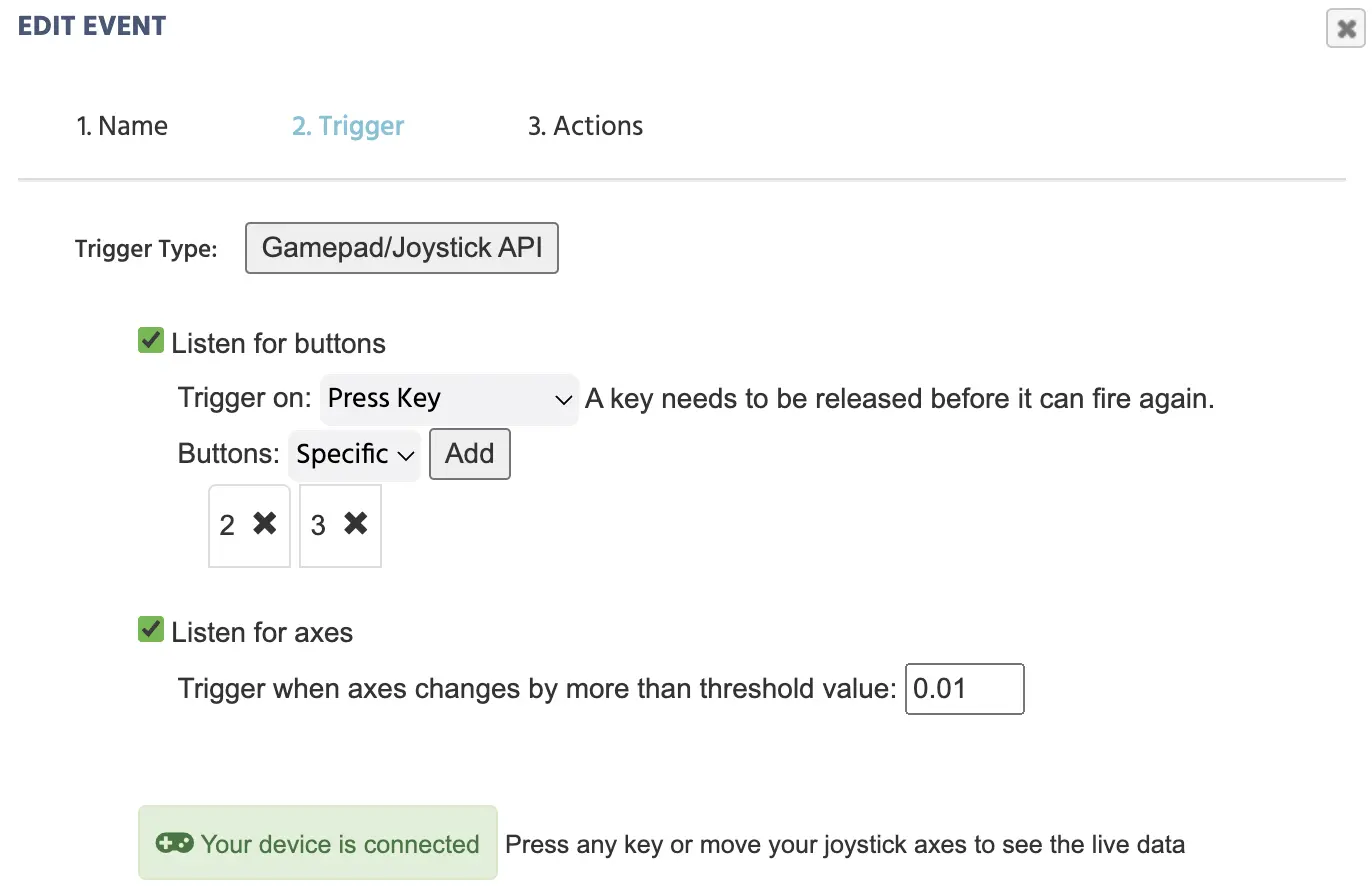

ゲームパッド / ジョイスティックをデバイスに接続すると、Labvancedがそれを検出します。キーを押すと、ライブデータフィードを持つセクションが表示されます。ここでは、キーが押されたり保持されたり放されたりすることがどのように記録されるかを見ることができます。また、スティックを使用した場合の軸の値も表示されます。

注意: コントローラーをデバイスに直接接続することをお勧めします。ブラウザベースの環境でBluetoothサポートは限られているため、Bluetooth Low Energy (BLE) というものがあり標準化されていないため、Bluetooth経由で接続することは避けることをお勧めします。

コントローラーのキーを押して画像を移動させる

ゲームパッドを接続すると、どの特定のキーをトリガーとして使用するかを指定できます。特定のキーを押すと、システムがそのIDを表示します。

トリガー

以下の例では、2は使用されている特定のゲームコントローラーに対する◎キーを示し、3は▵キーを示しています。

注意: ゲームコントローラーによってキーIDの割り当てにばらつきがあるため、一つのブランドではゲームパッドの◎キーがID 1を持つ一方で、別のコントローラーではID 2を持つことがあります。

アクション

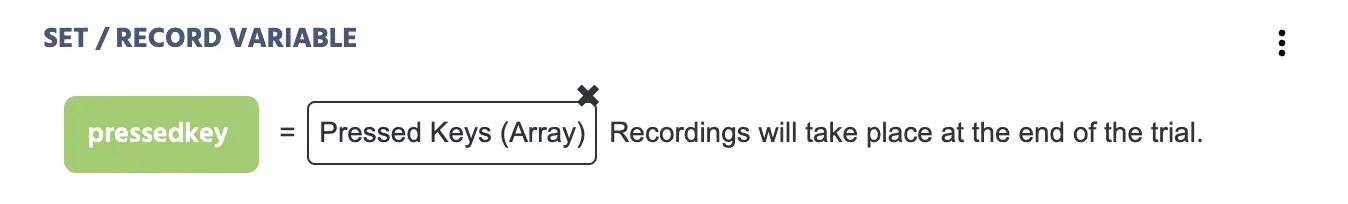

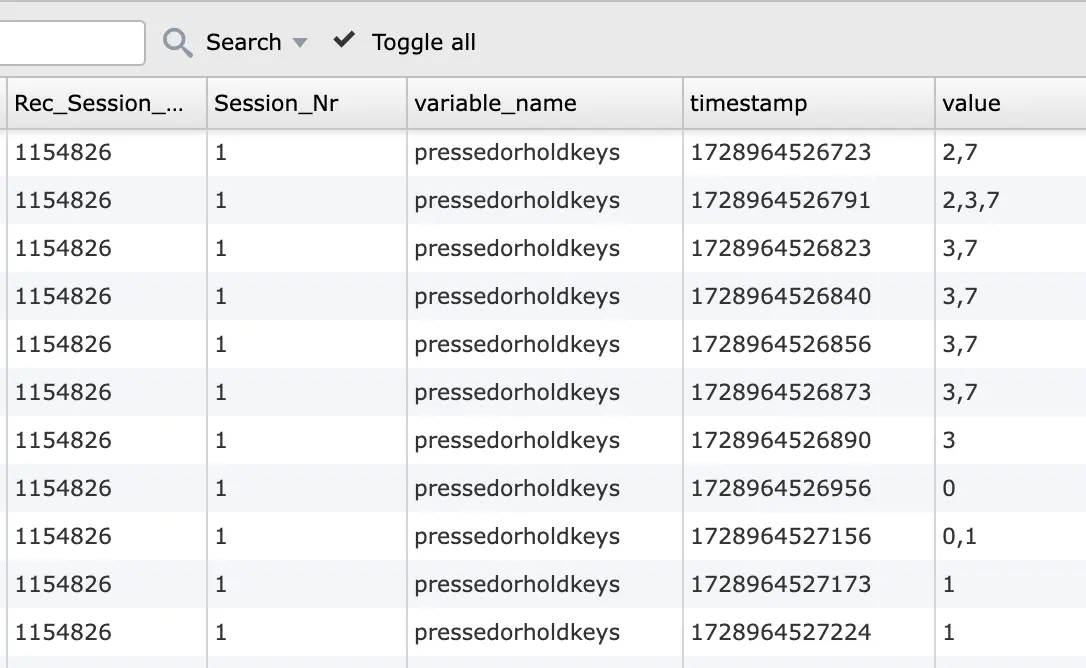

トリガーが実行される時、次に何が起こるかをアクションを通じて指定する必要があります。まず、押されたキー (配列)が記録され、私たちが作成して名付けた配列変数pressedkeyarrayにスコアが付けられることを示します。

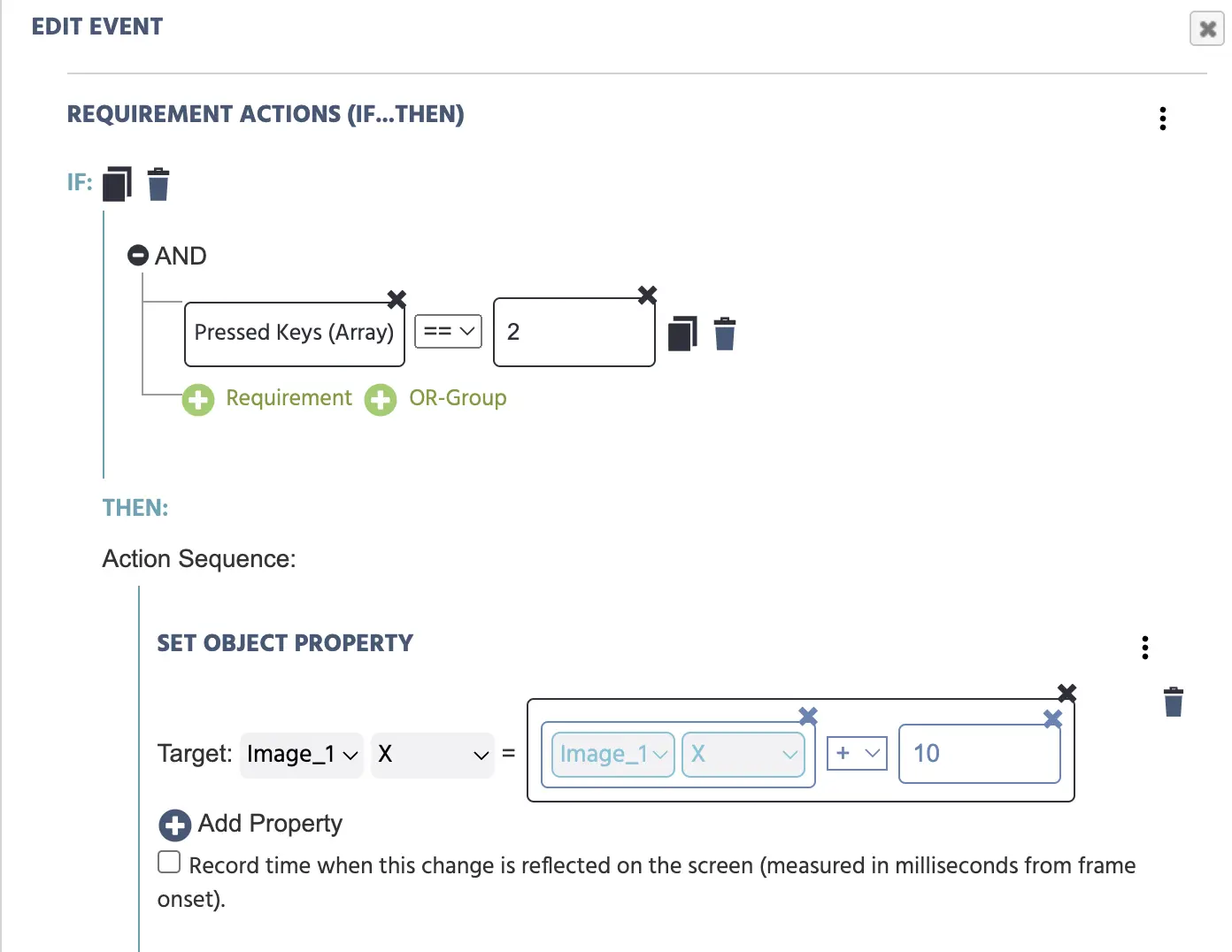

次に、特定のキーが押されたときに何が起こるかの仕様(ルール)を条件アクション (If…Then)アクションを使用して設定する必要があります。以下のアクションでは、

- IF ◎キーが押された場合(上記で説明したライブデータフィードを使用して、ID

2が付与されていることを確認しました) - THEN

Image_1のXオブジェクトプロパティは、値+10によって増加します。これにより、X座標が10増加し、画像が右に移動します。これはオペレーションを介して達成されます。

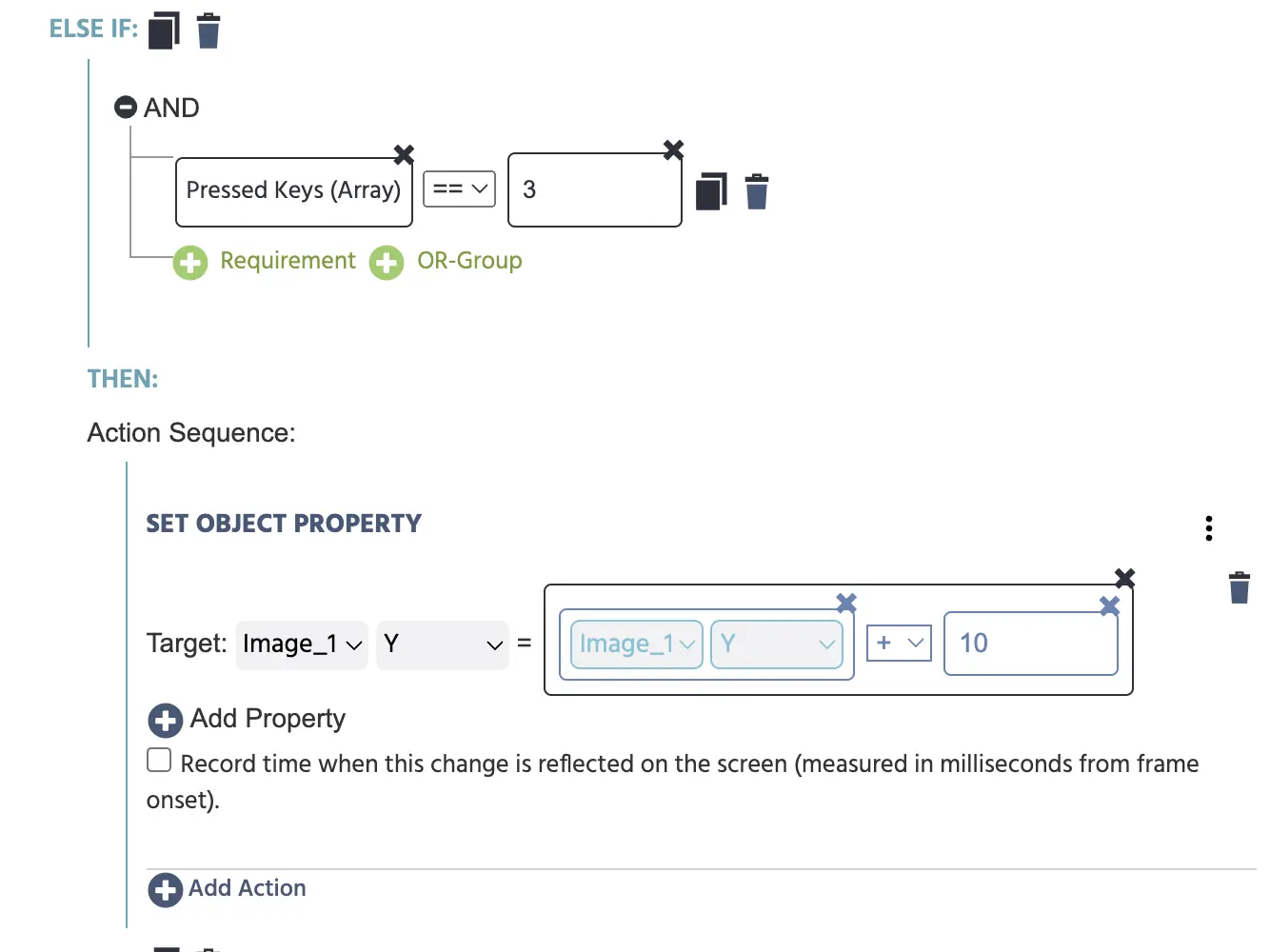

- IF ▵キーが押された場合(上記で説明したライブデータフィードを使用して、ID

3が付与されていることを確認しました) - THEN

Image_1のYオブジェクトプロパティは、値+10によって増加します。これにより、画像は10下に移動します。注意: はい、この値は+10で、画像が下に移動します。これは、実験がブラウザでどのようにレンダリングされるかによるもので、Y値は左上隅から始まるため、10を加えることで画像が「下」に移動します。

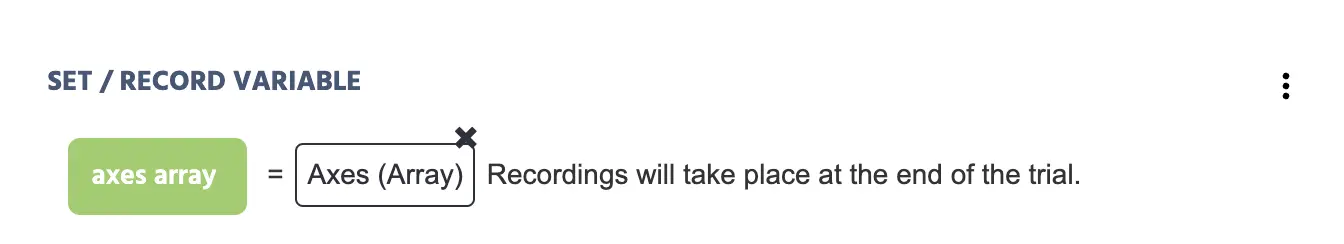

注意: トリガーメニューで「軸をリッスンする」オプションが選択されているため、この時点で軸配列を記録するアクションを作成することもできます。記録されるデータは以下に示されています。

記録されたデータ

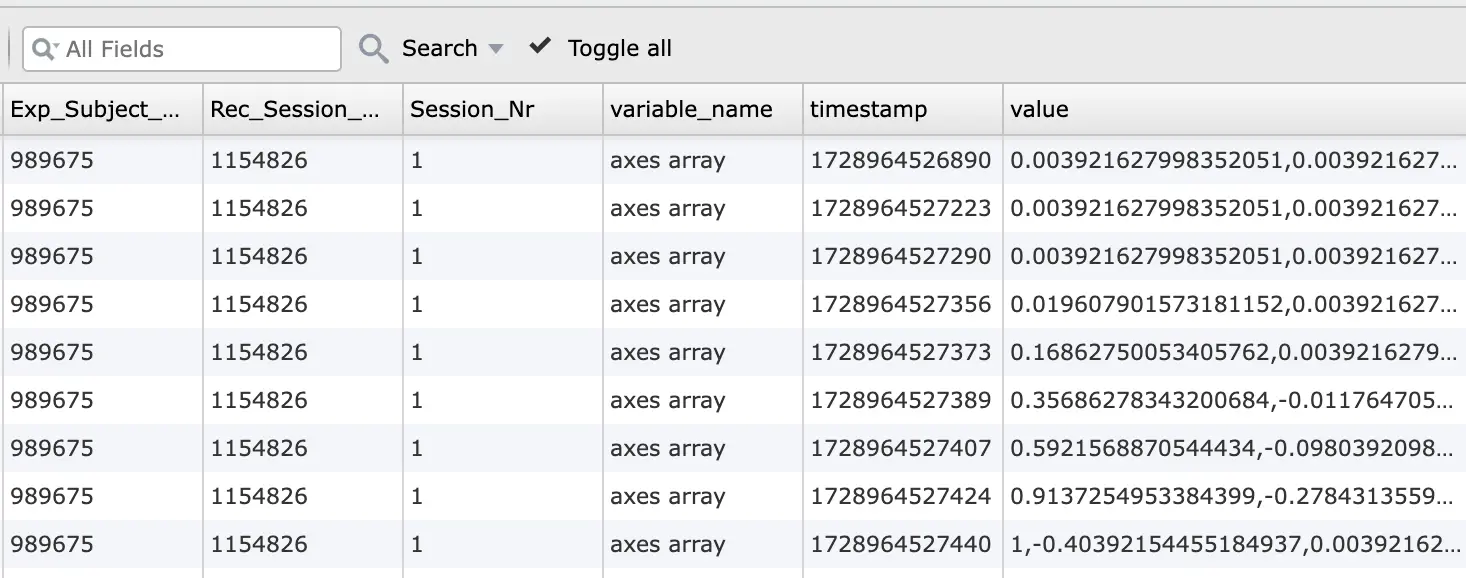

以下は、この実験設定を使用して記録されたデータのいくつかの例です。

右から3列目はaxes array変数を指し、最後の列「value」はこの特定の変数の内容を示しています。

ここでは、右から3列目はpressedkeyarray変数を指し、最後の列「value」はこの特定の変数の内容、つまり押されたキーを示しています。

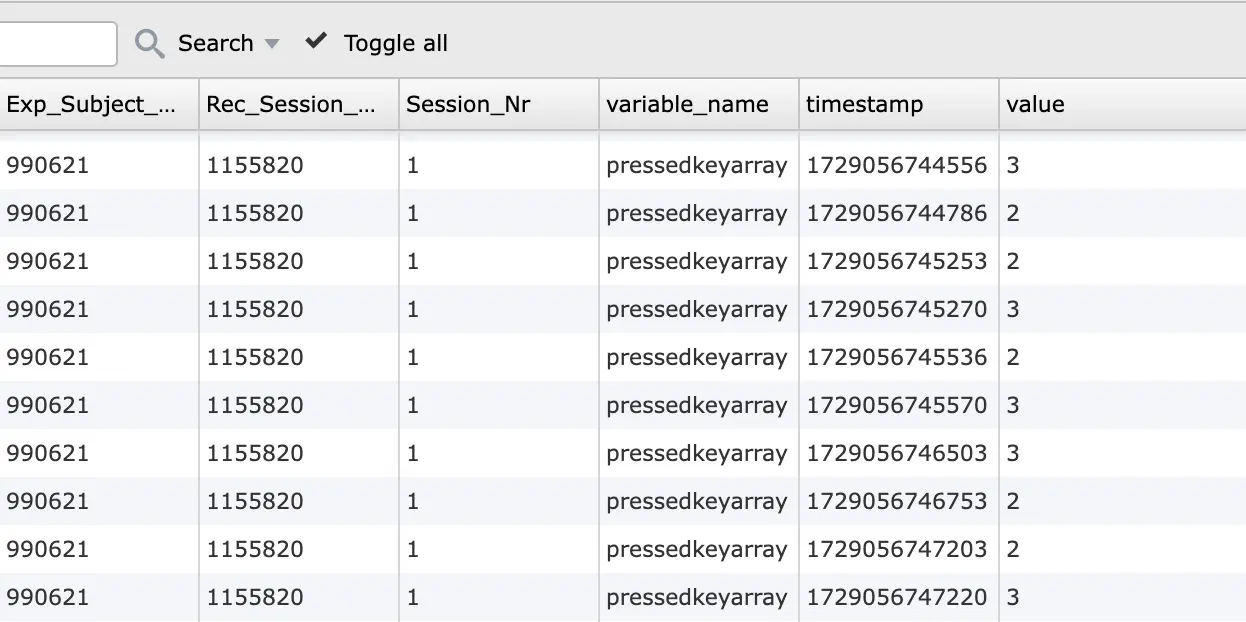

研究でゲームパッド / ジョイスティックのキーを押すか保持するトリガーオプションを利用する場合、以下のようにキー入力の組み合わせを測定することも可能です。

この内容を研究に実装したい場合や質問がある場合は、お気軽にお問い合わせください。チャットメッセージやメールでご連絡をお待ちしております!