ブーバ-キキ課題

ブーバ-キキ課題は、見慣れない単語を視覚的な形と関連付ける方法を調べることで音と形の対応を測定します。この課題は、知覚、言語処理、マルチセンサリー統合を研究するために認知心理学や言語学の研究で広く使用されています。

課題フォーマット | ブーバ-キキ課題オンラインおよびラボ

ブーバ-キキ課題では、参加者に新しい単語と2つの抽象形状が提示され、どの形が単語に最も合っているかを決定するよう求められます。この課題は、学習された意味ではなく、直感的な音と形の関連を捉えることを目的としています。セッションは、主要な実験試行の前に参加者が反応形式に慣れるための短い練習ブロックから始まります。

ブーバ-キキ課題には2つのバージョンがあり、それぞれ使用されるデバイスと入力方法に最適化されています:

デスクトップ版

デスクトップ版では、画面の上に単語が表示され、下には2つの抽象形状が並んで表示されます。参加者は、左の形を選択するにはキーボードの A を、右の形を選択するには L を押して応答します。参加者には、迅速に応答するためにそれぞれのキーに指を置いておくよう指示されています。練習ブロックが主要な課題の前に行われます。

モバイル版

モバイル版では、単語と形状が同じレイアウトで表示されます。参加者は、提示された単語に最も合うと思う形を直接タップして応答します。このバージョンはタッチスクリーンインタラクションに最適化されており、主要な課題が始まる前に練習試行が含まれています。

ブーバ-キキ課題の収集データとメトリクス

ブーバ-キキ課題は、音を視覚的形状と関連付ける方法を明らかにする範囲の行動測定を捉え、クロスモーダル対応と音の象徴性効果を反映します。記録された変数は、研究者が選択パターン、応答時間、該当する場合の正確さ、知覚的一致に影響を与える可能性のある試行特有の特性を評価するのを可能にします。これらの測定は、音と形の関連性の一貫性とクロスモーダル統合の強度を定量化するのに役立ちます。すべての変数は、課題の Variables タブ内で表示およびカスタマイズ可能です。

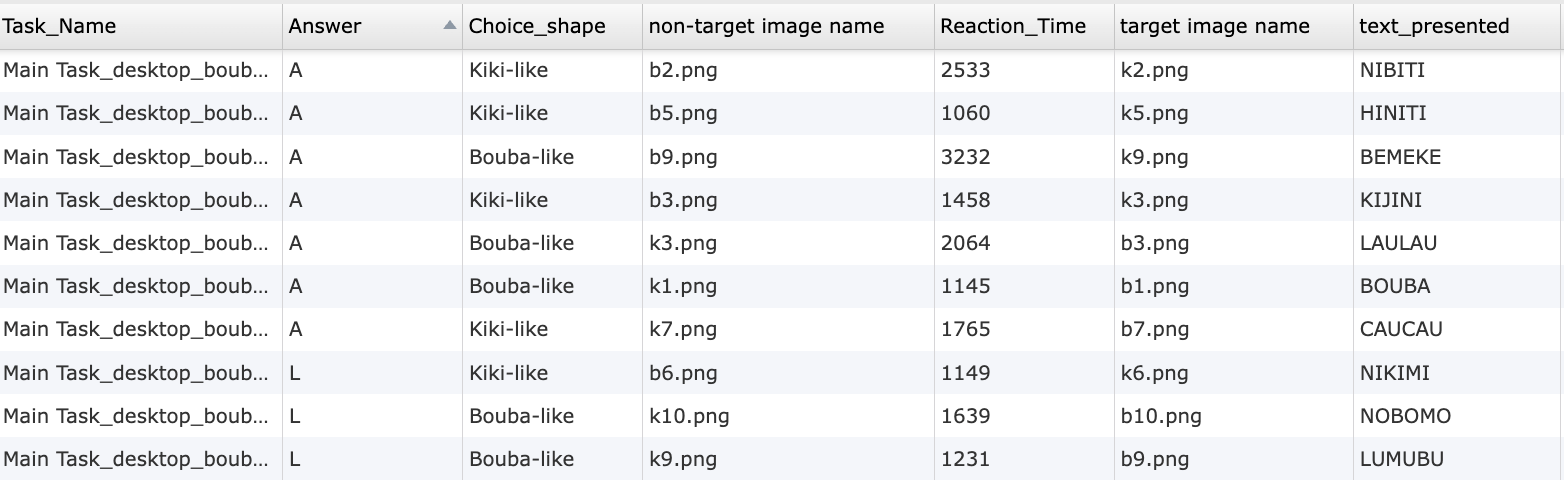

以下は、Labvanced版のブーバ-キキ課題で収集された変数の例です:

| 変数名 | 説明 |

|---|---|

Task_Name | 試行の特定課題の名前を記録します |

Answer | 参加者の応答を記録します(コンピュータ版の場合:その試行で参加者が押したキー(A/L)。モバイル版の場合:クリックされた画像(ターゲット形状/非ターゲット形状) |

Choice_shape | 試行で参加者が選んだ形状 |

non-target image name | 試行で提示された非ターゲット画像のファイル名 |

reaction time | 試行で参加者が応答するのにかかった時間(例:A/Lを押す) |

target image name | 試行で提示されたターゲット画像のファイル名。 |

text_presented | 試行で提示された単語 |

bouba-bouba_avg_RT | ブーバ単語 + ブーバ形状の一致に対する平均RT |

kiki-kiki_avg_RT | キキ単語 + キキ形状の一致に対する平均RT |

Labvancedのオンラインブーバ-キキ課題からの個々の試行レベルの出力を示すデータテーブル。

この実験では、2つの形状と1つの単語が提示されます。参加者は、提示された単語に最も合っていると思う2つの形状のうちの1つを選択しなければなりません。

オンラインおよびラボ研究のためにブーバ-キキ課題を支える技術

ブーバ-キキ課題は、柔軟な刺激処理、マルチモーダルプレゼンテーション、信頼性の高い応答記録を必要とします。Labvancedは、これらの要件を多様な研究デザインでサポートするために必要な技術基盤を提供します。

マルチモーダル刺激プレゼンテーション: 視覚的形状、書かれたテキスト、音声刺激は、同じ試行内で組み合わせることができます。これにより、研究者は実験デザインに応じて視覚的、聴覚的、またはその両方で単語を提示できます。

デバイス間の柔軟な入力収集: 応答は、デスクトップデバイスでのキーボード入力やモバイルデバイスでの直接的なタッチ選択を通じて収集できます。同じ課題のロジックは再利用でき、利用可能な入力方法に合わせてインターフェースを適応させることができます。

コントロールされた研究のためのデスクトップアプリサポート: 精密なタイミングや外部ハードウェアとの統合が必要なラボベースの実験のために、課題はLabvancedデスクトップアプリを使用して展開できます。これにより、EEGやその他のLSLベースのシステムとの互換性がサポートされます。

リモートおよび縦断的展開: 課題はリモートで配信でき、複数のセッションにわたって繰り返し実施できるため、時間の経過に伴う知覚的関連性の安定性や変化を調査する縦断的研究に適しています。

オプションのウェブカメラによる眼球追跡統合: 課題は、ウェブカメラベースの眼球追跡と組み合わせて、形状選択中の視覚的注意、注視パターン、意思決定プロセスを分析することができます。

ウェブカメラ眼球追跡

組み込みの、コードなしで、査読済みのウェブカメラ眼球追跡によって視線パターンと視覚的注意をキャプチャします。

タイミングの精度

時間に敏感なタスクに対してミリ秒単位の正確さで反応時間、タスクパフォーマンスなどをキャプチャします。

デスクトップアプリ

EEGやその他のLSL接続のラボハードウェアと互換性のあるデスクトップアプリを使用して、ラボでの研究を実施します。

ブーバ-キキ課題のカスタマイズ

ブーバ-キキ課題のテンプレートを特定の研究質問に合わせて適応させるための方法はいくつかあります。以下は、この課題を変更する際に研究者が一般的に尋ねるいくつかのテーマです。

形状と刺激デザイン

抽象的な形状は、直接エディタ内で置き換えたり編集したりできる視覚オブジェクトとして実装されています。研究者は、Object Properties パネルを通じて、形状の複雑さ、境界、サイズ、背景色を変更できます。

単語と音声の設定

新しい単語は、テキストオブジェクトまたは音声ファイルとして提示できます。音声刺激はアップロードして試行にリンクでき、発音、タイミング、および繰り返しを正確に制御できます。音声はメディアオブジェクトのオーディオオプションを使用して追加できます。

条件論理と試行のバリエーション

異なる音声的対比や形状のペアリングは試行条件を通じて定義できます。これらの条件値は実行時に読み取られ、各試行で提示される刺激を決定します。Trials & Conditions パネルを最大限に活用してください。

応答処理と試行の流れ

参加者の選択は、クリック、タップ、またはキー押下を通じてキャプチャされ、イベントロジックを使用して評価されます。研究者は、ブーバ-キキ課題中の応答のログ方法(オンラインまたはラボで管理されるかに関わらず)、見逃した応答の処理方法、および試行の進行方法をすべてイベントシステムを介して変更できます。ニーズに合わせてトリガーやアクションを単純に修正してください。

この課題のカスタマイズに関してサポートが必要な場合は、お気軽にお問い合わせください:

ブーバ-キキ課題の推奨される使用法と応用

ブーバ-キキ課題は、知覚、言語、およびマルチセンサリー処理を調査する研究分野で、オンラインおよびラボの設定で広く使用されています。

知覚およびマルチセンサリー統合の研究: 聴覚的および視覚的特徴がどのように統合され、感覚の対応がどのように生じるかを研究するために一般的に使用されます。

言語および音声処理の研究: 子音の鋭さや母音の質などの音声的特徴が知覚的関連にどのように影響するかを調べるために適用されます。

発達研究: 子供や大人とともに、音と形の対応がいつ出現し、どのように発展の過程で変化するかを調査するために使用されます。

跨文化的および言語的研究: 言語や文化的文脈間での知覚的マッピングを比較するために頻繁に使用されます。

神経認知および脳機能の研究: クロスモーダル知覚と象徴的マッピングの根底にある神経メカニズムを探る研究に含まれています。

参考文献

Passi, A., & Arun, S. P. (2024). ブーバ–キキ効果は音の特性によって予測されるが、スピーチの特性では予測されない。注意、知覚、および心理物理、86(3), 976-990。

Piller, S., Senna, I., & Ernst, M. O. (2023). 視覚的経験がブーバ-キキ効果と先天的失明からの視覚回復時のサイズ-重量の錯覚を形成する。Scientific Reports, 13(1), 11435。