Aufbau einer Studie zur Augenverfolgung bei Säuglingen: Objektidentifikationsaufgabe

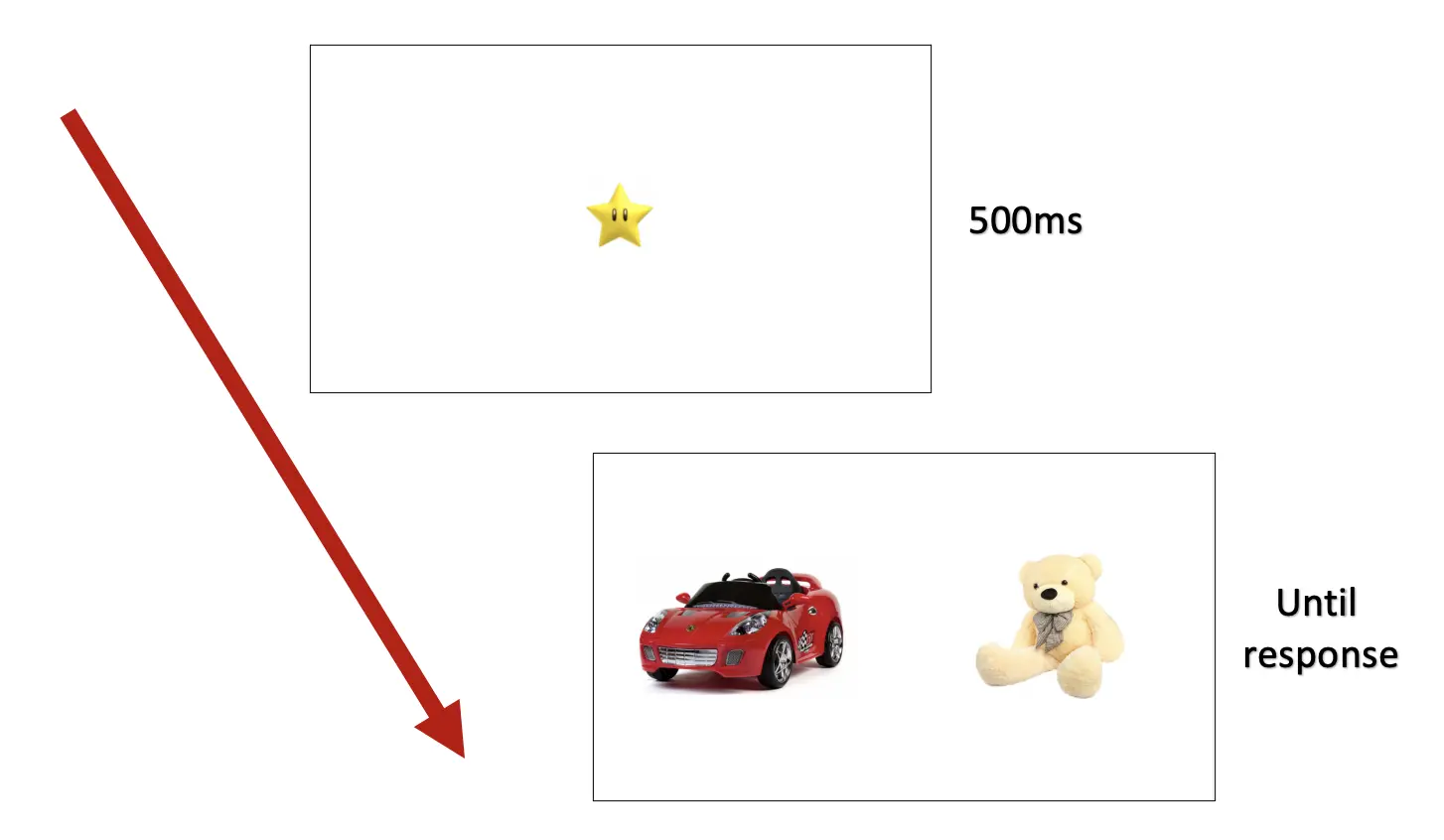

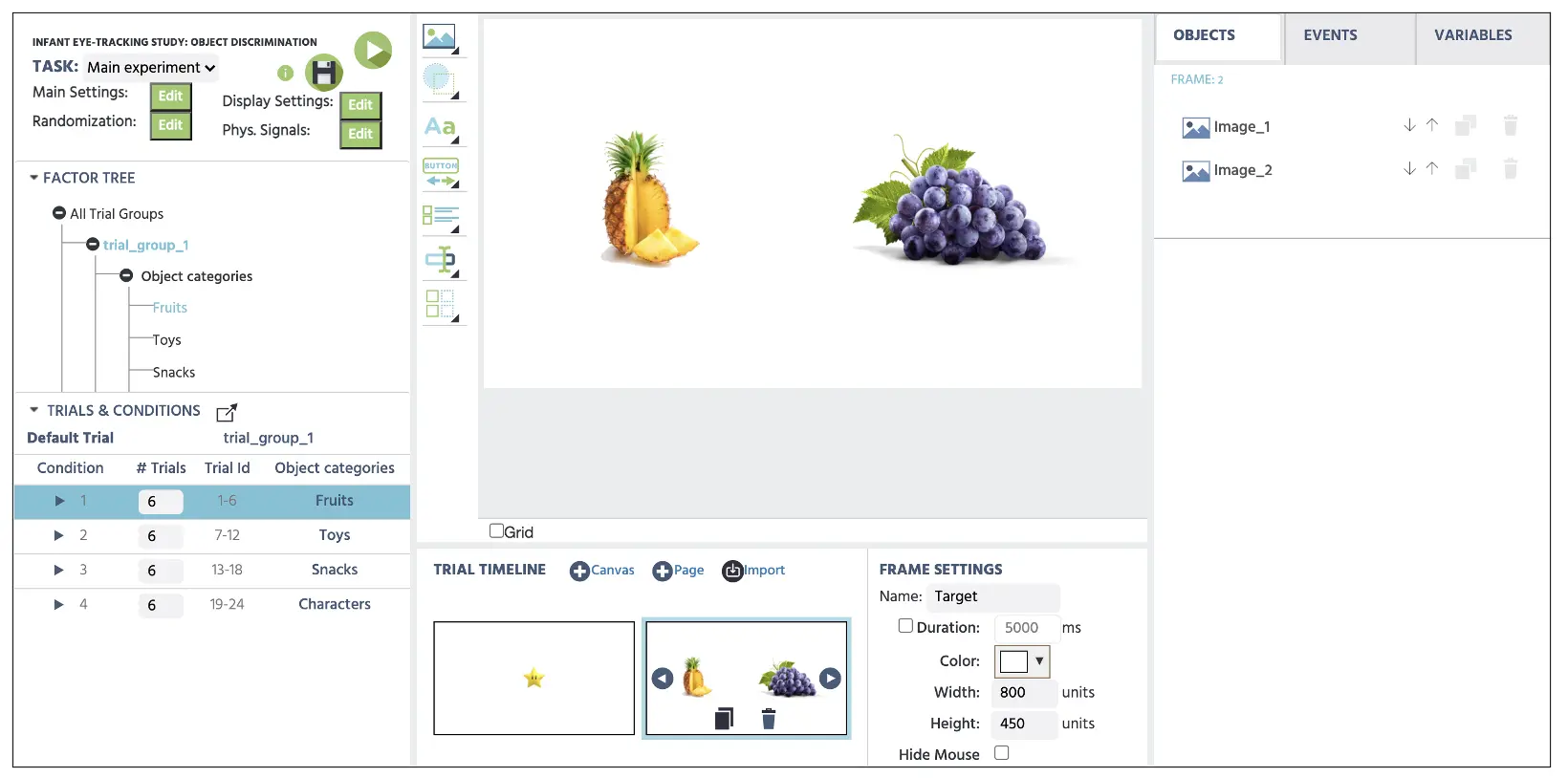

Willkommen zu einer weiteren Anleitung von Labvanced zur Erstellung von Studien! In dieser Anleitung erstellen wir eine Studie zur Augenverfolgung, um die Objektidentifikation und räumliche Aufmerksamkeit von Kindern zu bewerten. In jedem Durchgang richten wir die beiden Objektdisplays ein, bei denen das Kind sein bevorzugtes Objekt äußern und der Elternteil die Auswahl mit der Maus treffen kann (siehe Abbildung 1 unten). Durch die Implementierung der Augenverfolgungsfunktion ermöglicht diese Art von Experimentierparadigma den Forschern, Daten zu sammeln, um Folgendes zu untersuchen, jedoch nicht ausschließlich:

- Räumliche Aufmerksamkeit

- Sprachentwicklung

- Objektkategorisierung

- Gesichtserkennung

Abbildung 1. Anzeige eines Beispielversuchs, der zwei Objekte unter derselben ‚Spielzeug‘-Kategorisierung enthält. In diesem Paradigma wird ein Kind seinem Elternteil sein bevorzugtes Objekt mitteilen, und letzterer wird die Mausdruckantwort auf dasselbe Objekt auslösen.

Abbildung 1. Anzeige eines Beispielversuchs, der zwei Objekte unter derselben ‚Spielzeug‘-Kategorisierung enthält. In diesem Paradigma wird ein Kind seinem Elternteil sein bevorzugtes Objekt mitteilen, und letzterer wird die Mausdruckantwort auf dasselbe Objekt auslösen.

Darüber hinaus werden wir das Experiment im kinderfreundlichen Modus einrichten, der eine kürzere Kalibrierungsdauer mit aufmerksamskapierenden Geräuschen ermöglicht, um die Möglichkeit von Langeweile und Müdigkeit bei Kindern zu verringern. Es ist erwähnenswert, dass die kürzeren Kalibrierungsintervalle mit einer geringeren Genauigkeit der Blickaufzeichnungen verbunden sind. Diese Option hat jedoch dennoch minimale Einschränkungen für das Verhalten von Kindern, die normalerweise nicht für längere Zeit still sitzen können und kürzere Aufmerksamkeitsspannen haben.

Wie bei der Erstellung anderer Studien werden wir dies in 6 Teilen angehen, bestehend aus:

- Systemeinstellung

- Variablenbestimmung (UVs & AVs)

- Frame-Einrichtung

- Stimuli-Einrichtung

- Ereignisse-Einrichtung

- Block-Einrichtung

Für die Anzeigesequenz, die die Teilnehmer sehen werden (siehe Abbildung 2 unten), umfasst der Versuch:

- Frame 1: 500 ms Fixation Anzeige

- Frame 2: Zielanzeige von zwei Objekten, die bis zur Mausdruckantwort bleiben

Abbildung 2. Beispielanzeige einer Versuchsequenz.

Abbildung 2. Beispielanzeige einer Versuchsequenz.

Über diese schrittweise Anleitung hinaus ist auch die vollständige Studienvorlage über diesen Link verfügbar. Darüber hinaus haben wir auch mehrere Videos zur Augenverfolgung, die über den folgenden Link verfügbar sind.

Lassen Sie uns in Teil I eintauchen: Systemeinstellung, um die Augenverfolgungsoptionen im Kontext dieser Einführung einzurichten.

Teil I: Systemeinstellung

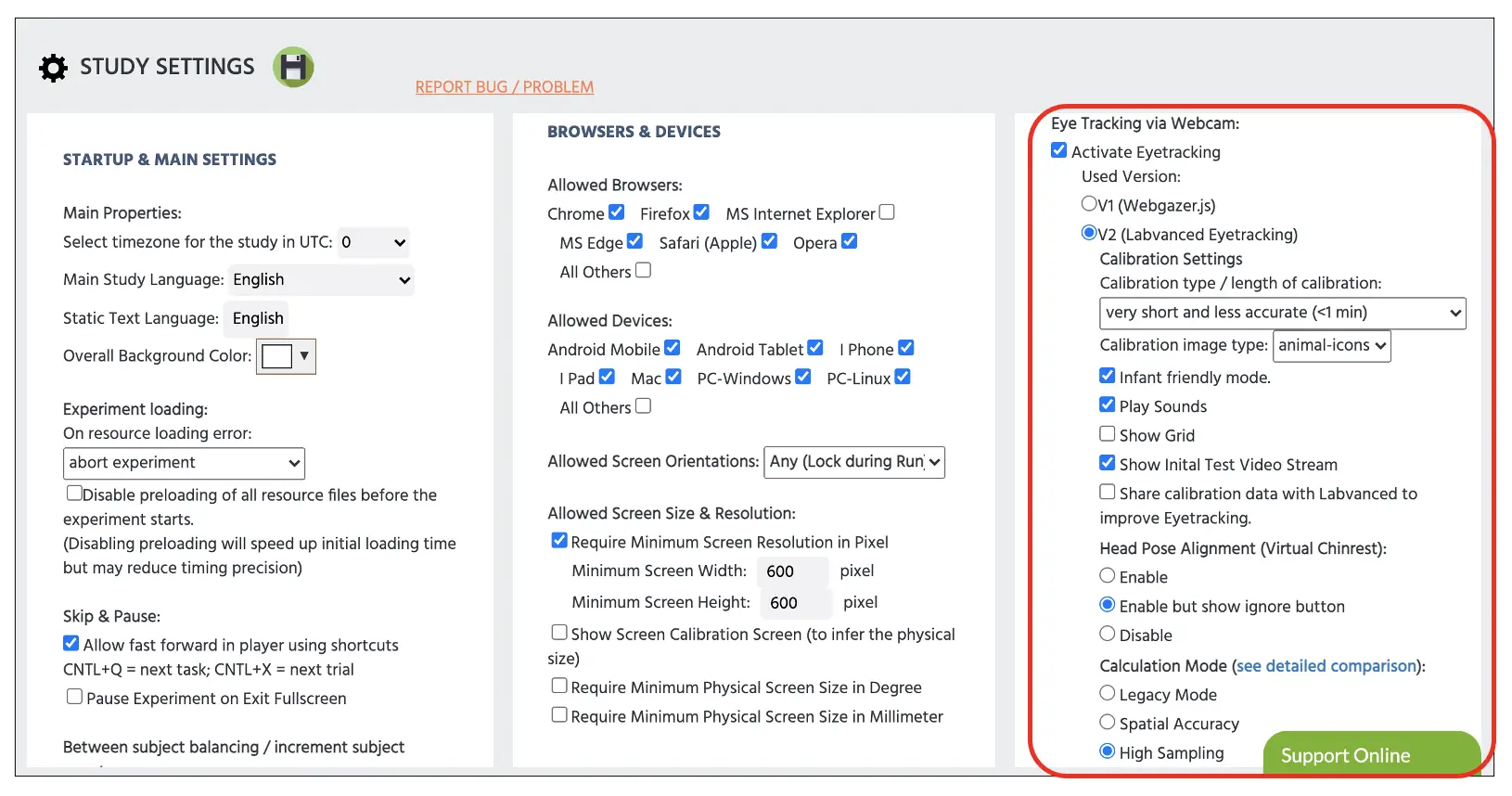

Zunächst ist es wichtig, Labvanced V2 für die Augenverfolgung (Abbildung 3 unten) mit unserem Deep-Learning-Algorithmus auszuwählen. Danach aktivieren wir die Funktion Kinderfreundlicher Modus, die automatisch die Kalibrierungszeit auf <1 Minute einstellen und die Geräuschpräsentation sowie Bilder von Tieren ermöglichen wird, um das Interesse der Säuglinge am Bildschirm zu fördern. In demselben Abschnitt könnten wir auch die Option „Gitter anzeigen“ auswählen, um dem Teilnehmer zu helfen, den nächsten Punkt der Kalibrierung vorherzusehen und so den optimalen Kalibrierungsprozess zu unterstützen.

Wir könnten auch die Option Kopfposition-Ausrichtung auswählen, die als virtuelles Kinnpolster in derselben Anzeige dient. Diese zusätzliche Messung soll die Funktion des physischen Kinnpolsters nachahmen, das im Labor verwendet wird, wobei das Kinn auf der Kopfstütze positioniert wird, um die Stabilität des Kopfes aufrechtzuerhalten. Eine solche Kontrolle könnte jedoch bei Säuglingen schwierig sein, daher könnten wir uns entscheiden, diese Funktion (durch den Elternteil) während der Studie zu deaktivieren oder zu ignorieren. Für die aktuelle Einrichtung werden wir diese Option deaktivieren. Für ausführlichere Informationen zu den anderen Optionen in den Systemeinstellungen verweisen wir auf diesen Link, der allgemeine Inhalte zur Augenverfolgung navigiert.

Nicht zuletzt wählen wir auch die höchste Abtastrate aus, wenn wir die Blickmessung berechnen. Diese bietet die höchste Abtastrate von 30 Hz (30 individuelle Blickpunkte pro Sekunde). Für spezifischere Informationen zu verschiedenen Berechnungsmodi verweisen wir auf diesen Link für einen grundlegenden Vergleich.

Abbildung 3. Anzeige der Seite zur Studieneinstellung. Der Versuchsleiter muss die Option „Augenverfolgung aktivieren“ auswählen, um die folgenden Auswahlen im angezeigten roten Kästchen anzupassen.

Abbildung 3. Anzeige der Seite zur Studieneinstellung. Der Versuchsleiter muss die Option „Augenverfolgung aktivieren“ auswählen, um die folgenden Auswahlen im angezeigten roten Kästchen anzupassen.

Teil II: Variablenbestimmung mit dem Labvanced-Faktorbäumen

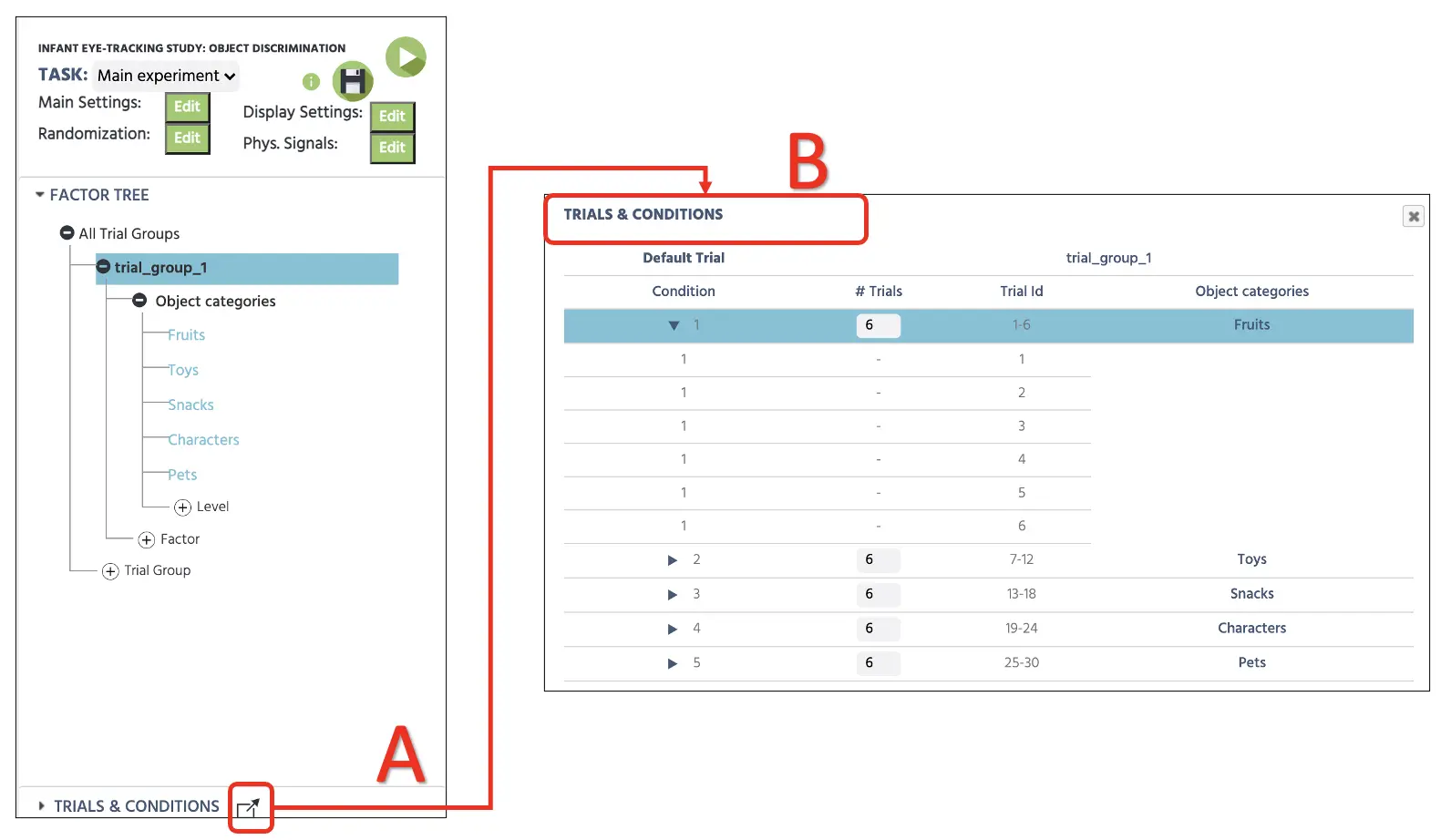

Entsprechend der anderen Studienanleitungen ist die Bestimmung der Variablen und ihrer Ebenen (oder Kategorien) der entscheidende erste Schritt zur Planung der Bedingungen und der anschließenden Versuchseinrichtung. Zunächst schauen Sie sich den Faktorbäumen auf der linken Seite der Labvanced-Anzeige an, um die Faktoren (oder unabhängigen Variablen) und deren zugehörige Ebenen zu bestimmen. Für die aktuelle Studie zur Augenverfolgung bei Säuglingen werden die Faktoren und ihre Ebenen wie folgt aussehen:

Versuchsgruppe → Hauptversuche

- Faktor 1 - Objektkategorie

- a. Früchte

- b. Spielzeuge

- c. Snacks

- d. Charaktere

- e. Haustiere

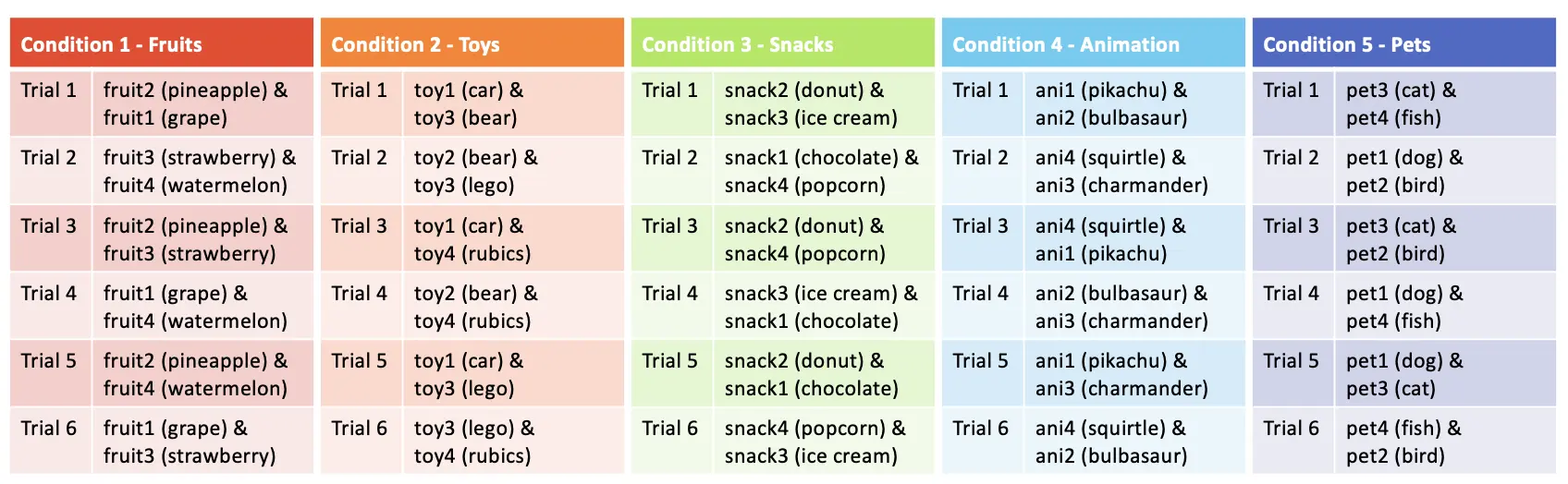

Die vollständige Anzeige dieses Setups im Faktorbaum ist ebenfalls unten abgebildet (siehe Abbildung 4A) mit fünf verschiedenen Bedingungen in den Versuchen & Bedingungen (siehe Abbildung 4B). Wir können auch die Anzahl der Versuche pro Bedingung bestimmen, wobei wir sechs Versuche pro Bedingung evaluieren, sodass insgesamt 30 Versuche in der aktuellen Einrichtung zur Verfügung stehen.

Abbildung 4. Anzeige der Variablenbestimmung mit Ebenen im Faktorbäumen (A) und den entsprechenden Kombinationen mit sechs Versuchen in jeder Bedingung (B). Bedingung 1 zeigt sechs verschiedene Versuchsreihen, die durch Klicken auf das Triangel-Symbol neben der Bedingungennummer angezeigt werden.

Abbildung 4. Anzeige der Variablenbestimmung mit Ebenen im Faktorbäumen (A) und den entsprechenden Kombinationen mit sechs Versuchen in jeder Bedingung (B). Bedingung 1 zeigt sechs verschiedene Versuchsreihen, die durch Klicken auf das Triangel-Symbol neben der Bedingungennummer angezeigt werden.

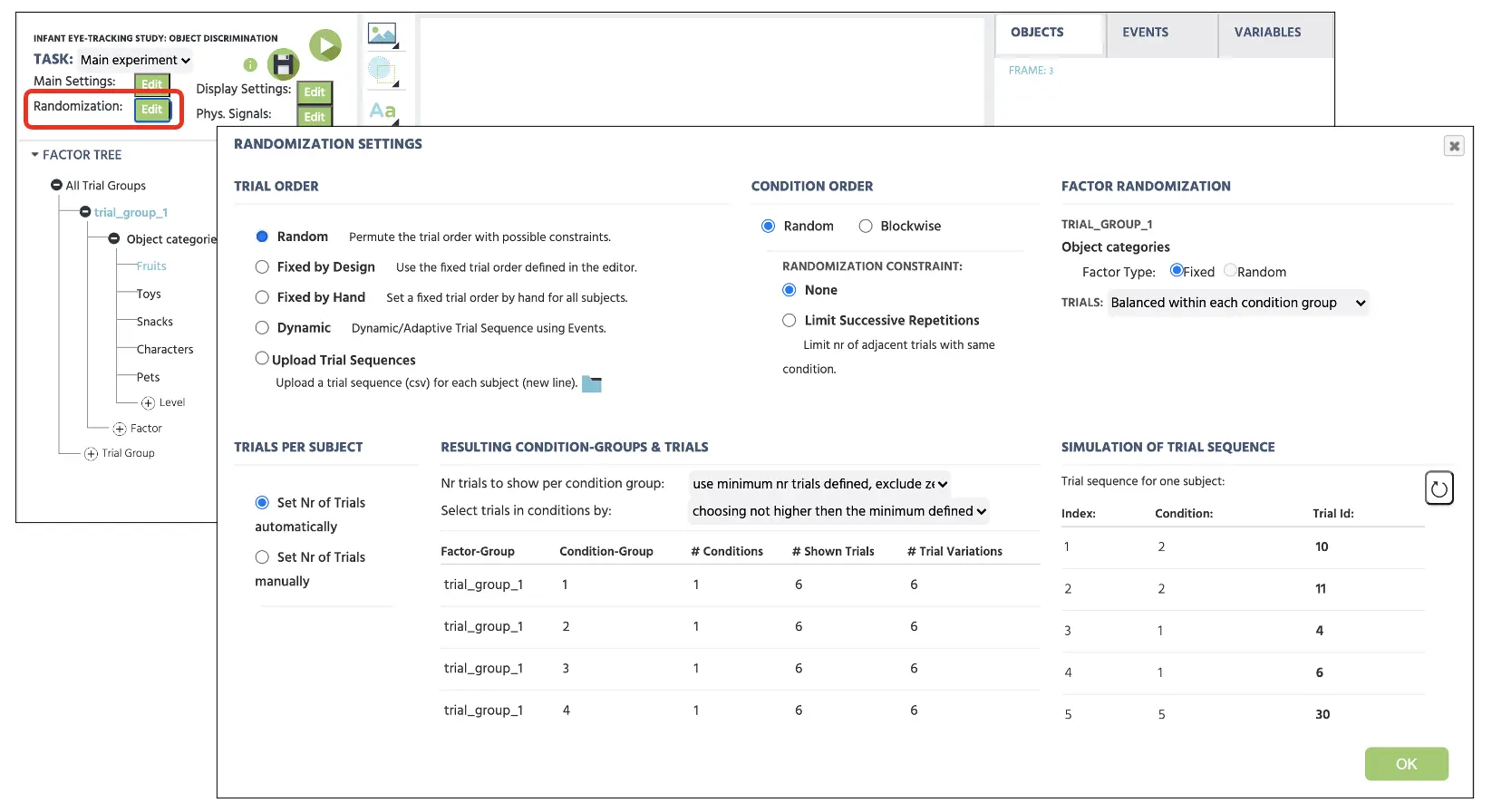

Für die Versuchsrandomisierung wird Labvanced die Präsentation aller 30 Versuche automatisch variieren, abhängig von der Randomisierungseinstellung (siehe Abbildung 5). Die Standardeinstellung bleibt die erste Zufall-Option, die eine zufällige Versuchssequenz generiert, dies könnte jedoch vordefiniert mit verschiedenen Optionen (z.B. Festgelegt nach Design oder Hand) sein. Für jetzt wird die aktuelle Studie ohne Einschränkungen mit Zufall fortfahren, und dies wird die Präsentation der Versuche zwischen den Haupt- und Fangversuchen zufällig variieren. Für weitere Informationen zu den Randomisierungseinstellungen verwenden Sie bitte diesen Link für weitere Details.

Abbildung 5. Anzeige der Randomisierungseinstellung mit ausgewählter Zufallsoption zur zufälligen Präsentation der Versuche ohne Einschränkungen.

Abbildung 5. Anzeige der Randomisierungseinstellung mit ausgewählter Zufallsoption zur zufälligen Präsentation der Versuche ohne Einschränkungen.

Teil III: Frame-Einrichtung

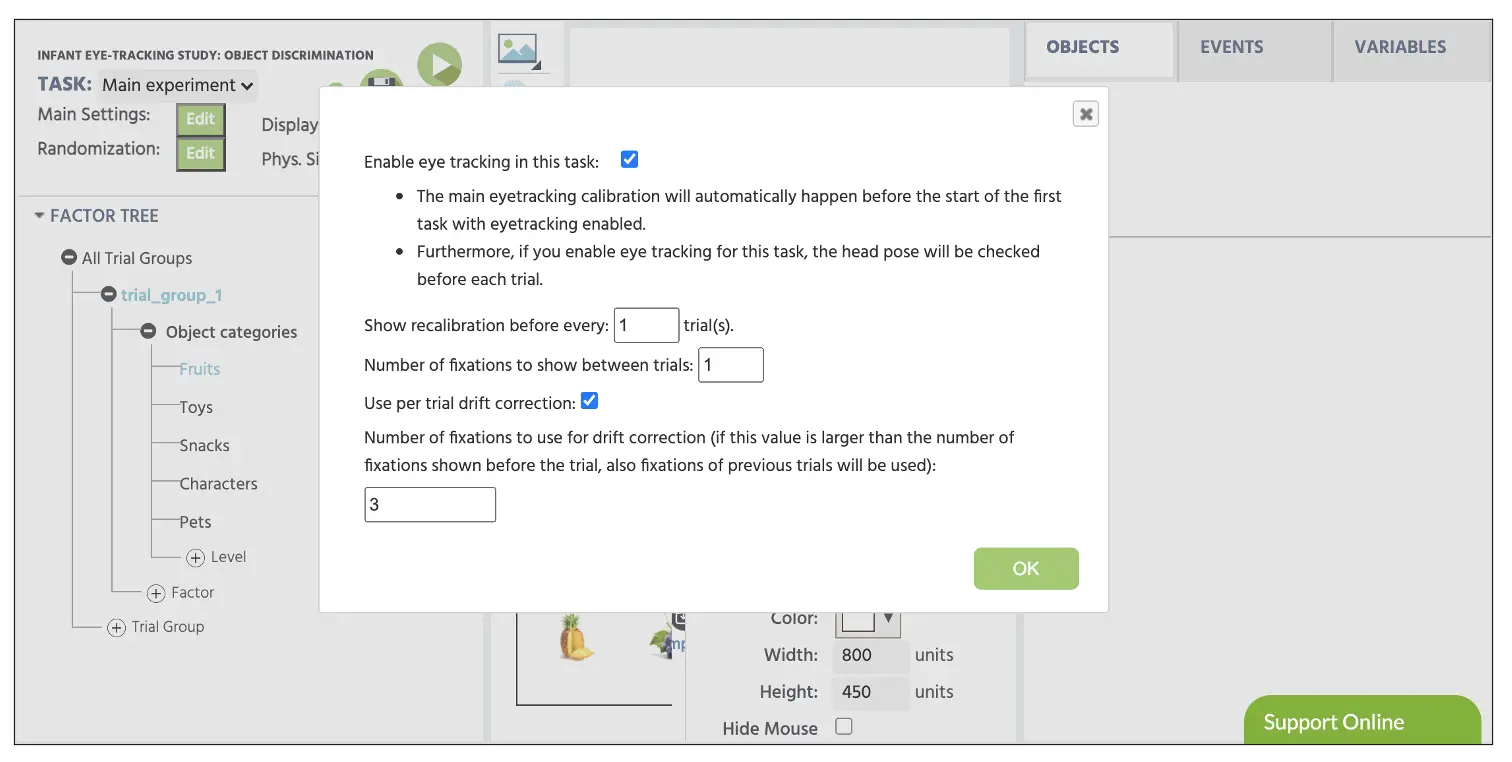

Bevor wir die Frames erstellen, müssen wir die physikalischen Signale einstellen, um Labvanced zu ermöglichen, die Augenverfolgungsfunktion in den folgenden Frames zu implementieren. Um das physikalische Signal einzustellen, klicken Sie auf die Schaltfläche Physikalische Signale oben links auf dem Canvas-Bildschirm (siehe Abbildung 6). Im sich öffnenden Dialogfeld müssen wir die Augenverfolgung in der Aufgabenbearbeitung aktivieren, um die Blickmessung in unserer Studie zu ermöglichen.

Es sollte beachtet werden, dass die Hauptkalibrierung immer vor der ersten Augenverfolgungsaufgabe stattfindet. Wenn wir beispielsweise vier verschiedene Aufgaben in unserer Studie eingerichtet haben (z.B. visuelle Suche, lexikalische Entscheidung, Objektidentifikation und Auslassung in der Aufmerksamkeit), aber nur die zweite Aufgabe (lexikalische Entscheidung) wird die Blickmessung aufzeichnen, wird Labvanced die Kalibrierung vor dieser zweiten Aufgabe und nicht davor anfordern. So kann der Versuchsleiter auch den Zeitpunkt der Kalibrierung je nach ihrem experimentellen Kontrollbedarf steuern.

Die andere Option im gleichen Anzeigefenster ist die Anzahl der Fixationen, die während der Validierungsphase zwischen jedem Versuch angezeigt werden sollen (siehe Abbildung 6). Für die aktuelle Einrichtung werden wir fortfahren und 1 Fixation zwischen jedem Versuch anzeigen, um die Blickmessung während der Intervallzeiten zu validieren. Bei der Untersuchung einer gesunden erwachsenen Population würde eine erhöhte Anzahl von Fixationen zwischen den einzelnen Versuchen die Blickmessungen unterstützen. Da diese aktuelle Studie jedoch auf Säuglinge abzielt, werden wir mit 1 fortfahren, um den Aufmerksamkeitsbedarf zu berücksichtigen. Schließlich setzen wir die Anzahl der Fixationen zur Driftkorrektur auf 3, um die Driftkorrektur zu berechnen. Bei der Korrektur werden frühere Versuche in die Berechnung einbezogen, um den Fehler des Teilnehmers von der Hauptkalibrierung zu berücksichtigen.

Abbildung 6. Anzeige der physikalischen Signale mit dem Standardwert von 1 Fixation zwischen jedem Versuch und einem Driftkorrekturwert von 3.

Abbildung 6. Anzeige der physikalischen Signale mit dem Standardwert von 1 Fixation zwischen jedem Versuch und einem Driftkorrekturwert von 3.

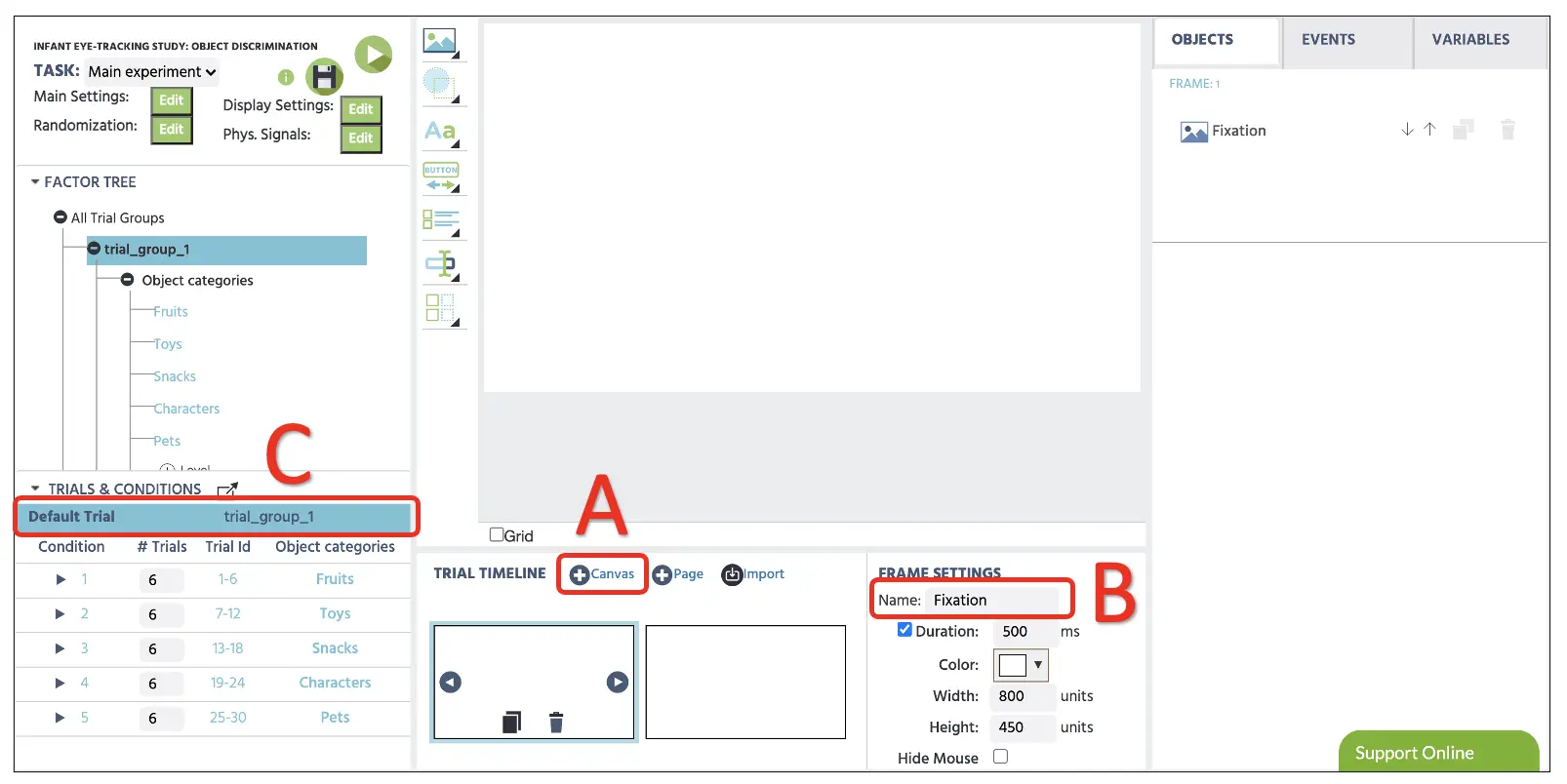

Anschließend erstellen wir die Frames (Stimuli-Präsentation), die die Teilnehmer während ihrer Teilnahme sehen werden. Wieder wird die Objektidentifikationsaufgabe dem allgemeinen Verfahren folgen, das oben erwähnt wurde (siehe Abbildung 2 oben). Wie dargestellt, beginnt ein Versuch mit einem Fixationsbild (Frame 1) für 500 ms, gefolgt von der Präsentation der beiden Bilder (Frame 2), die bis zur Auswahl des Objekts per Mausreaktion verbleiben.

Der Aufbau dieser Frames beginnt, indem Sie auf die Schaltfläche Canvas am unteren Rand der Labvanced-Anzeige klicken (siehe Abbildung 7A). Dies zweimal zu klicken zeigt zwei neue Frames an, und es wäre ideal, jeden Frame sofort zu benennen (z.B. Fixation und Ziel), um die Studienorganisation aufrechtzuerhalten (siehe Abbildung 7B). Bevor wir fortfahren, ist es wichtig, auf den Standardversuch zu klicken, um sicherzustellen, dass diese Reihe hervorgehoben ist (siehe Abbildung 7C). Dieser Teil dient als Standardvorlage für alle unten genannten Bedingungen. Während hervorgehoben wird, gelten alle Änderungen in den Frames für alle Bedingungen (d.h. das Hinzufügen eines Fixationsbildes im 1. Frame gilt für alle 30 Versuche), sodass dies praktisch ist, um unnötige und wiederholte Setups zu vermeiden.

Abbildung 7. Anzeige eines Beispielversuchs mit Frame-Erstellung im Canvas (A), Option zur Namensänderung des Frames (B) und Hervorhebung des Standardversuchs (C).

Abbildung 7. Anzeige eines Beispielversuchs mit Frame-Erstellung im Canvas (A), Option zur Namensänderung des Frames (B) und Hervorhebung des Standardversuchs (C).

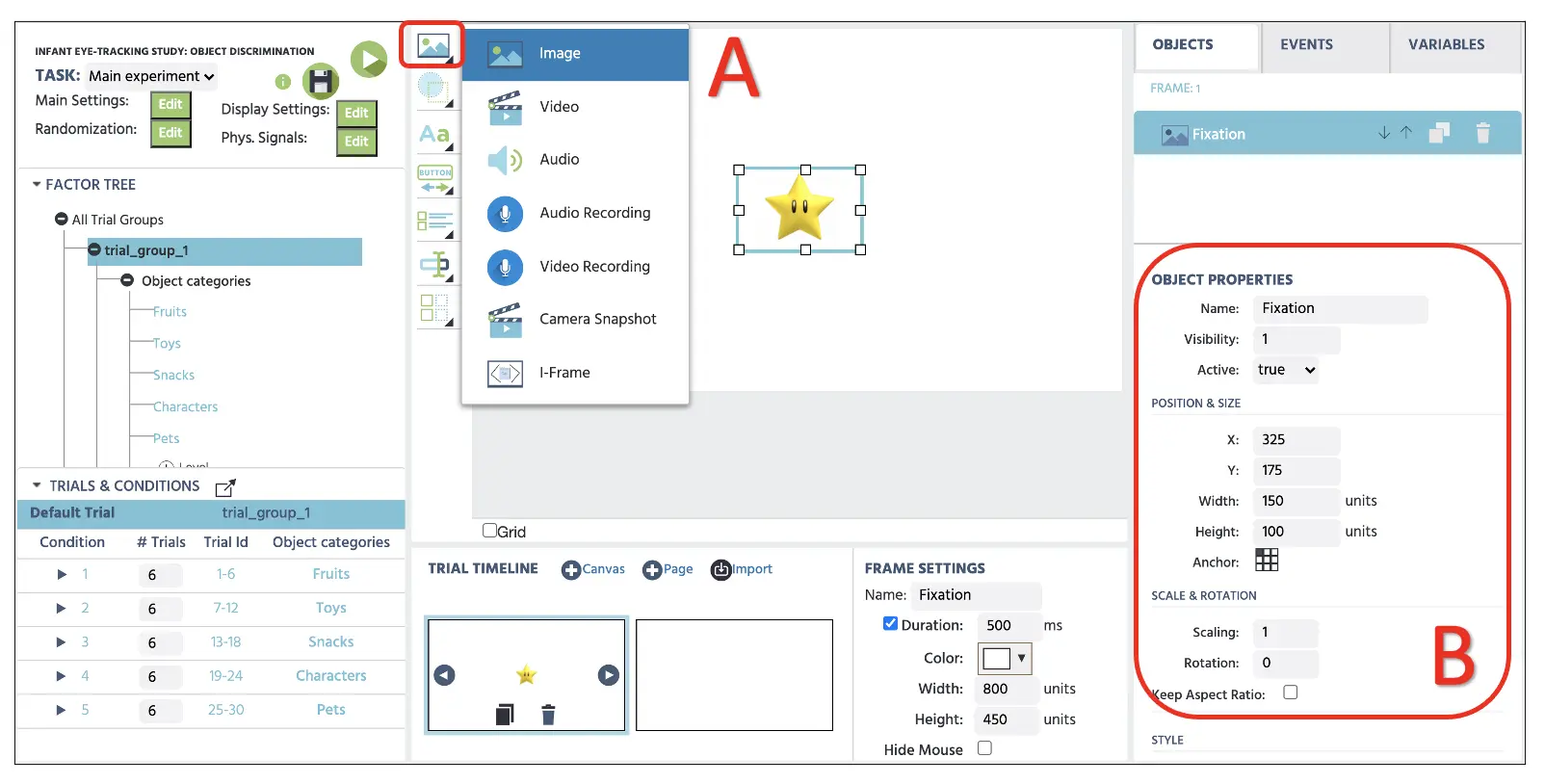

Teil IV: Stimuli-Einrichtung (Fixationsbild und Zielpräsentation)

Frame 1

Bevor wir fortfahren, stellen Sie sicher, dass wir den Standardversuch ausgewählt haben, um Änderungen in diesem Frame für alle 30 Versuche zu implementieren. Mit den beiden Frames, die wir im vorherigen Teil vorbereitet haben, werden wir nun den einzelnen Stimulus in jedem Frame einstellen, beginnend mit dem Fixationsbild im 1. Frame. Dazu können wir damit beginnen, auf die Medienoption zu klicken, um das Bildobjekt auszuwählen (siehe Abbildung 8). Auf der rechten Seite, wo sich die Objektattribute befinden, benennen wir das Bild als Fixation und setzen die folgenden Parameter fest:

- X-Frame-Koordinate: 325

- Y-Frame-Koordinate: 175

- Breite: 150

- Höhe: 100

Abbildung 8. Anzeige der Erstellung des Fixationsrahmens mit der Option „Bild anzeigen“ (A) und Einstellung der Objektattribute (B). Die ausgewählte Bilddatei (fixation.webp) ist ebenfalls über den Stimulus-Link unten verfügbar.

Abbildung 8. Anzeige der Erstellung des Fixationsrahmens mit der Option „Bild anzeigen“ (A) und Einstellung der Objektattribute (B). Die ausgewählte Bilddatei (fixation.webp) ist ebenfalls über den Stimulus-Link unten verfügbar.

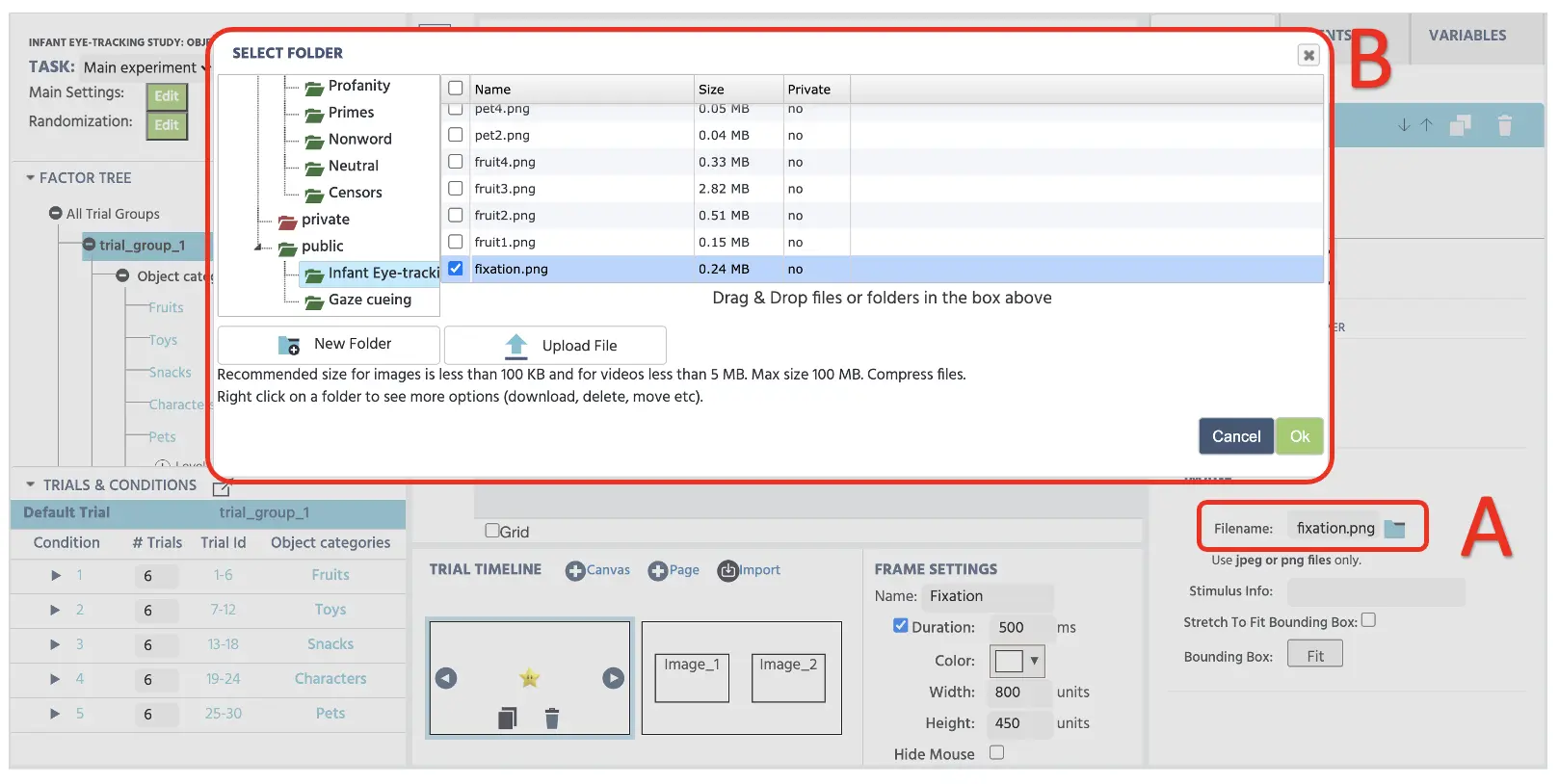

Direkt darunter können wir das Bild aus dem Labvanced-Dateispeicher auswählen, das wir anzeigen möchten. Um das experimentelle Stimuli (z.B. Bilder, Videos, Audio usw.) in den Speicher zu übertragen, können wir auf das Dateisymbol klicken (siehe Abbildung 9 unten), um den Speicher zu öffnen. Danach können wir das Fixationsbild auswählen, um es in diesem Frame anzuzeigen. Dieses Bild sowie andere Stimuli sind über den folgenden Link verfügbar.

Stimuli (Fixations- & Zielbilder)

Abbildung 9. Anzeige der Erstellung des Fixationsrahmens mit dem Zugriff auf den Labvanced-Speicher, indem Sie auf das Dateisymbol klicken (A) und das anschließende Speicherfenster mit übertragenen Stimuli-Dateien (B).

Abbildung 9. Anzeige der Erstellung des Fixationsrahmens mit dem Zugriff auf den Labvanced-Speicher, indem Sie auf das Dateisymbol klicken (A) und das anschließende Speicherfenster mit übertragenen Stimuli-Dateien (B).

Frame 2

Die Einrichtung des 2. Frames wird dem gleichen Verfahren wie in den vorherigen Schritten folgen. Wir werden jedoch den Standardversuch im Abschnitt „Versuche & Bedingungen“ nicht auswählen und stattdessen jede Bedingung auswählen und spezifische Kategorien von Bildern einrichten. Indem wir uns Bedingung 1 ansehen (stellen Sie sicher, dass Bedingung 1 ausgewählt ist), präsentieren wir sechs Versuche mit zwei Obstbildern. Daher werden wir erneut die Medienoption verwenden, um zwei Bildeigenschaften im Canvas einzustellen und auf den Dateispeicher zuzugreifen, um zwei Früchte (fruit2.webp & fruit1.webp) in diesem Versuch anzuzeigen (siehe Abbildung 10 unten). Die verbleibenden fünf Obstversuche zeigen verschiedene Kombinationen von Obstbildern, und wir werden die Tabelle 1 unten befolgen, um alle möglichen Bildkombinationen für alle Bedingungen zu präsentieren.

Abbildung 10. Anzeige des Zielrahmens mit Bildern der Bedingung 1 (fruit1 & fruit 2).

Abbildung 10. Anzeige des Zielrahmens mit Bildern der Bedingung 1 (fruit1 & fruit 2).

Tabelle 1. Anzeige des Plans zur Stimuli-Präsentation für jede Bedingung und deren zugehörige Versuche.

Tabelle 1. Anzeige des Plans zur Stimuli-Präsentation für jede Bedingung und deren zugehörige Versuche.

Teil V: Ereignisse-Einrichtung (Programmierung der Anzeigezeit, Reaktionsbewertung und Variablenaufzeichnung)

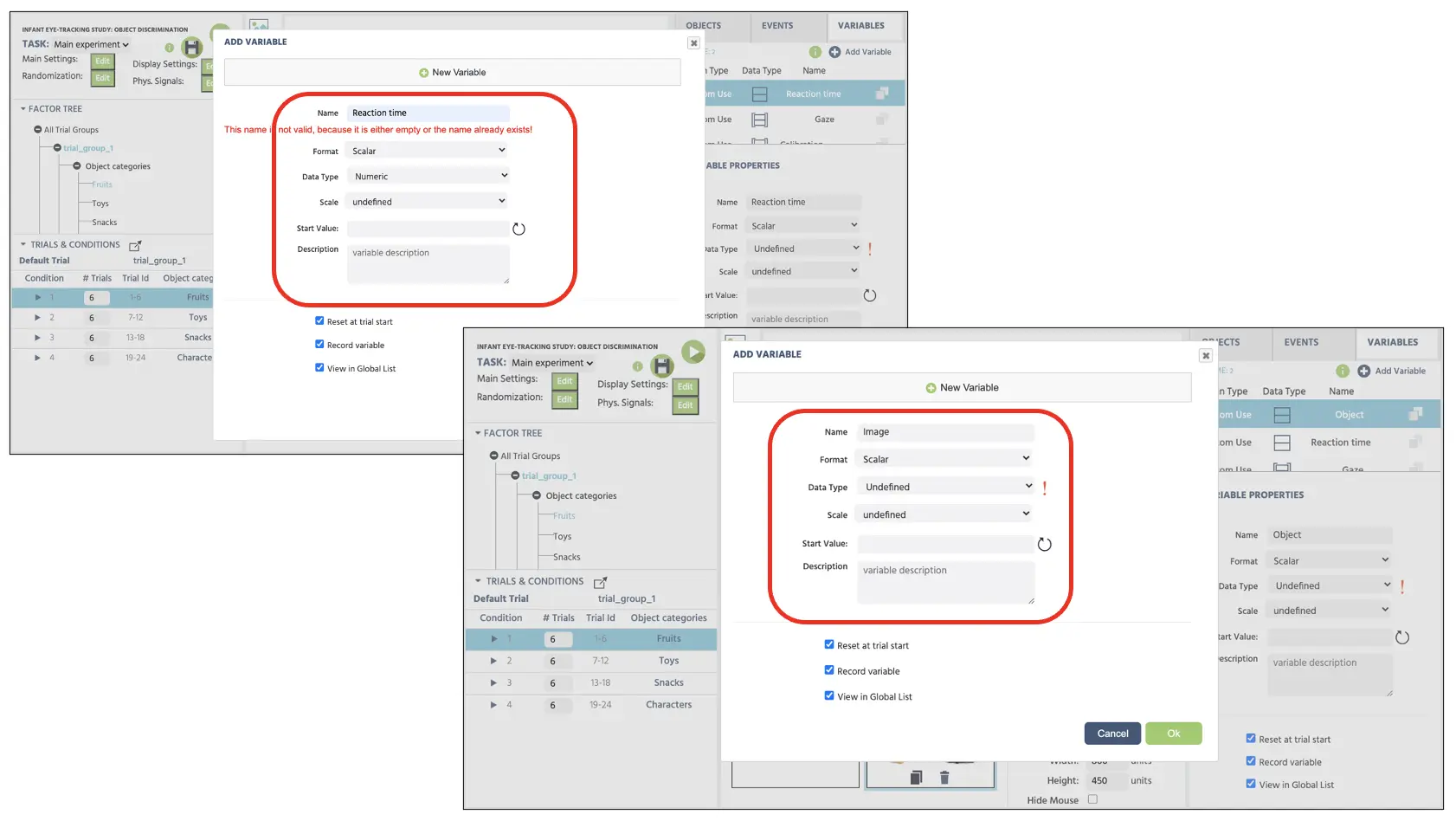

Bevor wir fortfahren, erstellen wir zwei neue Variablen. Zuerst ist die Reaktionszeit, die die Dauer des Mausklicks in Millisekunden speichert, und zweitens die Bild-Variable, die speichert, welches Bild der Teilnehmer mit der Mausreaktion pro Versuch ausgewählt hat. Wir klicken auf die Variablen in der oberen rechten Anzeige und wählen Variable hinzufügen. Im neuen Variablenfenster führen wir die folgenden Schritte für die Namen und variablen Typen durch, die unten in Abbildung 11 angezeigt werden.

Abbildung 11. Anzeige der Erstellung neuer Variablen (Reaktionszeit & Bild). Die Reaktionszeitvariable ist im Datentyp numerisch eingestellt, und die Bildvariable ist als unbestimmter Standardtyp eingestellt.

Abbildung 11. Anzeige der Erstellung neuer Variablen (Reaktionszeit & Bild). Die Reaktionszeitvariable ist im Datentyp numerisch eingestellt, und die Bildvariable ist als unbestimmter Standardtyp eingestellt.

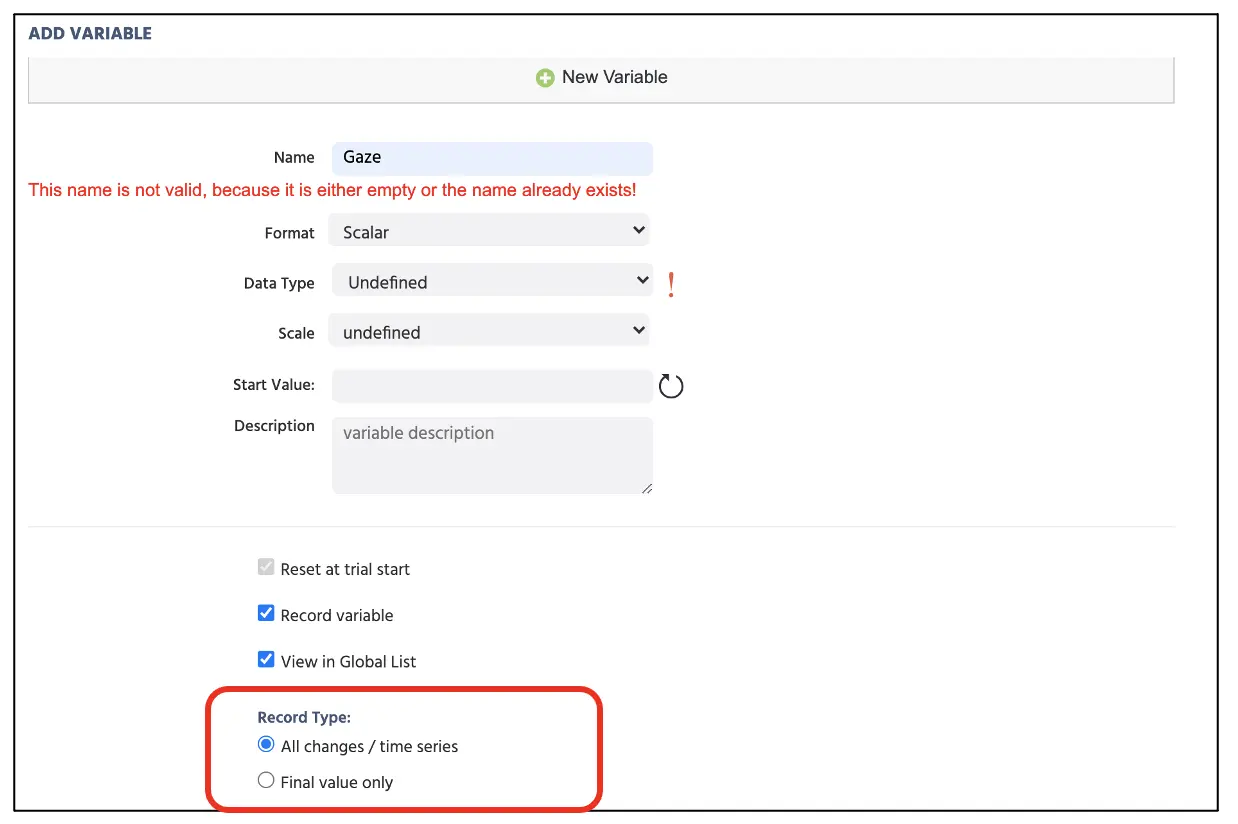

Anschließend erstellen wir eine weitere Variable, die die Daten zur Augenverfolgung in einem Zeitreihenformat speichert, um mehrere Blicke in einem Versuch aufzuzeichnen. Um diese Variable zu erstellen, wählen Sie erneut Variable hinzufügen und führen Sie die gleichen Schritte wie oben beschrieben durch. Im Gegensatz zu den vorherigen Variablen müssen wir den Aufzeichnungstyp als Zeitreihe-Format festlegen, sodass mehrere Blickmessungen in einem gegebenen Versuch gespeichert werden (siehe Abbildung 12 unten).

Abbildung 12. Anzeige der neu erstellten Variable für die Augenverfolgungsdaten mit dem Zeitreihen-Aufzeichnungsformat, das im roten Kästchen angezeigt wird.

Abbildung 12. Anzeige der neu erstellten Variable für die Augenverfolgungsdaten mit dem Zeitreihen-Aufzeichnungsformat, das im roten Kästchen angezeigt wird.

Folgend der allgemeinen Frame-Sequenz aus Teil I (siehe Abbildung 2 oben), werden wir die Ereignisstruktur separat pro Frame erstellen, beginnend mit der Programmierung der Anzeige des Fixationsbildes für 500 ms.

Frame 1 Ereignis: Anzeige des Fixationsbildes

In diesem Frame möchten wir das Fixationsbild in der Mitte der Anzeige für 500 ms präsentieren. Daher ist die logische Reihenfolge in diesem Frame:

- Sobald der Frame beginnt

- 500 ms warten

- Und dann zum nächsten Frame springen

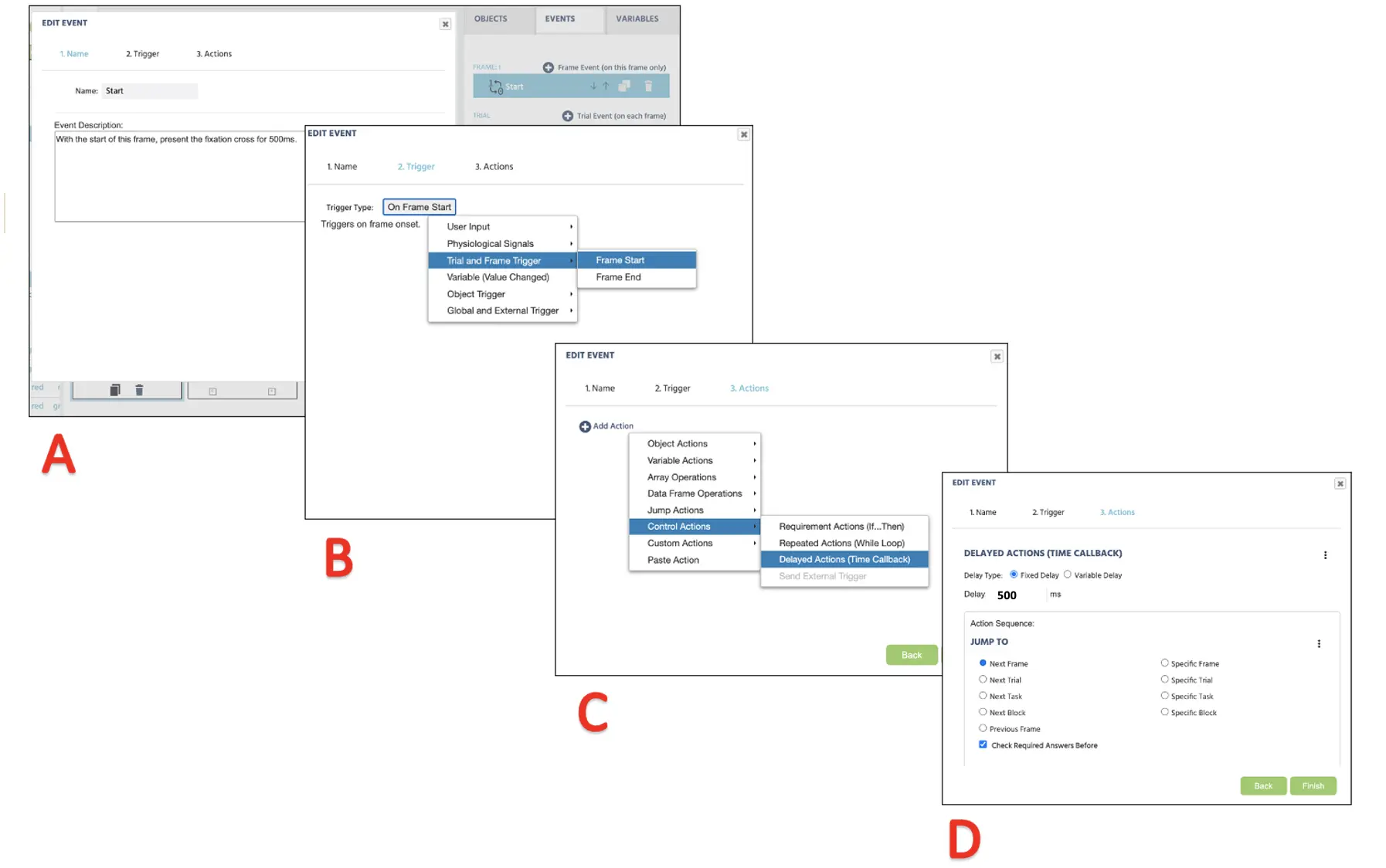

Um dieses Ereignis zu erstellen, klicken Sie auf die Ereignisse oben rechts neben den Variablen und wählen Sie Frame-Ereignis (nur auf diesem Frame). Im ersten Dialogfenster können wir die Ereignisse als „Start“ benennen (Abbildung 13A) und auf Weiter klicken, um zur Trigger-Option fortzufahren. Der Auslösertag ist Versuchs- und Frame-Trigger → Frame-Start (gemäß der 1. logischen Sequenz oben; siehe Abbildung 13B). Mit diesem Trigger möchten wir die 500 ms Frame-Verzögerungsaktion einleiten (2. logische Sequenz); daher kann dies mit Aktion hinzufügen → Verzögerte Aktion (Zeit-Callback) eingestellt werden, und 500 ms wird im Verzögerungsfeld eingegeben (siehe Abbildung 13C). Schließlich klicken Sie in der Aktionssequenzbox auf Aktion hinzufügen und wählen Sie Sprungaktion → Springen zu → nächsten Frame auswählen (siehe Abbildung 13D). Labvanced wird stets dieser logischen Reihenfolge für die Präsentation des Fixationsbildes in allen Versuchen mit dieser Einrichtung folgen.

Abbildung 13. Anzeige der Ereigniserstellung für die Präsentation des Fixationskreuzes (Frame 1), gefolgt von der Namensvergabe des Ereignisses (A), Trigger (B), Bestimmung von Aktionen (C) und Ausführung von Aktionen (D).

Abbildung 13. Anzeige der Ereigniserstellung für die Präsentation des Fixationskreuzes (Frame 1), gefolgt von der Namensvergabe des Ereignisses (A), Trigger (B), Bestimmung von Aktionen (C) und Ausführung von Aktionen (D).

Frame 2 Ereignis: Präsentation von Bildern, Mausklickbewertung und Blickaufzeichnung (Hauptversuche)

In diesem letzten Frame möchten wir die Zielbilder präsentieren und die Mausklickauswahl aufzeichnen, während die Blickbewegungen aufgezeichnet werden. Daher ist die logische Reihenfolge, die wir anstreben werden:

- Sobald der Frame mit den Bildern beginnt

- Auf die Mausklick-Eingabe warten (ausgelöst durch einen linken Mausklick)

- Das ausgewählte Bild aufzeichnen und in der Bildvariable speichern

- Und dann zum nächsten Versuch springen

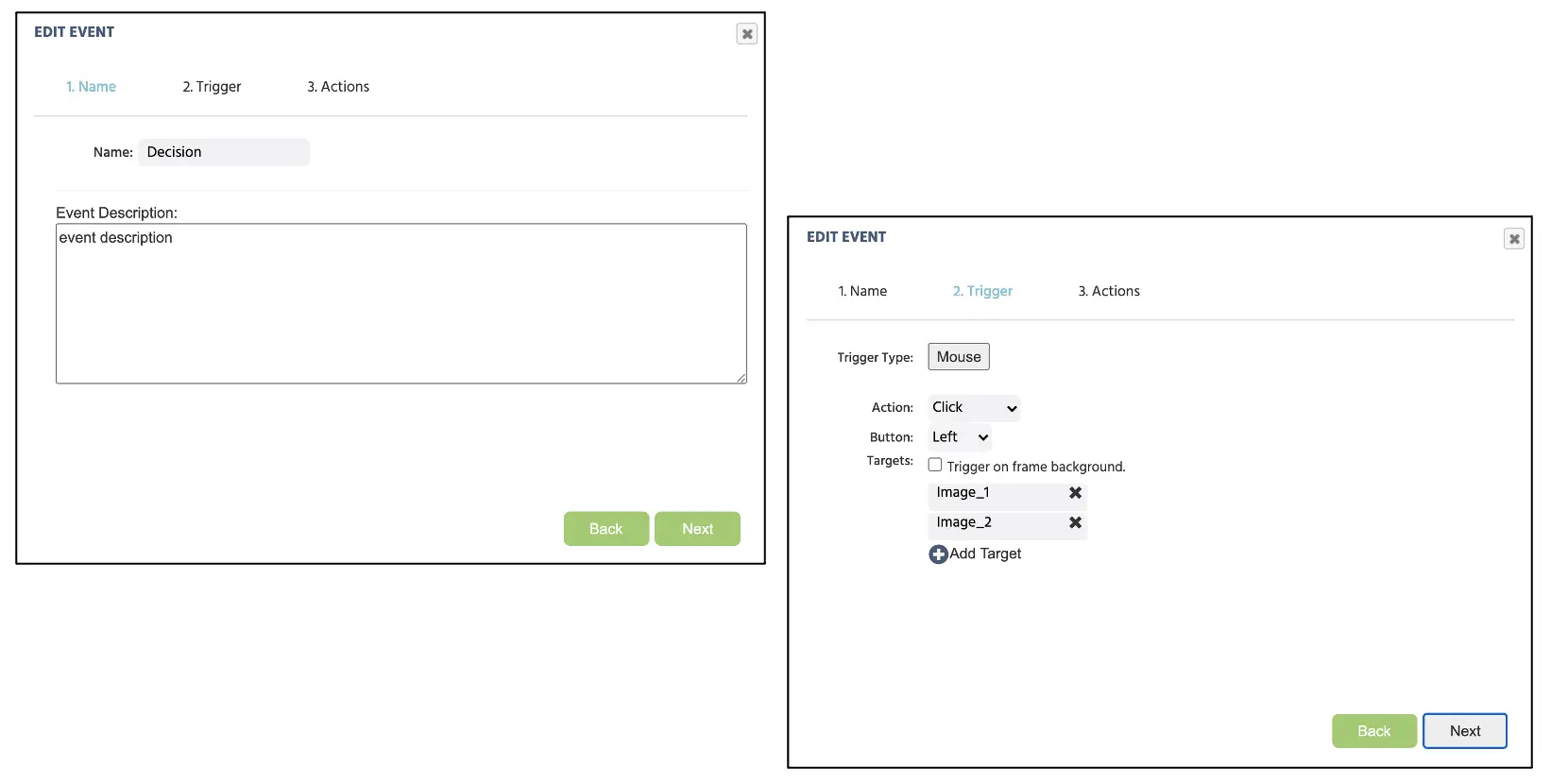

Um das Ereignis einzurichten, stellen wir zuerst sicher, dass der Standardversuch hervorgehoben ist, damit die neuen Änderungen auf alle Versuche angewendet werden. Dann klicken wir auf die Ereignisse in der oberen rechten Ecke des Bildschirms und wählen Frame-Ereignis (nur auf diesem Frame). Hier können wir das Ereignis als „Entscheidung“ benennen. Da dieses Ereignis einen Mausklick des Teilnehmers anzeigt, wäre der Trigger der Benutzereingabe → Mausklick-Trigger. Hier können wir zwei Bilder als verfügbare Ziele festlegen (siehe Abbildung 14 unten).

Abbildung 14. Anzeige der Erstellung des Ereignisses für die Zuordnung der Taste mit der Namensvergabe des Ereignisses (A), Angaben zu den Auslösern mit zulässigen Antworten (B).

Abbildung 14. Anzeige der Erstellung des Ereignisses für die Zuordnung der Taste mit der Namensvergabe des Ereignisses (A), Angaben zu den Auslösern mit zulässigen Antworten (B).

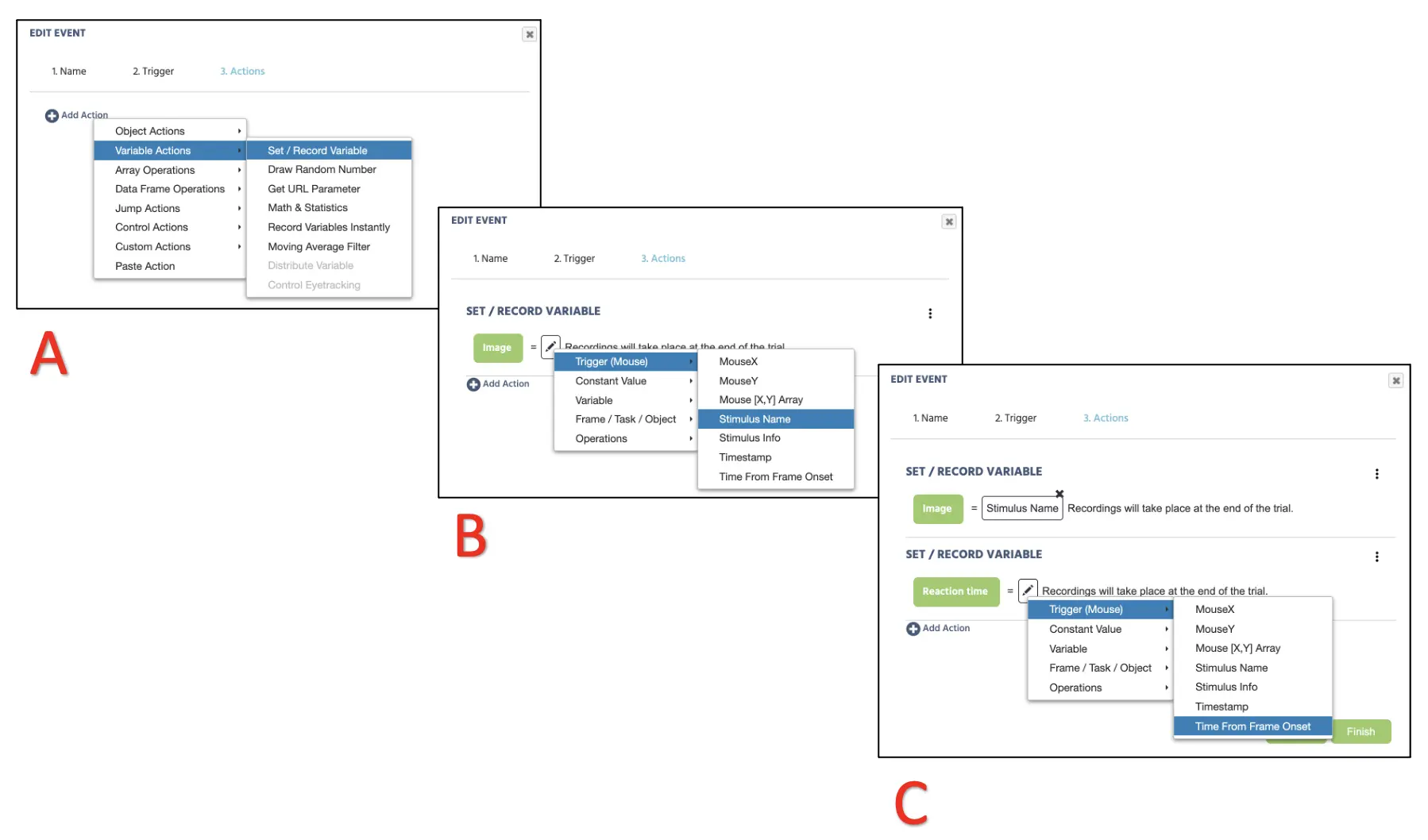

Nachdem Sie auf Weiter geklickt haben, wird die Aktionssequenz mit Variablenaktionen → Setzen/Aufzeichnen von Variablen fortgefahren, und wählen Sie die Bildvariable auf der linken Seite (siehe Abbildung 15A). Rechts fahren wir mit Trigger (Maus) → Stimulus-Name fort (siehe Abbildung 15B), um den Namen des ausgewählten Bildes aufzuzeichnen. Um die Dauer der Mausklickreaktion aufzuzeichnen, klicken Sie weiter unten auf Aktion hinzufügen → Variablenaktionen → Setzen/Aufzeichnen von Variablen und wählen Sie die Reaktionszeit-Variable auf der linken Seite. Rechts fahren wir mit Trigger (Maus) → Zeit ab Frame-Beginn fort (siehe Abbildung 15C).

Abbildung 15. Anzeige der Erstellung des Ereignisses zur Aufzeichnung von Mausklicks (A & B) und zur Erfassung der Reaktionszeit (C).

Abbildung 15. Anzeige der Erstellung des Ereignisses zur Aufzeichnung von Mausklicks (A & B) und zur Erfassung der Reaktionszeit (C).

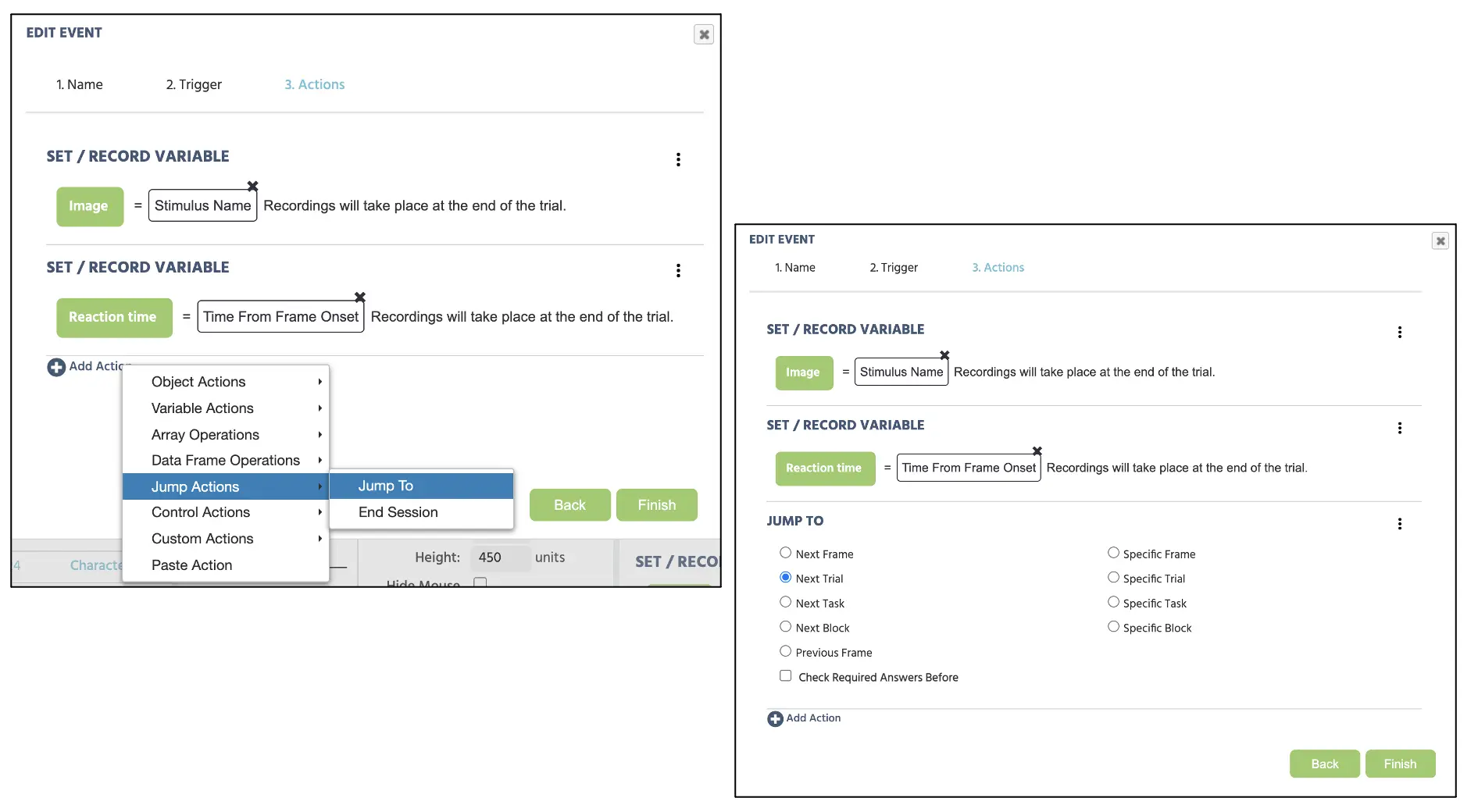

Schließlich möchten wir, dass die Versuche kontinuierlich nach jeder Antwort fortschreiten, daher wählen wir Aktion hinzufügen → Sprungaktionen und wählen Nächster Versuch (siehe Abbildung 16 unten). Klicken Sie auf Fertig am unteren Rand des Fensters, um die endgültige Ereigniseinrichtung für diese Studie abzuschließen.

Abbildung 16. Anzeige der Ereigniserstellung für die Sprungaktion, die die Einrichtung aus Abbildung 14 fortsetzt.

Abbildung 16. Anzeige der Ereigniserstellung für die Sprungaktion, die die Einrichtung aus Abbildung 14 fortsetzt.

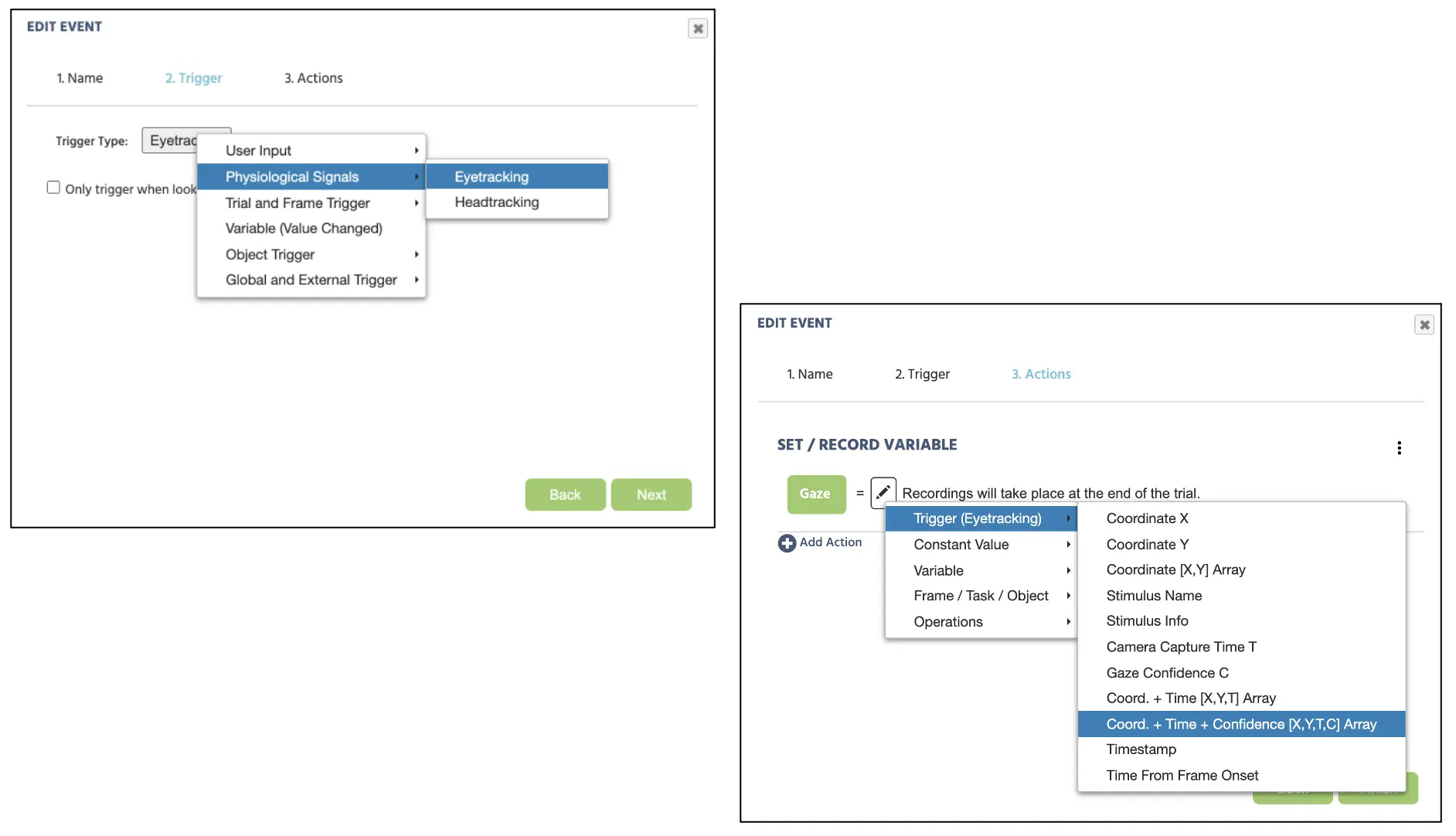

Getrennt davon erstellen wir ein neues Ereignis für die Blickmessung, das dieser Reihenfolge folgt:

- Sobald der Frame beginnt

- Die Blickmessungen aufzeichnen und in der Blickvariable speichern

Um das Ereignis einzurichten, gehen wir erneut zu den Ereignissen in der oberen rechten Ecke des Bildschirms und wählen Frame-Ereignis (nur auf diesem Frame). Hier können wir das Ereignis als „Blick“ benennen und den Trigger Physiologische Signale → Augenverfolgung (Abbildung 17) festlegen. Nach dem Klicken auf Weiter wird die Aktionssequenz mit Variablenaktionen → Setzen/Aufzeichnen von Variablen fortfahren und die Blickvariable auf der linken Seite auswählen (siehe Abbildung 17). Rechts fahren wir mit Trigger (Augenverfolgung) → Koordinaten (X & Y) + Zeit (T) + Vertrauen (C) [X, Y, T, C]-Array fort. Zur besseren Verständlichkeit dieser Array-Daten verweisen Sie auf Teil IV des allgemeinen Augenverfolgungsblogs, der jede [X, Y, T, C]-Messung detailliert beschreibt. Für die aktuelle Anleitung wird damit die Ereignisstruktur eingerichtet, und wir fahren nun mit dem letzten Teil dieser Anleitung fort, in dem wir die Blockstruktur festlegen.

Abbildung 17. Anzeige der Ereigniserstellung zur Aufzeichnung von Blicken.

Abbildung 17. Anzeige der Ereigniserstellung zur Aufzeichnung von Blicken.

Teil VI: Block-Einrichtung

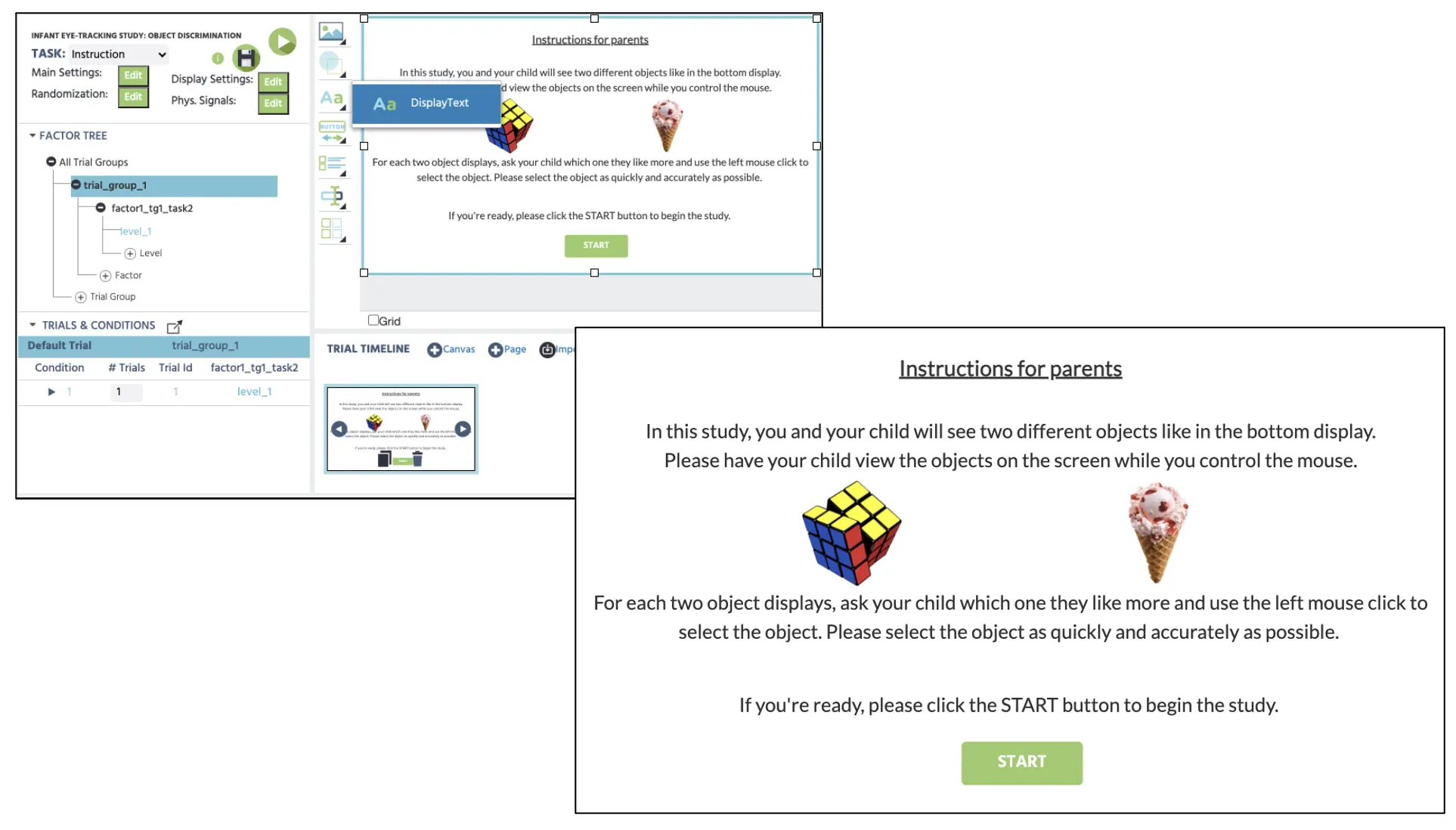

Mit dem Abschluss der Hauptversuchsreihen wird dieser letzte Teil den Instruktionsbildschirm für die Teilnehmer erstellen und ihn mit der Hauptaufgabe zu einem vollständigen Block kombinieren. Auf dem ersten Studienentwurf-Bildschirm erstellen wir eine neue Aufgabe mit dem Namen „Instruktion“ und klicken auf Bearbeiten. Um eine Instruktionsanzeige in dieser neuen Aufgabe zu erstellen, fahren wir fort, indem wir auf das Bildobjekt → Text anzeigen (siehe Abbildung 18A) klicken, um das Textfeld im Canvas zu implementieren. Hier können wir eine beliebige Nachricht für die Anleitung eingeben, und wir werden die folgende Nachricht unten verwenden.

Abbildung 18. Anzeige der Erstellung eines Textelements (oben) für die folgende Instruktionsnachricht (unten).

Abbildung 18. Anzeige der Erstellung eines Textelements (oben) für die folgende Instruktionsnachricht (unten).

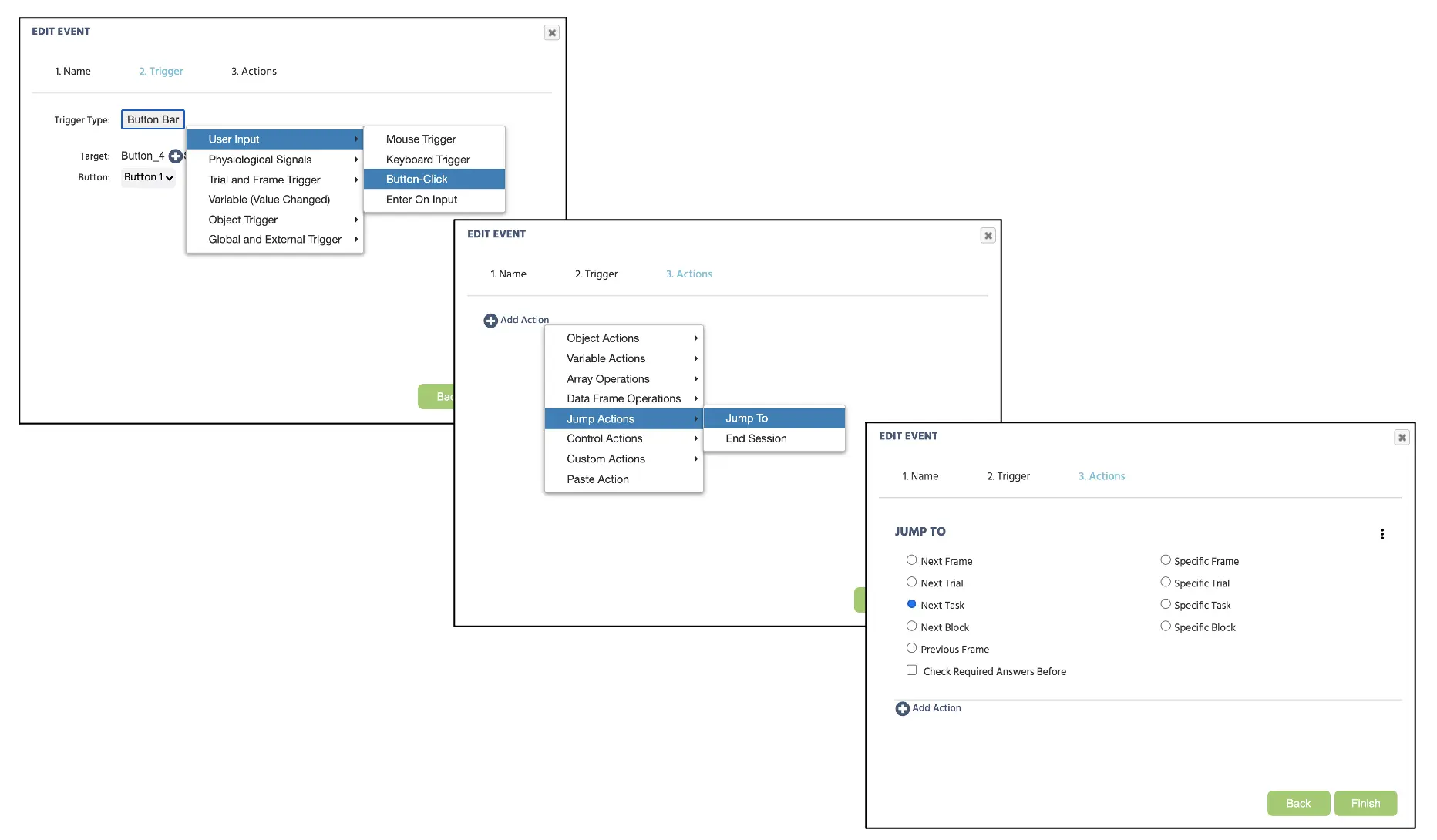

Wie in Abbildung 18 dargestellt, können wir auch die Schaltflächenanzeige einrichten, um nach dem Instruktionsbildschirm zur nächsten Aufgabe fortzufahren. Dazu können wir auf das Schaltflächenobjekt unter dem Textbereich klicken und „START“ in die Schaltfläche eingeben. Danach richten wir das neue Ereignis ein, indem wir auf die Ereignisse in der oberen rechten Ecke des Bildschirms klicken und Frame-Ereignis (nur auf diesem Frame) auswählen. Hier können wir das Ereignis als „Start“ benennen und den Trigger Physiologische Signale → Button-Klick (Abbildung 19) festlegen. Nach dem Klicken auf Weiter wird die Aktionssequenz mit Aktion hinzufügen → Sprungaktionen fortgesetzt und die Option „Nächste Aufgabe“ ausgewählt (siehe Abbildung 19 unten). Klicken Sie auf Fertig am unteren Rand des Fensters, um die Ereigniseinrichtung für diese Instruktionsaufgabe abzuschließen.

Abbildung 19. Anzeige der Erstellung eines Ereignisses für die Schaltflächenreaktion auf die Anweisungsaufgabe.

Abbildung 19. Anzeige der Erstellung eines Ereignisses für die Schaltflächenreaktion auf die Anweisungsaufgabe.

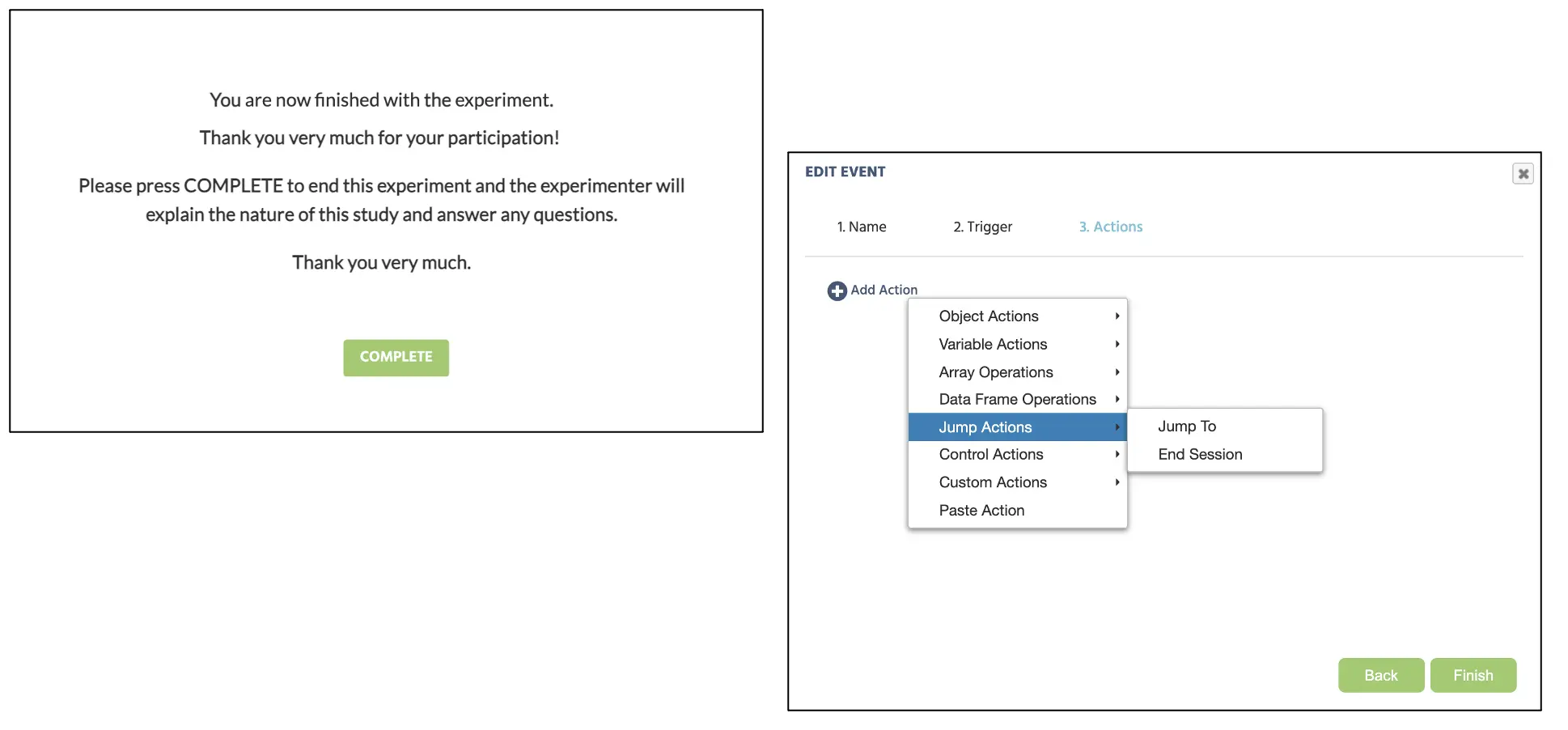

Anschließend können wir dieses gesamte Verfahren bei der Erstellung der Anweisung wiederholen, um die finale Dankesnachricht für die Teilnehmer zu gestalten. Hier werden wir die folgende Nachricht unten (Abbildung 20) hinzufügen, mit der „FERTIG“-Schaltfläche, die das Experiment beendet. Um dieses letzte Ereignis zur Beendigung des Experiments festzulegen, klicken wir erneut auf Ereignisse → Frame-Ereignis (nur auf diesem Frame). Hier können wir das Ereignis als „Fertig“ benennen und den Trigger Physiologische Signale → Button-Klick festlegen. Nach dem Klicken auf Weiter wird die Aktionssequenz mit Aktion hinzufügen → Sprungaktionen fortgesetzt, und die Option „Sitzung beenden“ ausgewählt (siehe Abbildung 20 unten). Klicken Sie auf Fertig am unteren Rand des Fensters, um die Ereigniseinrichtung für diese Instruktionsaufgabe abzuschließen.

Abbildung 20. Anzeige der finalen Nachricht und der Ereigniserstellung für die Schaltflächenreaktion zur Beendigung der Studie.

Abbildung 20. Anzeige der finalen Nachricht und der Ereigniserstellung für die Schaltflächenreaktion zur Beendigung der Studie.

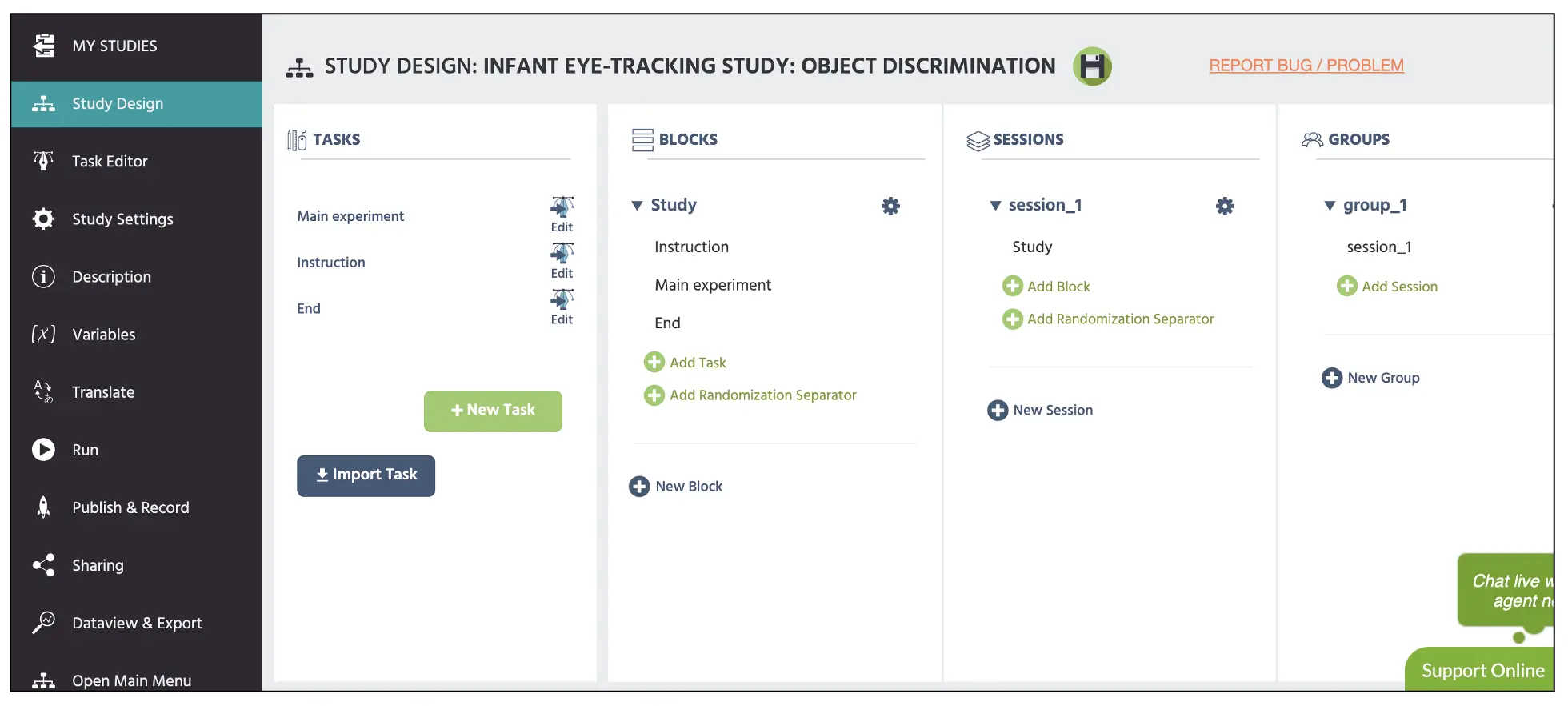

Damit haben wir jetzt drei abgeschlossene Aufgaben im Studienentwurf, die aus der Hauptversuchsaufgabe, der Anleitung und dem Ende bestehen. Wir werden diese dann in der Blockspalte gruppieren (bezeichnet als „Studie“), die der gesamten Sequenz der Studienpräsentation folgt (siehe Abbildung 21 unten). Schließlich stellen Sie sicher, dass der Studienblock unter dem Sitzungsblock eingerichtet ist.

Abbildung 21. Anzeige der Hauptstudienentwurfseite mit dem oberen roten Kästchen, das die Blockeinrichtung mit den drei Aufgaben (Haupt-, Instruktions-, Endaufgabe) anzeigt, die Während dieser Anleitung erstellt wurden.

Abbildung 21. Anzeige der Hauptstudienentwurfseite mit dem oberen roten Kästchen, das die Blockeinrichtung mit den drei Aufgaben (Haupt-, Instruktions-, Endaufgabe) anzeigt, die Während dieser Anleitung erstellt wurden.

Das Einzige, was in dieser Anleitung noch verbleibt, sind das Einwilligungsdokument, der Übungsblock, demografische Fragen und andere Protokolle, aber das variiert je nach Forscher und Institution, um diese Anleitung zu beenden. Für weitere Informationen zur Erstellung von Texten besuchen Sie bitte unsere Ressourcen link für zusätzliche Informationen. Darüber hinaus ist die erstellte Studie auch als Vorlage in unserer Bibliothek über diesen Link zusammen mit anderen experimentellen Paradigmen verfügbar. Damit hoffe ich im Namen des Labvanced-Teams das Beste für all Ihre wissenschaftlichen Bestrebungen und bete, dass diese Anleitung als wichtiger Grundstein für den Aufbau Ihrer Studie dient.