Newsletter-Archiv

Inhaltsverzeichnis - Newsletter

Q'1-2026 Newsletter

Neue Labvanced Lizenzstruktur - Update Wir freuen uns, den erfolgreichen Rollout unseres aktualisierten Lizenzsystems bekannt zu geben. Nachfolgend finden Sie eine Zusammenfassung der wichtigsten Änderungen, die nun in Kraft sind:

- Neue Lizenzstruktur nun in Kraft: Die neue Lizenzstruktur in Labvanced wurde offiziell eingeführt und ist nun vollständig in Kraft.

- Treuerabatte angewendet: Treuerabatte wurden erfolgreich auf alle bestehenden Kunden im Rahmen dieses Übergangs angewendet.

- Updates zu Mehrbenutzerlizenzen: Für Mehrbenutzerlizenzen wurde eine primäre E-Mail-Domain zugewiesen, um eine ordnungsgemäße Kontoverwaltung und eine faire Lizenznutzung sicherzustellen. Bitte überprüfen Sie Ihren Lizenz-Tab, um zu bestätigen, dass alles korrekt aussieht, und wenden Sie sich an uns, wenn Sie Probleme bemerken oder Fragen haben.

- Lehr- und Campuslizenzen verfügbar: Lehrlizenzen sind ideal für den Unterricht, bei dem jeder Schüler sein eigenes Konto haben kann, während Campuslizenzen für den campusweiten Gebrauch konzipiert sind. Mehr erfahren.

- Zusätzliche Dienstleistungen formalisiert: Zusätzliche Labvanced-Dienste wurden formalisiert, einschließlich der Möglichkeit, Dienstleistungen zur Studienerstellung, Teilnehmerrekrutierung und dedizierte Supportstunden zu kaufen.

NEUE FUNKTIONEN & FUNKTIONALITÄTEN

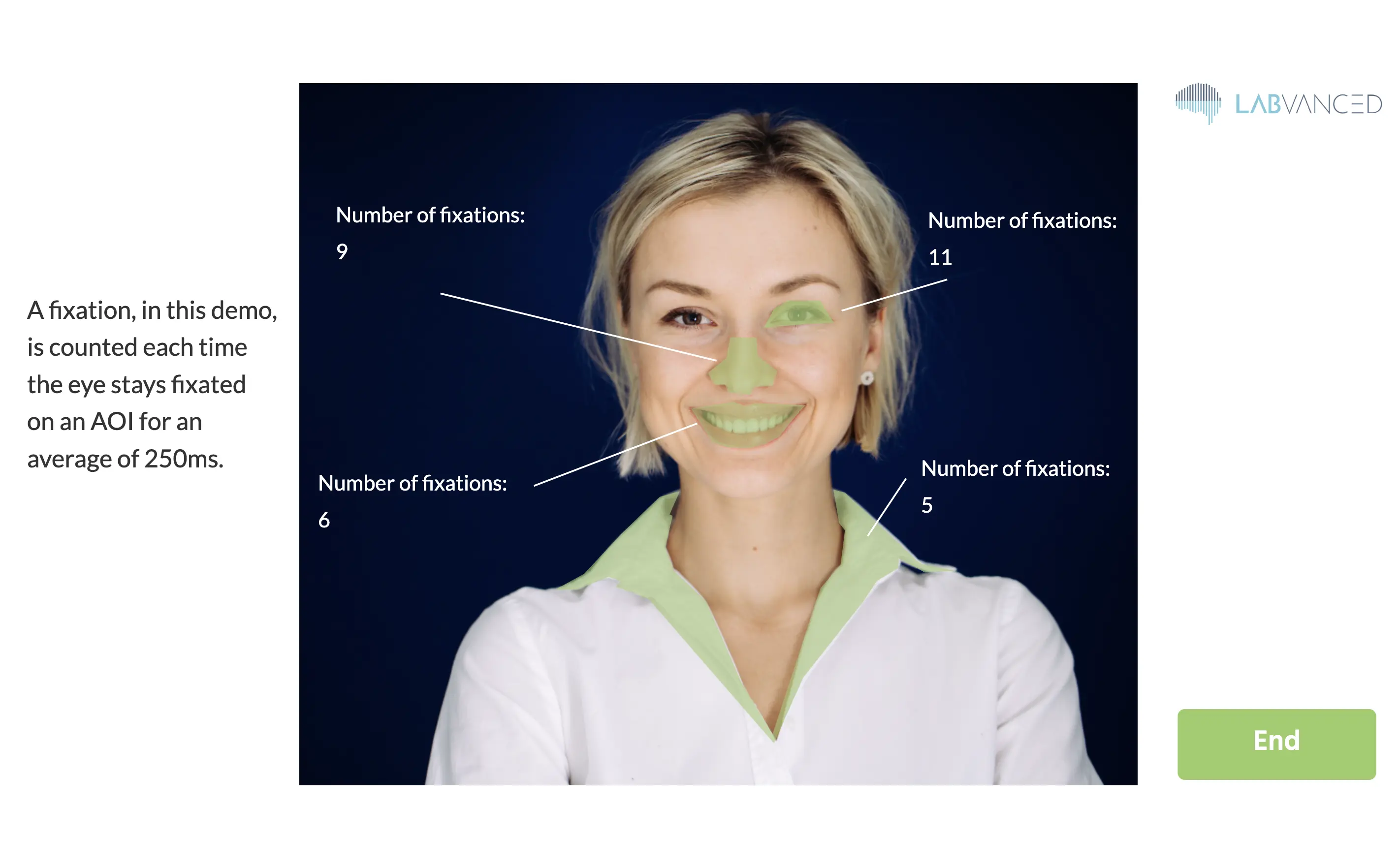

- Emotionserkennung: Die Emotionserkennung von Labvanced nutzt Standard-Webcams, um die emotionalen Reaktionen der Teilnehmer automatisch in Echtzeit zu erfassen (keine spezielle Hardware erforderlich), indem subtile Gesichtsausdrücke erfasst und in kontinuierliche emotionale Datenströme übersetzt werden, wodurch jede Online-Studie in ein skalierbares affektives Labor verwandelt wird. Alle Verarbeitung findet clientseitig statt, was die Einhaltung der DSGVO gewährleistet und garantiert, dass keine Gesichtsdaten jemals extern übertragen oder gespeichert werden. Mehr erfahren.

- HD-Video: Die Full HD-Videoauflösung (1920 × 1080 Pixel) ist jetzt für Videoaufzeichnungen verfügbar. Zusätzlich können die Benutzer das gewünschte Bitrateneinstellung auswählen – Standard, Hoch oder Sehr Hoch – basierend auf ihren Qualitäts- und Speicheranforderungen. Das Dateiformat kann ebenfalls angegeben werden: Wenn es vom während der Datenerfassung verwendeten Browser unterstützt wird, werden Aufzeichnungen im .mp4-Format gespeichert; andernfalls werden sie im .webm-Format gespeichert. Diese Verbesserungen sind für Forscher wichtig, da sie mehr Kontrolle über die Videoqualität und die Dateikompatibilität bieten, wodurch eine genauere Datenerfassung und verbesserte Flexibilität für Analyse und Teilen ermöglicht werden. Mehr erfahren.

VERBESSERUNGEN

- Erweiterte Steuerungen für die Fernherzfrequenzmessung (rPPG): Zusätzliche Einstellungen wurden eingeführt, um die Kontrolle und Zuverlässigkeit der rPPG-Messungen zu verbessern:

- i.) rPPG zu Studienbeginn initialisieren – rPPG berechnet gewichtete Durchschnitte über die Zeit und benötigt möglicherweise 10 Sekunden oder mehr zur Initialisierung. Das Aktivieren dieser Einstellung stellt sicher, dass die Herzfrequenzmessungen bereit sind, bevor die Hauptaufgabe beginnt (außer in Fällen, in denen rPPG bereits in der ersten Aufgabe aktiviert ist).

- ii.) Warten auf Herzfrequenzvertrauen – Wenn aktiviert, wartet die Studie, bis die Herzfrequenzmessung ein definiertes Vertrauensniveau erreicht, bevor sie fortfährt. Wenn das Vertrauen während des Experiments unter den angegebenen Schwellenwert fällt, wird die Studie automatisch pausiert. Das hilft sicherzustellen, dass nur zuverlässige Herzfrequenzdaten gesammelt werden.

- Diese Verbesserungen sind für Forscher wichtig, da sie die Datenzuverlässigkeit erhöhen und sicherstellen, dass physiologische Messungen vor und während der Datenerfassung Qualitätsstandards erfüllen. Mehr erfahren.

- Verbesserte Nutzbarkeit und Zugriff auf Videoanrufe: Labvanced API-Schlüssel sind jetzt standardmäßig als Teil des Videoanrufobjekts verfügbar. Für Projekte, die mehr als 200 Stunden Videoanrufe erfordern, können Sie Ihren eigenen API-Schlüssel in den Studieneinstellungen hinzufügen oder den Support um Hilfe bitten. Automatisierte Ereignisse wurden eingeführt, um den Teilnehmerfluss zu optimieren. Sie können jetzt konfigurieren, dass Teilnehmer automatisch zu Beginn des Frames dem Anruf beitreten und am Ende des Frames den Anruf mit einem einzigen Klick verlassen. Diese Verbesserungen sind für Forscher wichtig, da sie das Sitzungsmanagement vereinfachen, die Komplexität der Einrichtung reduzieren und eine nahtlosere und skalierbare remote Datensammlung ermöglichen. Mehr erfahren.

- Konflikt zwischen sortierbarem Objekt und Augenverfolgung behoben: Ein Problem wurde identifiziert, bei dem das sortierbare Objekt die funktionalen Fähigkeiten der webcam-basierten Augenverfolgung beeinträchtigte. Diese Interaktion wurde behoben.

- Schnellere Konfiguration mit duplizierten Zielobjekteigenschaften: Die Aktion „Objekteigenschaft festlegen“ erfordert die Angabe von Zielobjekten, Eigenschaften und Werten, was bei häufigen Wiederholungen zeitaufwendig sein kann. Um diesen Prozess zu optimieren, können Sie jetzt Eigenschaften auf der Zielebene duplizieren, wobei alle zugehörigen Werte automatisch übernommen werden. Dies ermöglicht es Ihnen, nur die notwendigen Anpassungen vorzunehmen, anstatt Konfigurationen von Grund auf neu zu erstellen. Diese kleine, aber leistungsstarke Verbesserung verbessert die Effizienz des Workflows erheblich und reduziert den wiederholenden Aufwand für die Einrichtung, was sie besonders wertvoll für Forscher macht, die komplexe experimentelle Logik aufbauen. Mehr erfahren.

- Verbesserte Organisation mit Aktionsgruppenbezeichnungen: Aktionsgruppen können jetzt benannt werden, was eine klarere Strukturierung der experimentellen Logik ermöglicht. Durch die Gruppierung verwandter Aktionen unter einer benannten Aktionsgruppe können Sie komplexe Arbeitsabläufe besser organisieren und verwalten. Dies erleichtert das Verständnis, die Wartung und das Debugging von Experimenten, insbesondere wenn sie größer und komplexer werden. Für Forscher unterstützt diese Verbesserung ein klareres Experimentdesign und eine effizientere Zusammenarbeit. Mehr erfahren.

BIBLIOTHEKSHIGHLIGHTS Was gibt es Neues in der Bibliothek? Hier sind einige neue Studien, die Sie erkunden und in Betracht ziehen können, um sie für Ihr nächstes Experiment zu importieren und zu bearbeiten:

- Impliziter Assoziationstest (IAT) - Gegengewichtete Desktop-Version: Der implizite Assoziationstest (IAT) misst automatische Assoziationen, indem er Reaktionszeiten aufzeichnet. Teilnehmer sortieren Wörter aus Produktkategorien (umweltfreundlich vs. konventionell) und Attributen (hoch vs. niedrig) mithilfe von E/I-Tasten. Diese Version ist gegengewichtet für die Tastenbelegung und das Layout, und die Stimuli können an die Forschungsziele angepasst werden.

- Emotionserkennungsdemo: Eine Reihe von Bildern wird präsentiert, und der Teilnehmer wird gebeten, den Ausdruck nachzuahmen. Der höchste erkannte Emotion des Ausdrucks des Teilnehmers wird zusammen mit Valenz- und Erregungswerten gemeldet. Hinweis: Da Labvanced auf vollständig datenschutzfreundliche Weise arbeitet, erfolgt alle Inferenzen lokal auf dem Gerät des Teilnehmers, ohne dass Bild- oder Video-Daten jemals das Gerät verlassen.

IN BEARBEITUNG

- Analysetool: Unser neues Analysetool ermöglicht es Ihnen, Ihre Daten in klare Visualisierungen, robuste statistische Analysen und umfassende Verhaltensberichte zu verwandeln – alles an einem Ort. Es ist so konzipiert, dass es Ihnen hilft, Muster schnell zu identifizieren, Ergebnisse zu interpretieren und Erkenntnisse effektiv für Forschung, Lehre oder praktische Anwendungen zu kommunizieren.

Q'4-2025 + Q'1-2026 Newsletter

📌 Anstehend: Preis-/Lizenzänderungen Wie in den letzten Monaten kommuniziert, werden die geplanten Updates unseres Lizenz- und Preismodells bald umgesetzt, mit einem vollständigen Rollout, der Anfang März 2026 erwartet wird. Diese Änderungen stellen eine vollständige Umstrukturierung unserer Lizenzstruktur dar und bieten signifikant mehr Flexibilität und eine breitere Palette von Optionen als zuvor verfügbar.

Unter dem überarbeiteten Modell werden Lizenzen nach Funktionsstufen differenziert und umfassen eine vordefinierte Anzahl von Datenaufzeichnungen, anstatt standardmäßig unbegrenzte Aufzeichnungen anzubieten. Dieser Ansatz spiegelt die Realität wider, dass nicht alle Forscher Zugang zu allen Funktionen oder unbegrenzter Aufzeichnungskapazität benötigen und ermöglicht es, Lizenzen besser an tatsächliche Forschungsbedürfnisse anzupassen. Erweiterte Funktionalitäten werden höheren Lizenzstufen vorbehalten, während einfachere und kostengünstigere Optionen für unkompliziertere Anwendungsfälle verfügbar bleiben.

Das Hauptziel dieses Updates besteht darin, eine größere Preis- und Funktionalitätsflexibilität bereitzustellen, die es Forschern ermöglicht, die Lizenz auszuwählen, die am besten zu ihren Anforderungen passt. Die neue Struktur reicht von kostengünstigen Lizenzen mit grundlegenden Funktionen des experimentellen Designs bis hin zu leistungsfähigeren Lizenzen, die erweiterte Fähigkeiten umfassen. Darüber hinaus werden die Lizenzstrukturen für kommerzielle und industrielle Nutzer klarer und transparenter sein.

Um langjährige Nutzer weiter zu unterstützen, führen wir ein offizielles Treueprogramm ein. Dieses Programm gewährt einen zusätzlichen 5% Rabatt für jedes Jahr kontinuierlicher Lizenzierung, bis zu einem maximum von 30% nach sieben Jahren. Die Inanspruchnahme des vollständigen Treuerabattes wird effektiv den Großteil der aktuellen Preiserhöhung ausgleichen. Dieser Rabatt kann entweder durch kontinuierliche jährliche Erneuerungen im Laufe der Zeit oder durch den Erwerb einer langfristigen Lizenz im Voraus, wo anwendbar, erreicht werden.

Im Rahmen des neuen Funktionsstufensystems werden bestimmte erweiterte Funktionen – wie etwa das Augentracking über die Webcam – nicht mehr in der kostenlosen Lizenz enthalten sein. Allerdings erhalten Inhaber einer kostenlosen Lizenz eine 7-tägige Premium-Testphase, während der diese erweiterten Funktionen vollständig zugänglich sind.

Für Forscher, die mehrjährige Lizenzen erwerben, werden anwendbare Treue-Rabatte automatisch beim Checkout angewendet.

Bitte beachten Sie, dass alle Lizenzangebote, die Sie kürzlich von Labvanced erhalten oder angefordert haben, gültig bleiben und anerkannt werden.

NEUE FUNKTIONEN & FUNKTIONALITÄTEN

Pulsdetektion (Remote Herzfrequenz): Eine neue Pulsdetektionsfunktion ist jetzt für Forscher verfügbar, die an der Messung der Herzfrequenz aus der Ferne mittels Remote-Photoplethysmographie (rPPG) interessiert sind. Diese Funktion ermöglicht die Schätzung der Herzfrequenz ohne Kontakt über Webcam-Eingaben, was sie gut für Experimente geeignet macht, die physiologische Messungen ohne zusätzliche Hardware erfordern. Erfahren Sie mehr.

Studienerstellung über Blockimport: Wir haben eine neue und verbesserte Methode für die Erstellung von Studien mithilfe des Blockimports eingeführt. Bei der Erstellung einer neuen Studie können Sie jetzt Blöcke direkt aus einer vordefinierten Bibliothek hinzufügen. Diese Bibliothek umfasst häufig verwendete Komponenten wie Vorlagen für Einwilligungsformulare, kognitive Aufgaben (z. B. Corsi Block Tapping, WCST usw.), Kontrollchecks (z. B. Kopfhörertests) und Fragebögen. Indem Sie die für Ihre Studie relevanten Komponenten auswählen, können Sie schnell einen strukturierten Studienrahmen generieren, der mit sofort einsatzbereiten Vorlagen gefüllt ist, die dann bearbeitet und an die spezifischen Anforderungen Ihrer Forschung angepasst werden können.

VERBESSERUNGEN

- Verbesserungen der generativen KI: Langwierige Anfragen an die generative KI werden jetzt effizienter bearbeitet und können zuverlässig ausgeführt werden. Dies umfasst Anfragen mit großen Token-Längen, fortgeschritteneren Modellen und allgemein komplexeren Operationen wie der Bildgenerierung.

- Japanische Dokumentation hinzugefügt: Japanisch wurde als neue Dokumentationssprache hinzugefügt. Neben Chinesisch, Niederländisch, Französisch, Spanisch und Englisch ist die Dokumentation jetzt automatisch in Japanisch verfügbar. Benutzer können Japanisch im Sprachenmenü in der oberen Navigationsleiste auswählen und die Dokumentation entsprechend durchblättern.

- Editor-Updates – Konsolidierte Registerkarten: Mehrere Registerkarten des Studieneditors wurden konsolidiert, um die Organisation und Benutzerfreundlichkeit zu verbessern. Benutzer, die Studien in Labvanced erstellt haben, können die folgenden Änderungen bemerken:

- Die Registerkarte Einstellungen enthält nun zusätzliche Konfigurationsoptionen. Infolgedessen wurden die früheren Registerkarten Beschreibung und Teilen entfernt.

- Die Registerkarte Ausführen wurde durch Starten & Teilnehmen ersetzt, die erweiterte Optionen für die Datenerfassung, Integrationen mit Crowdsourcing-Plattformen und die Möglichkeit bietet, benutzerdefinierte Teilnehmerlinks mithilfe von URL-Parametern zu erstellen.

- Die Registerkarte Übersetzen wurde in Texte & Übersetzen umbenannt, um ihren breiteren Umfang widerzuspiegeln. Diese Registerkarte zentralisiert nun alle textbezogenen Steuerungen, einschließlich Übersetzungen und Bearbeitung von systemgenerierten Nachrichten (z. B. Kalibrierungsanweisungen).

- Die Registerkarte Teilnehmer wurde in Stichprobenverwaltung umbenannt. Insgesamt führen diese Updates zu einem klarer organisierten Seitenmenü, wobei verwandte Optionen unter gut definierten Registerkarten gruppiert sind.

- Neue Startseite: Wir haben eine neue Startseite lanciert, die die vollständigen Fähigkeiten und Stärken der Labvanced-Plattform genauer widerspiegelt. Wir laden Sie ein, die aktualisierte Seite zu erkunden und Ihr Feedback zu teilen, indem Sie auf diese E-Mail antworten. Wenn Sie neu bei Labvanced sind, empfehlen wir Ihnen, einen Blick darauf zu werfen – möglicherweise werden Funktionen und Fähigkeiten hervorgehoben, über die Sie zuvor nicht wussten, dass die Plattform sie unterstützt.

BIBLIOTHEKSHIGHLIGHTS Was gibt es Neues in der Bibliothek? Hier sind einige neue Studien, die Sie erkunden und für Ihr nächstes Experiment importieren und damit arbeiten können:

- Simon-Aufgabe: Die Simon-Aufgabe ist eine Reaktionszeitaufgabe, die untersucht, wie irrelevante räumliche Informationen die Reaktionsgeschwindigkeit und -genauigkeit beeinflussen. Die Teilnehmer reagieren auf ein nicht-räumliches Merkmal eines Stimulus, während dessen Standort entweder mit der erforderlichen Antwort übereinstimmt oder in Konflikt steht.

- Flanker-Pfeile: Diese Studie misst selektive Aufmerksamkeit und inhibitorische Kontrolle mit Hilfe der Flanker-Aufgabe. Die Teilnehmer reagieren auf die Richtung eines zentralen Pfeils, während sie umgebende Ablenkungen ignorieren. Reaktionszeit und Genauigkeit werden als Leistungsindikatoren aufgezeichnet.

- Aktienmarktspiel - 2 Spieler: In diesem Aktienmarktspiel treten zwei Spieler als Investoren gegeneinander an, um am Ende die größte Portfoliogröße zu erreichen. Ein Spieler hat zudem Insiderwissen, basierend auf Wahrscheinlichkeiten bestimmter Fonds, die an Wert gewinnen oder verlieren, und kann dies mit dem anderen Spieler teilen.

Q3'25 Newsletter

NEUE FUNKTIONEN

- Ausführung von benutzerdefiniertem JavaScript-Code: Labvanced hat eine neue Funktion eingeführt, die die Ausführung von benutzerdefiniertem JavaScript zur direkten Manipulation des Document Object Model (DOM) innerhalb von Experimenten ermöglicht. Diese Funktion erlaubt es Forschern, programmgesteuert Bildschirmelemente zu bearbeiten, interaktive JavaScript-basierte Spiele zu integrieren und dynamischere Inhalte zu erstellen. Dies stellt einen bedeutenden Fortschritt im Vergleich zu den vorherigen Möglichkeiten der Plattform dar, die auf das Lesen und Schreiben von Variablenwerten beschränkt waren. Infolgedessen erweitert dieses Update erheblich den Umfang der experimentellen Designs, die auf der Plattform umgesetzt werden können. Erfahren Sie mehr.

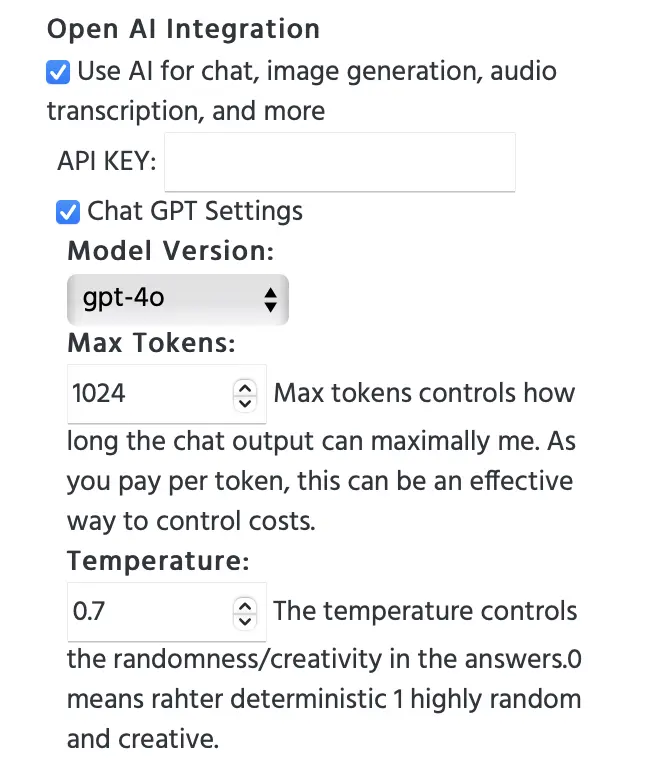

- Neue OpenAI-Integrationen: Labvanced hat eine neue Funktion eingeführt, die die direkte Integration der generativen KI-Funktionen von OpenAI in experimentelle Aufgaben ermöglicht. Forscher können jetzt textbasierte Eingabeaufforderungen aus einem Experiment an die OpenAI-API senden und erhält AI-generierte Bilder, Texte oder Audios als Antwort. Diese Verbesserung eröffnet bedeutende Möglichkeiten für Studien zur Interaktion zwischen Mensch und KI, Wahrnehmungen von künstlicher Intelligenz und zur Anwendung von generativer KI als kognitives oder kreatives Werkzeug. Beispielsweise ermöglicht es kontrollierte Studien, bei denen Teilnehmer innerhalb einer einzigen Schnittstelle mit der KI interagieren, oder Paradigmen, in denen AI-generierte Inhalte dynamisch zur Bewertung produziert werden, wie in Aufgaben, die die Unterscheidung zwischen menschlichen und von KI geschaffenen Arbeiten über einen OpenAI-Trigger. Hier sind Beispiele für Studien, die Sie ausprobieren können:

- OpenAI Bildgenerierungsdemo: Bilder, die innerhalb von Labvanced erstellt werden.

- KI-generierte Audio-Demo: Absätze von Text (Lernmaterialien), die von einer Stimme generiert durch die OpenAI-API vorgelesen werden, gefolgt von Multiple-Choice-Fragen.

- Text-Transkription: Labvanced hat eine Spracherkennungstranskriptionsfunktion für Audioaufnahmeobjekte innerhalb von Experimenten eingeführt. Diese Funktion wird von einem integrierten Whisper-Modell betrieben, das vollständig clientseitig arbeitet, was bedeutet, dass die gesamte Verarbeitung direkt im Gerät des Teilnehmers erfolgt. Da keine Audiodaten an externe Server übertragen werden, gewährleistet dieser Ansatz hohe Datensicherheit und schützt die Privatsphäre der Teilnehmer. Forscher können die Transkription aktivieren, indem sie die entsprechenden Ereignisse in einem Audioaufnahme-Element konfigurieren. Erfahren Sie mehr.

- Automatische Ereigniserstellung: Um die Benutzerfreundlichkeit zu verbessern und den Prozess der Studienerstellung zu beschleunigen, wurde der Labvanced-Editor mit einem neuen kontextbewussten System aktualisiert. Wenn ein Benutzer ein Objekt auswählt, wie das Audioaufnahmeobjekt, zeigt der Editor nun proaktiv ein Menü gängiger und relevanter Aktionen an. Das Auswählen einer dieser Optionen konfiguriert automatisch die entsprechende Ereignislogik, was die manuelle Einrichtungszeit erheblich verkürzt. Diese Funktion rationalisiert den Workflow für erfahrene Benutzer und bietet intuitive Anleitungen für Neulinge auf der Plattform.

📌Zukünftige Funktionen

- Säuglingsfreundliches Augentracking-Facemesh: Zielt darauf ab, Dimensionen wie Höhe und Breite zu verwenden, um den Teilnehmer 'einzuschließen'

- Lizenzen: Laut der letzten Newsletter-Ankündigung sind die geplanten Änderungen an den Lizenzen immer noch in Arbeit, mit dem Ziel, diese in den kommenden Monaten, bis Q4, umzusetzen. Die neuen Änderungen werden bestimmte Funktionen auf bestimmte Lizenzen beschränken und zu mehr Vielfalt und Flexibilität hinsichtlich der angebotenen Lizenztypen führen.

- Neustrukturierung der Studiensettings: Studiensettings werden neu strukturiert, um besser organisiert zu sein.

- Webcam-basierte Pupillometrie: Immer noch in Arbeit.

VERBESSERUNGEN

- Datenspaltenüberschriften zu Array-Variablen hinzufügen: Unter dem Variablenpanel im Editor (wo die Variablen aufgelistet sind) gibt es jetzt eine Option, um Datenspaltenüberschriften hinzuzufügen, wenn eine Array-Variable erstellt oder ausgewählt wird. Dies ist nützlich für Augentracking-Studien, die Array-Variablen verwenden, oder jede andere Art von Studie, in der das Array aufgezeichnet werden muss. Durch das Hinzufügen der Spaltenüberschriften wird die Datenansicht diese nun auflisten, was die Datenvorschau und -analyse klarer und einfacher macht.

- Binary-Datei-Upload: Um den Experimentablauf und die Erfahrung der Teilnehmer zu verbessern, bietet Labvanced jetzt einen verbesserten Datei-Upload während der experimentellen Aufgaben an. Benutzererstellte Dateien, wie Audio- und Videoaufzeichnungen, werden jetzt automatisch im Hintergrund hochgeladen. Diese Verbesserung beseitigt die Notwendigkeit, spezifische Ereignisse zu erstellen, die warten, dass ein Upload abgeschlossen ist, bevor sie zum nächsten Versuch fortschreiten.

- Wiederholungsprotokoll für Datenspeicherung: Um gegen Datenverluste durch vorübergehende Netzwerkunterbrechungen zu schützen, hat Labvanced einen automatischen Wiederholungsmechanismus für die Datenspeicherung implementiert. Momentane Unterbrechungen in der Internetverbindung eines Teilnehmers, selbst wenn sie nur Millisekunden dauern, könnten zuvor Fehler verursachen, wenn sie während der Datenübertragung auftraten, was möglicherweise die Integrität der Studie beeinträchtigen könnte. Mit diesem neuen Schutz wird Labvanced im Falle eines lokalen Netzwerkfehlers die Übertragung automatisch erneut versuchen, was die Zuverlässigkeit der Datensammlung erheblich erhöht und sicherstellt, dass experimentelle Daten sicher gespeichert werden.

- Ereigniswarteschlange beim Experiment-Pause: Um die Zuverlässigkeit zu verbessern, wurde ein neuer Schutz beim Umgang mit Ereignissen während Pausen des Experiments implementiert. Zuvor konnten bei einer automatischen Pause des Experiments – beispielsweise aufgrund übermäßigen Bewegens des Teilnehmers während einer Augentracking-Aufgabe – alle zu diesem Zeitpunkt ausgeführten Ereignisse unterbrochen werden, was möglicherweise zu Fehlern führte. Das System stellt jetzt automatisch sicher, dass aktive Ereignisse, die von einem pausierten Experiment betroffen sind, in die Warteschlange gesetzt werden. Beim Wiederaufnehmen des Experiments werden diese wartenden Ereignisse wie ursprünglich beabsichtigt ausgeführt.

- Verbesserte Verknüpfung von Variablen zu Text: Ein Update wurde implementiert, um die Robustheit des Variablenbindungssystems, das in Textobjekten verwendet wird, zu erhöhen und die Stabilität und Leistung zu verbessern. Das Verlinken eines Textelements mit einer neuen Variable ist jetzt stabiler, da Variablen-IDs als Identifikatoren verwendet werden.

- Sortierbares Objekt jetzt bidirektional: Bei der Verlinkung eines Arrays mit einem sortierbaren Element wird jede Aktualisierung des Arrays in Bezug auf die Reihenfolge der Elemente anschließend im sortierbaren Objekt widergespiegelt.

BIBLIOTHEK HIGHLIGHTS

Was gibt es Neues in der Bibliothek? Hier sind einige neue Studien, die Sie erkunden und in Betracht ziehen können, für Ihr nächstes Experiment zu importieren und damit zu arbeiten:

- Trail Making Test: In Teil A verbinden Sie die Zahlen in der Reihenfolge (1-2-3). In Teil B wechseln Sie zwischen Zahlen und Buchstaben (1-A-2-B). Der Test misst die Verarbeitungsgeschwindigkeit, Aufmerksamkeit und kognitive Flexibilität.

- Corsi Block Tapping Task: Blöcke werden auf dem Bildschirm angezeigt, wobei einer nach dem anderen aufblitzt, um eine Sequenz zu erstellen. Der Teilnehmer soll die Blöcke in der Reihenfolge anklicken, in der sie aufgeblitzt sind. Die Anzahl der in Sequenz angeklickten Blöcke beginnt klein und steigt mit jeder korrekt wiederholten Sequenz.

- Preferential Looking Paradigm: Diese Studie untersucht die visuelle Aufmerksamkeit bei Säuglingen mithilfe eines preferential looking Paradigmas. Die Teilnehmer betrachten nebeneinander Bilder oder Videos, während Augenbewegungsmuster, Fixierungsdauern und Kopfposition aufgezeichnet werden.

Q2'25 Newsletter

NEUE FEATURES

- Videokonferenzen: Das Video Conference Object ist da! Sie können jetzt Videokonferenzen in Ihre Studie integrieren und die Teilnehmer per Anruf miteinander kommunizieren lassen. Sie können steuern, wann während des Experiments dies geschieht, ob der Anruf nur audio-basiert sein soll oder sogar ob Bildschirmfreigabe erlaubt werden sollte. Mit der Einführung von Videokonferenzen in Labvanced können Sie jetzt einfach integrieren und mehr Kontrolle über die Interaktion zwischen den Teilnehmern sowie die Kommunikation zwischen Teilnehmer und Forscher implementieren.

Switch GroupAktion: Eine neue Aktion ist jetzt im Ereignissystem verfügbar. Sie können jetzt festlegen, dass Teilnehmer während des Experiments basierend auf bestimmten Kriterien (oder Triggern) die Gruppen wechseln. Dies ermöglicht es Ihnen, Teilnehmer dynamisch bestimmten Gruppen zuzuweisen, je nach Bedarf. Zum Beispiel, wenn das Experiment mit zwei Gruppen basierend auf dem Alter (jung vs. alt) beginnt und dann ein Teilnehmer aus der „jungen“ Gruppe eine spezifische Antwort angibt, können Sie ihn automatisch basierend auf dieser Antwort einer anderen Gruppe zuweisen. Oder wenn ein Teilnehmer einen „hohen Punktestand“ bei einer Aufgabe hat, können Sie ihn einer „hohen Punktestand“-Gruppe zuweisen usw.- Datenrahmen und Array-Länge als Variable: In einigen Fällen aktualisieren und ändern sich Datenrahmen und Arrays dynamisch im Verlauf des Experiments. Zum Beispiel können neue Zeilen hinzugefügt werden, wodurch die Einträge wachsen. Für ein flexibles Experimentdesign ist es wichtig, zu jedem Zeitpunkt die Länge dieser Arrays oder Datenrahmen zu kennen. Mit diesem neuen Feature können Sie die variable Anzahl der Länge abrufen.

- Datenrahmen vor Ort bearbeiten: Wenn ein Datenrahmen aktualisiert werden muss, z. B. wenn eine Korrektur vorgenommen werden muss oder eine kleine Änderung erforderlich ist, können Sie jetzt die Bearbeitung direkt vor Ort durchführen. Es ist nicht mehr nötig, den gesamten Datenrahmen erneut hochzuladen, wie es in der Vergangenheit erforderlich war. Sie gehen einfach im Variablenbereich im Editor zum Datenrahmen-Variablen und klicken auf die Schaltfläche

Edit Data Frame. Von dort aus wird der Datenrahmen geöffnet. In der oberen rechten Ecke befindet sich ein Kontrollkästchen mit der AufschriftEdit Values. Aktivieren Sie dies, und jetzt können die Zellen bearbeitet werden.

📌Bevorstehende Lizenzänderungen

- Bitte beachten Sie, dass es in den kommenden Wochen Änderungen am Lizenzsystem in Labvanced geben wird. Dies soll die Nutzung von kostenlosen Konten und auch von Konten, die mit Aufladungen arbeiten (im Gegensatz zu lizenzierten Konten), ändern.

- Kostenlose Konten erhalten nun 10 kostenlose Aufzeichnungen.

- Bis jetzt waren Aufladungen an eine studienspezifische Basis gebunden. Nun können Aufladungen global über jede Studie hinweg verwendet werden.

- Schließlich wird der Mindestbetrag für den Kauf von Aufladungen 40 Aufzeichnungen betragen.

- Diese Updates werden schrittweise eingeführt, um einen sicheren und reibungslosen Übergang zu gewährleisten.

VERBESSERUNGEN

- Sprache-Drop-down ausblenden und Sprache über URL-Parameter auswählen: Für mehrsprachige Studien, die die Übersetzungsfunktion nutzen, können Sie jetzt vorab festlegen, mit welcher Sprache eine Studie beginnen soll, indem Sie den URL-Parameter „study_language“ verwenden. Dies wird auch das zuvor standardmäßig zu Beginn der Studie angezeigte Drop-down-Menü ausblenden.

- Übersetzung von

requiredFragebogenitems: Beim Ausfüllen eines Fragebogens können Sie angeben, welche Items erforderlich sind. Wenn der Teilnehmer keine Antwort gibt, wird er mit einer automatischen Nachricht vonrequiredaufgefordert. Dies kann jetzt über die RegisterkarteTranslatein Labvanced übersetzt werden, sodass Sie eine sprachspezifische Rückmeldung erhalten. - Polygon dynamisch modifizierbar: Die Punkte des Polygonobjekts können jetzt während des Experiments dynamisch aktualisiert werden. Sie können einen Datenrahmen mit zwei Spalten (x- und y-Koordinaten) erstellen, um seine Punkte anzugeben. Verwenden Sie dann eine „Set Object Property“ und rufen Sie den Parameter „points“ auf und setzen Sie ihn auf den Datenrahmen, während Sie ihn z. B. alle 50 ms aktualisieren. Dies hat mehrere Anwendungsfälle, wie das Erstellen dynamischer AOIs über Videos mithilfe von Webcam-Augenverfolgung.

- Canvas-Rahmen sind scrollbar: Wählen Sie unter den Task-Einstellungen eine Option wie „Fest in visuellen Grad“ oder „Fest in Pixel“ und für das Feld „Wie mit Überlauf / Scrollen umgehen?“ dann wählen Sie „Rahmen scrollbar machen“. Dies hat mehrere Anwendungsfälle, wie das Erstellen von Mock-Websites in Labvanced.

- Schieber-Inkrement: Das Schieber-/Bereichsobjekt erlaubte zuvor den Teilnehmern, ihre Antwort um einen numerischen Wert von eins (1) zu erhöhen oder zu verringern. Jetzt gibt es eine „Schrittgröße“-Option, mit der Sie den Inkrementbereich angeben können, z. B. können Sie 0,5-Inkremente verwenden, um eine Eingabeantwort von 1,5 zu erhalten, was mehr Flexibilität beim Umfang der gesammelten Daten mit diesem Objekt bietet.

- Neuklassifizierung von Objekten im Editor: Wenn Sie Labvanced seit mehr als einem Monat verwenden, haben Sie möglicherweise bemerkt, dass die Seitenleiste mit den Objektoptionen im Editor aktualisiert wurde! Es war Zeit für etwas Aufräumarbeiten bei der Neuanordnung der Hauptkategorien, da die Liste der Objekte dank Ihres Feedbacks und Ihrer Anfragen konstant gewachsen ist!

- Geteilte Studien-Binärdateien: In der Vergangenheit konnten nur Studieninhaber auf die Binär-/Medien-Dateien einer geteilten Studie zugreifen und sie herunterladen. Aus Gründen der Datenverwaltung ist es nun möglich, dass auch diejenigen, mit denen die Studie geteilt wurde, auf diese Dateien zugreifen können.

- Untrusted JS-Ausführung zulassen: JavaScript-basierte Aktionen waren größtenteils auf die Ausführung und Funktionen zur Durchführung arithmetischer Berechnungen beschränkt. Mit dieser neuen Verbesserung können JavaScript-Aktionen verwendet werden, um auf das DOM zuzugreifen, was es den Benutzern ermöglicht, Code zu verwenden, um Objekte dynamisch zu ändern und mehr.

- Bild zu Beginn der Studie entfernen: Wenn eine Studie gestartet wird, erscheint ein Bild oben. Dies kann jetzt entfernt werden. Gehen Sie einfach unter die Registerkarte „Beschreibung“ und wählen Sie „Kein Bild“. Nun wird das Bild bei der Ausführung einer Studie nicht mehr angezeigt.

- Automatisches Relink von Medien: Manchmal können Dateien entlinkt werden, insbesondere wenn sich das experimentelle Design ändert. In der Vergangenheit mussten Sie Medien manuell eins zu eins wieder verlinken. Jetzt können Sie die Registerkarte

Mediaöffnen und auswählen, ob Sie fehlende Dateien automatisch erneut zuordnen möchten. Bitte beachten Sie, dass die Dateinamen genau so übereinstimmen müssen, wie Sie sie ursprünglich benannt hatten. - Teilnahme an Mehrbenutzerszenarien verhindern: Eine neue

Study Setting-Option ist jetzt verfügbar, um die Teilnahme von Probanden zu verhindern, die eine Studie nicht abgeschlossen haben. Dies ist relevant für Studien, die Crowd-Sourcing verwenden, - Desktop-App-Binärdateien und Offline-Upload-Fix: Ein Fehler wurde behoben, bei dem bestimmte Instanzen von Offline-Aufzeichnungen in der Desktop-App und Binärdateien betroffen waren.

Bibliothekshighlights

Was gibt es Neues in der Bibliothek? Hier sind einige neue Studien, die Sie erkunden und in Betracht ziehen können, für Ihr nächstes Experiment zu importieren und damit zu arbeiten:

- ChatGPT mit Persona: In dieser Studie können Sie ChatGPT eine Persona zuweisen oder ihm Ihre eigene geben, bevor Sie zu einem Chatszenario übergehen.

- Selbstmitgefühlsfragebogen mit Videokonferenzen: In dieser Demo können Sie eine Konferenzschaltung mit dem Teilnehmer veranstalten, bevor sie den SCS-SF Fragebogen ausfüllen, und sich nach der Einreichung des Fragebogens mit ihnen treffen.

- Oldenburger Burnout-Inventar (OLBI): Dieser Fragebogen zielt darauf ab, Burnout zu bewerten.

- Pädiatrische Symptom-Checkliste-17 (PSC-17): Im Bereich der klinischen Psychologie zielt diese Checkliste darauf ab, die emotionale und verhaltensbezogene Funktion bei Kindern zu bewerten.

Demnächst: Bald erhältlich

- Emotionserkennung als zusätzliche Funktion

- Weitere Integrationen von generativer KI: einschließlich Sprach-zu-Text und Bilderzeugung

Newsletter Q4’2024 und Q1'25

NEUE FUNKTIONEN

- CSV-basierte Aufgaben Erstellung über den Aufgabenassistenten: Wenn Sie Ihre experimentelle Aufgabe mit Tabellenkalkulationen / CSV-Daten einrichten möchten, ist der Aufgabenassistent hier, um Ihnen zu helfen, den Prozess der Erstellung experimenteller Aufgaben zu beschleunigen! Mit dem Aufgabenassistenten können Sie Ihre gesamte Struktur der experimentellen Aufgaben erstellen, einschließlich Reize, Ereignisse, Variablen, Faktoren, Bedingungen, Randomisierung und Datenerfassung aus einer einzigen CSV-Datei sowie Stimulusdateien. Erfahren Sie mehr.

- Benutzerdefinierte E-Mail-Option: Auf vielfachen Wunsch können Sie jetzt auch Ihre eigenen benutzerdefinierten E-Mails über den Teilnehmer-Tab in Labvanced entwerfen. Zuvor konnten Sie nur die verfügbaren Vorlagen bearbeiten. Aber jetzt können Sie neue benutzerdefinierte E-Mails erstellen, mit denen Sie den Kommunikationsprozess komplett an die Bedürfnisse Ihrer Labore anpassen können. Erfahren Sie mehr über Teilnehmermanagement.

- Desktop-App: Mit der Desktop-App können Sie externe Hardware wie EEGs, hardwarebasierte Eye-Tracker und mehr verbinden. Die Desktop-App wurde ins Leben gerufen, um Ihnen zu helfen, die Laboroperationen zu verbessern, den Datensammelprozess zu optimieren, sodass Labvanced Ihr bevorzugtes All-in-One-System für die Forschung werden kann. Die Desktop-App ist seit etwa einem Monat verfügbar und wir freuen uns über Ihr Feedback und danken Ihnen, dass Sie auf diese neue Funktion reagiert haben! Erfahren Sie mehr.

- Telefon-App: Die Telefon-App ist jetzt für Android verfügbar. 🥳 Sie können den Play Store besuchen und sie herunterladen. Diese Verbesserung ist ein weiteres Beispiel dafür, wie Labvanced sich der Unterstützung Ihrer Forschungsbedürfnisse widmet. Mit der Telefon-App gibt es insgesamt mehr Kontrolle über den gesamten experimentellen Ablauf, sodass Sie Push-Benachrichtigungen senden und telefonbasierte Längsschnittforschung durchführen können. Darüber hinaus, wenn Sie eine benutzerdefinierte Telefon-App mit bestimmten Funktionen benötigen, bieten wir diese Option als zusätzlichen Service an, bei dem Sie die App vollständig zu Ihrer eigenen gestalten können. Erfahren Sie mehr.

- Benutzerdefiniertes Onboarding: Auch wenn es für bestehende Benutzer nicht direkt von Bedeutung ist, bieten wir jetzt ein neues Onboarding-Erlebnis an. Dies könnte für Sie interessant sein, wenn Sie mit Studierenden arbeiten und Labvanced verwenden, um experimentelle Methoden zu unterrichten. Wenn sich jetzt ein neuer Benutzer anmeldet, wird ein maßgeschneidertes Onboarding-Erlebnis geboten. Dem Benutzer wird eine Liste von Optionen angezeigt und er kann direkt wählen, wie er fortfahren möchte, sei es durch Lesen der Dokumentation, Ansehen von Videos oder sogar Importieren einer für ihn relevanten Vorlage.

- Sub-Studienobjekt: Das

Sub Study Objectkann verwendet werden, um andere Studien innerhalb eines einzelnen Experiments einzubetten. Im Grunde haben Sie eine „Elternstudie“, die diese „Sub-Studien“ enthält, die andere Labvanced-Studien sind. Es gibt mehrere Anwendungsfälle für dieses Objekt, z. B. die Einbeziehung standardisierter Fragebögen oder Pre-Screener, ohne sie jedes Mal für eine neue Studie erstellen zu müssen, den Vergleich der Leistung von Probanden über Studien hinweg, das Einrichten von Testbatterien und mehr. Hier ist die Leitfadendokumentation zur Verwendung dieses Objekts und wenn Sie Fragen haben, wie Sie dies in Ihr nächstes Experiment einbeziehen können, sind Sie herzlich eingeladen, uns zu kontaktieren!

VERBESSERUNGEN

- Eye-Tracking-Versionierung und neues Update: Jetzt werden Eye-Tracking-Updates mit Versionierung durchgeführt, die im Tab "Studieneinstellungen" angezeigt wird. Dadurch können bestehende Studien ihre aktuelle Version fixieren, während neue Studien die neueste Version haben. Die neueste Version (v1) enthält eine Option zur Anpassung der Lautstärke bei der kinderfreundlichen Eye-Tracking-Kalibrierung.

- Dynamische Änderung der angezeigten Sprache in einem Experiment: Sie können jetzt Ihr Experiment so einrichten, dass die angezeigte Sprache dynamisch geändert wird, indem Sie die Systemvariable „Displayed_Language“ auf eine Sprache setzen, die Sie über den

Texts & TranslateTab erstellt haben. Wenn Sie Fragen haben, sind Sie herzlich eingeladen, uns zu kontaktieren! - Objektformatierung - zentriert: Beim Hinzufügen neuer Objekte zum Editor werden diese automatisch zentriert, und ihr Ankerpunkt wird ebenfalls in der Mitte sein.

- Verbesserter Export von Datenrahmen: Die Exporteinstellungen wurden verbessert, sodass der Export von Datenrahmen jetzt einfacher ist.

- Wählbare Objekte: Im Objekt-Eigenschaftsfenster gibt es eine Option, um ein Objekt für Benutzer wählbar zu machen. Standardmäßig kam dies mit einem hervorgehobenen Begrenzungsrahmen, der jetzt deaktiviert werden kann.

- Audioaufnahme-Pufferung verringert: Es gab einen kleinen Puffer von etwa 20 Millisekunden am Ende von Audioaufnahmen, der jetzt auf etwa 2-3 Millisekunden reduziert wurde.

BIBLIOTHEKS-HIGHLIGHTS Was gibt es Neues in der Bibliothek? Hier sind einige neue Studien, die Sie erkunden und für Ihr nächstes Experiment in Betracht ziehen können:

- Bouba-kiki-Effekt: ein nettes linguistisches Beispiel dafür, wie das Trial-System in einem Experiment verwendet wird, in dem der Teilnehmer gezwungen wird, zwischen zwei Reizen zu wählen. Probieren Sie es hier aus.

- OCI-R: Der Obsessive Compulsive Inventory-Revised Fragebogen ist jetzt in der Bibliothek verfügbar, ein kurzes Selbstberichts-Assessment-Tool, das verwendet wird, um die Schwere von OCD-Symptomen bei Personen zu messen (18 Items, die auf einer 5-Punkte-Likert-Skala bewertet werden). Probieren Sie es hier aus.

- GAD-7: Der Generalized Anxiety Disorder (GAD) Assessment - 7 ist jetzt in der Bibliothek verfügbar, ein Selbstberichtsfragebogen, der entwickelt wurde, um auf GAD zu screenen, indem die Häufigkeit und Schwere von Angst-Symptomen der letzten zwei Wochen bewertet wird. Probieren Sie es hier aus.

- WCST-64: Wenn Sie an der WCST interessiert sind, können Sie auch eine Demo importieren und als Grundlage für Ihr nächstes Experiment verwenden. Probieren Sie es hier aus.

- Text dynamisch bearbeiten: In dieser Demo wird der Teilnehmer gebeten, den Absatztext zu bearbeiten. Es gibt einen Live-Datenstrom, der die Tastenanschläge und Mausklicks sowie den Absatzstatus zusammen mit Zeitstempeln in Millisekunden von Beginn des Frames zeigt. Probieren Sie es hier aus.

SCHWERPUNKT AUF PUBLIKATIONEN Möchten Sie sehen, woran andere Forscher mit Labvanced arbeiten? Überprüfen Sie diese Liste einiger Beispiele für kürzlich veröffentlichte Forschung:

- Calignano, G., Lorenzoni, A., Semeraro, G., & Navarrete, E. (2024). Wörter vor Bildern: die Rolle der Sprache bei der Beeinflussung visuelle Aufmerksamkeit. Frontiers in Psychology, 15, 1439397. https://doi.org/10.3389/fpsyg.2024.1439397

- Dehove, M., et al, (2024). Erforschen des Einflusses von urbanen Kunstinterventionen auf Anziehung und Wohlbefinden: ein empirisches Feldexperiment. Frontiers in Psychology, 15, 1409086. https://doi.org/10.3389/fpsyg.2024.1409086

- Meewis, F., et. al, (2024). Eine vergleichende Studie zur kausalen Wahrnehmung bei Guinea-Babun (Papio papio) und menschlichen Erwachsenen. PloS one, 19(12), e0311294. https://doi.org/10.1371/journal.pone.0311294

- Tsai, C. C., et al, (2025). Einfluss von künstlicher Intelligenz-Nützlichkeit und Unsicherheit auf kognitive Interaktionen mit Apothekern: Randomisierte kontrollierte Studie. Journal of Medical Internet Research, 27, e59946. https://www.jmir.org/2025/1/e59946/

BEVORSTEHEND

- Videokonferenz als In-Studien-Option

- Emotionserkennung als zusätzliche Funktion

Q3'24 Newsletter

NEUE FUNKTIONEN

- Spielsteuerung / Joystick-Benutzereingabe: Jetzt haben Sie die Möglichkeit, Spielcontroller und Joysticks in Ihre Studie einzubeziehen! Teilnehmer können Objekte bewegen und mit dem Experiment interagieren, wie es Ihr Design vorgibt, über den Gamepad/ Joystick Trigger und Sie können Daten aufzeichnen, d.h. welche Taste sie gedrückt haben und mehr mit den gamepad/ joystick-spezifischen Werten. Überprüfen Sie auch dieses Beispielstudien-Durchgang, wie es implementiert werden kann!

- Teilnehmer-Tab: Mit Labvanced können Sie Ihre Teilnehmer über den neu hinzugefügten „Teilnehmer“-Tab verwalten und kommunizieren. Mit dem „Teilnehmer“-Tab haben Sie eine Übersicht Ihrer Probanden für eine bestimmte Studie, können die E-Mails anpassen, die während der Datensammlung gesendet werden, sowie Ihre E-Mail-Adresse über den SMTP-Server verbinden. Grundsätzlich können Sie diesen Tab verwenden, um die Kommunikation mit Ihren Teilnehmern zu verwalten, die an Ihrer Forschung teilnehmen, was besonders nützlich für Längsschnittstudien mit mehreren Sitzungen ist.

- Multi-Benutzer-Studienfunktionen: Multi-Benutzer-Studien erfordern, dass viele Daten in Echtzeit zwischen den Teilnehmern kommuniziert werden. In sehr großen Studien, in denen Hunderte von Teilnehmern gleichzeitig auf eine Studie zugreifen können, kann dies eine große Belastung für Server darstellen, was die Integrität der Studie beeinträchtigen kann. Aus diesem Grund haben wir folgende Sicherheitsmaßnahmen implementiert:

- „Rate-Limiter-Strategie“, bei der Sie angeben, wie mit Daten umgegangen wird, wenn der Server überlastet ist, unter der distribute variable (scrollen Sie nach unten für die Beschreibung der Optionen dieser Funktion)

- Darüber hinaus gibt es jetzt eine Option im

EinstellungenTab, um festzulegen, wie viele Sitzungen parallel stattfinden können

- Mehr Textobjekte: Die folgenden Ergänzungen wurden im Editor vorgenommen, um Ihnen mehr Kontrolle über Design und Präsentation zu geben:

- DisplayVariable-Element: Dieses Element ermöglicht es Ihnen, direkt zu verlinken und Variablenwerte innerhalb des Experiments anzuzeigen.

- DisplayHTML-Element: Wenn Sie HTML verwenden und es innerhalb der Studie anzeigen müssen, können Sie dieses Element nutzen.

- Zuweisung von SVG-Reizen über Datenrahmen: Forscher, die SVGs in ihren Studien verwenden, können diese jetzt über Datenrahmen den Versuchen zuweisen.

VERBESSERUNGEN

- Blinkende Wiederhol-Bildschirm: Ein Problem, bei dem beim Scheitern der Augenverfolgungs-Kalibrierung und dem anschließenden Wiederholen der Bildschirm die Kalibrierungspunkte überlagert hat (während der zweiten Phase der Kalibrierung, in der es ein kreisförmiges Muster gibt), wurde jetzt behoben.

- Doppelte erste Sitzungen: Ein Problem, bei dem Teilnehmer, die im Teilnehmer-Tab hinzugefügt wurden, 2 Sitzungen (statt einer) für ihr erstes Experiment erstellt hatten, wurde jetzt behoben.

BIBLIOTHEKS-HÖHEPUNKTE

Was gibt es Neues in der Bibliothek? Hier sind einige neue Studien, die Sie erkunden und vielleicht für Ihr nächstes Experiment importieren und verwenden können:

- Tier-Wortsuche (Mehrspieler): In dieser Demo treten zwei Spieler gegeneinander an, um herauszufinden, wer die meisten Wörter in einem Wortsuche-Rätsel finden kann! Jetzt ausprobieren! (Hinweis: Kopieren Sie die URL in einen zweiten Tab und spielen Sie gegen sich selbst, wenn Sie es einfach mal ausprobieren möchten!)

- ChatGPT: In dieser Labvanced-Demo können Sie direkt mit ChatGPT kommunizieren. Geben Sie einfach Ihren Prompt ein und drücken Sie die 'Enter'-Taste, um zu senden. Jetzt ausprobieren!

NEUE DOKUMENTE

- Chat GPT Studie: Dieses Tutorial erklärt, wie man eine Studie aufbaut, in der die ChatGPT-Funktion in ein Design integriert werden kann, bei dem eine Chat-Oberfläche den Austausch / das Gespräch zwischen dem Teilnehmer und ChatGPT anzeigt und aufzeichnet.

- SVGs als AOIs in der Augenverfolgung: In diesem Tutorial sehen Sie, wie eine Augenverfolgungsstudie SVG-Objekte einbindet, um Blickdaten über Interessensgebiete (AOIs) zu sammeln.

- Multi-User Zeige Mauszeigerposition: Arbeiten Sie an einer Multi-User-Studie, bei der die Teilnehmer die Mauszeigerpositionen der anderen sehen sollen? In diesem Tutorial präsentieren wir zwei Ansätze, wie Sie dies in Labvanced erreichen können.

NEUE PUBLIKATIONEN

Möchten Sie sehen, woran andere Forscher mit Labvanced arbeiten? Überprüfen Sie diese Liste mit einigen Beispielen neu veröffentlichter Forschung:

- Visuelle Wahrnehmung unterstützt 4-Platz-Ereignisrepräsentationen: Eine Fallstudie zu TRADING in den Tagungsberichten der Jahrestagung der Cognitive Science Society (Bd. 46) von Khlystova, E., Williams, A., Lidz, J., & Perkins, L. (2024).

- Was macht eine Bewegung menschlich? in Japanischer Psychologischer Forschung von Yang, X. et al. (2024).

- Eigene linguistische Präferenzen übertreffen zufällige Übereinstimmungen bei der Auswahl kooperativer Partner in Sprache und Kognition von Matzinger, T., et al. (2024).

- Scrollen und Hyperlinks: Die Auswirkungen von zwei verbreiteten digitalen Merkmalen auf das digitale Leseverstehen von Kindern in Journal of Research in Reading von Krenca, K., Taylor, E., & Deacon, S. H. (2024).

KOMMENDE

- Aufgabenassistent

- Desktop-App mit SLS-Verbindung

- Telefon-App für Android

- Verbesserter Fixationsdetektionsalgorithmus (Augenverfolgung)

Q2’24 Veröffentlichungsnotizen

NEUE FUNKTIONEN

- Komplexe Formen als AOIs für webcam-basierte Augenverfolgung unter Verwendung von SVG-/Polygon-Objekten: In der Vergangenheit konnten AOIs oder 'Masken' nur mit Rechteckformen erstellt werden. Das ist für komplexe Formen nicht geeignet. Mit dieser neuen Funktion, die jetzt verfügbar ist, können Sie SVG- und Polygon-Objekte nutzen, um AOIs/Masken für komplexe Formen zu erstellen, die dann als 'Trigger' und/oder 'Variablen' in Ihrem Experiment verwendet werden können! Beispielsweise können Sie Silhouetten (wie Menschen, Gesichtszüge oder Tiere) innerhalb einer komplexen Szene als Ihre AOIs definieren, indem Sie SVGs hochladen oder sie innerhalb von Labvanced mit dem Polygon-Objekt nachzeichnen.

- Als Hinweis, vielen Dank an alle Forscher, die unsere webcam-basierte Augenverfolgung als Teil ihrer Forschungsmethoden verwendet haben! Wir haben wirklich gesehen, dass diese Zahl seit der Veröffentlichung unseres peer-reviewed Papers vor ein paar Monaten gewachsen ist.

- ChatGPT: Eine neue Integration, die es Ihnen ermöglicht, OpenAI / ChatGPT mit Labvanced zu verbinden. Im Wesentlichen können Teilnehmer in Labvanced über das Eingabefeld schreiben und die Antwort von ChatGPT wird direkt im Experiment angezeigt! Dies ermöglicht Ihnen, Daten darüber zu sammeln, wie diese Interaktionen stattfinden, und gleichzeitig erweiterte Analysen im Hintergrund durchzuführen, während es passiert!

- Unter 'Studieneinstellungen' → 'Experimentfunktionen' können Sie heute die OpenAI-Integration nutzen:

- Aufgabenassistent: Wenn Sie nun Aufgaben in einer neuen Studie erstellen, steht Ihnen der Aufgabenassistent zur Verfügung, um Ihnen den Einstieg zu erleichtern. Sie können Ihre Gesamtstudienstruktur festlegen, einschließlich der Fragebögen zur demografischen Erhebung sowie der Navigation zwischen den Aufgaben, mit nur wenigen Klicks, was Ihnen letztendlich Zeit spart, wenn Sie anfangen!

VERBESSERUNGEN

- Visuelle Trennung von 'Faktoren' & 'Randomisierung' im Editor: Wenn Sie kürzlich Ihr Experiment in Labvanced erstellt haben, haben Sie vielleicht bemerkt, dass sich die linken Menü-Panels leicht verändert haben. Dies wurde vorgenommen, um die Sprache und die Terminologie zu verbessern, aber das zugrunde liegende Datenmodell und die Struktur sind gleich geblieben, sodass zufällige Faktoren und festgelegte Faktoren wie zuvor funktionieren.

- Smartphone-App: Die Smartphone-App wurde weiter in der Beta-Phase evaluiert und es wurden noch mehr Verbesserungen vorgenommen. Sie wird voraussichtlich im kommenden Quartal vollständig live gehen. Jetzt gibt es auch eine Bibliothek von Studien, auf die Sie über Ihr Telefon zugreifen und mit der Erkundung von telefonbasierten Studien beginnen können.

NEUE DOKUMENTE

- Mentale Rotationsaufgabe | Eine räumliche Verarbeitungsaufgabe: Ein ausführlicher Artikel zur mentalen Rotationsaufgabe, einschließlich Beispielen ihrer Verwendung in der Forschung!

- 7 Klassische kognitive Aufgaben: Hier heben wir 7 klassische und beliebte Aufgaben hervor, die in der kognitiven Psychologie verwendet werden. Gibt es etwas, das Sie hinzufügen würden, das noch nicht aufgeführt ist?

- Musikforschung mit Labvanced: Woran arbeiten andere Forscher mit Labvanced im Bereich der Musikpsychologie? Dieser Blogbeitrag gibt einen Überblick über genau das, indem er sich auf relevante Publikationen und deren Forschungsmethoden konzentriert!

NEUE PUBLIKATIONEN

- Jenseits der Bau-Dichte: Von groben bis feingranularen Analysen emotionaler Erfahrungen in städtischen Umgebungen im Journal of Environmental Psychology von Sander, I., et al. (2024).

- Verarbeitung visueller sozial-kommunikativer Hinweise während einer sozialen Wahrnehmung von Handlungsaufgaben bei autistischen und nicht-autistischen Beobachtern in Neuropsychologia von Chouinard, B., Pesquita, A., Enns, J. T., & Chapman, C. S. (2024).

- Multimedia-verbessertes Vokabellernen: Die Rolle von Eingabebedingungen und lernerbezogenen Faktoren in System von Zhang, P., & Zhang, S. (2024).

- Wie Selbstzustände helfen: Beobachtung der Verkörperung von Selbstzuständen durch nonverbales Verhalten in Plos One von Engel, I., et al. (2024).

KOMMENDE

- Längsschnittstudien - E-Mail-Anpassung: In der Vergangenheit wurden Erinnerungs-E-Mails automatisch basierend auf den von Ihnen angegebenen Zeitintervallen gesendet. Jetzt erweitern wir diese Möglichkeit mit der zusätzlichen Option, den Text der automatisierten Erinnerungs-E-Mails für longitudinale Studien anzupassen.

- Desktop-App 2.0: Eine neue und verbesserte Version der Labvanced-Desktop-App wird sehr bald verfügbar sein! Die Desktop-App wird viele nützliche Funktionen haben, wie die Möglichkeit, im Online-/Offline-Modus zu arbeiten, was Ihnen ermöglicht, lokal in Ihrem Labor zu arbeiten und Aufzeichnungen zu machen, sowie einfach mit externen Geräten wie EEGs zu verbinden.

Q1’24 Veröffentlichungsnotizen

NEUE FUNKTIONEN

- Labvanced Mobile jetzt im Playstore! (BETA): Sie können Labvanced-Studien jetzt in unserer spezialisierten Android-App (mit nur 1 Klick) durchführen, was Ihnen noch mehr experimentelle Kontrolle und Design-Optionen bietet. Die Smartphone-App wird ideal für longitudinale Tests und klinische Studien sein, aber alle Studien können geöffnet werden, wenn sie für mobile Anwendungsfälle entworfen wurden. Wir suchen jetzt nach weiteren Beta-Testern, also kontaktieren Sie uns, wenn Sie interessiert sind! Auch die iOS-Version wird bald folgen!

- E-Mail-Verifizierung: Neue Benutzer müssen nun ihre E-Mail-Adresse bei der Anmeldung verifizieren. Monospace-Schriftart jetzt verfügbar: Beim Hinzufügen von Textelementen zu Ihrer Studie können Sie jetzt Monospace als Schriftartoption auswählen.

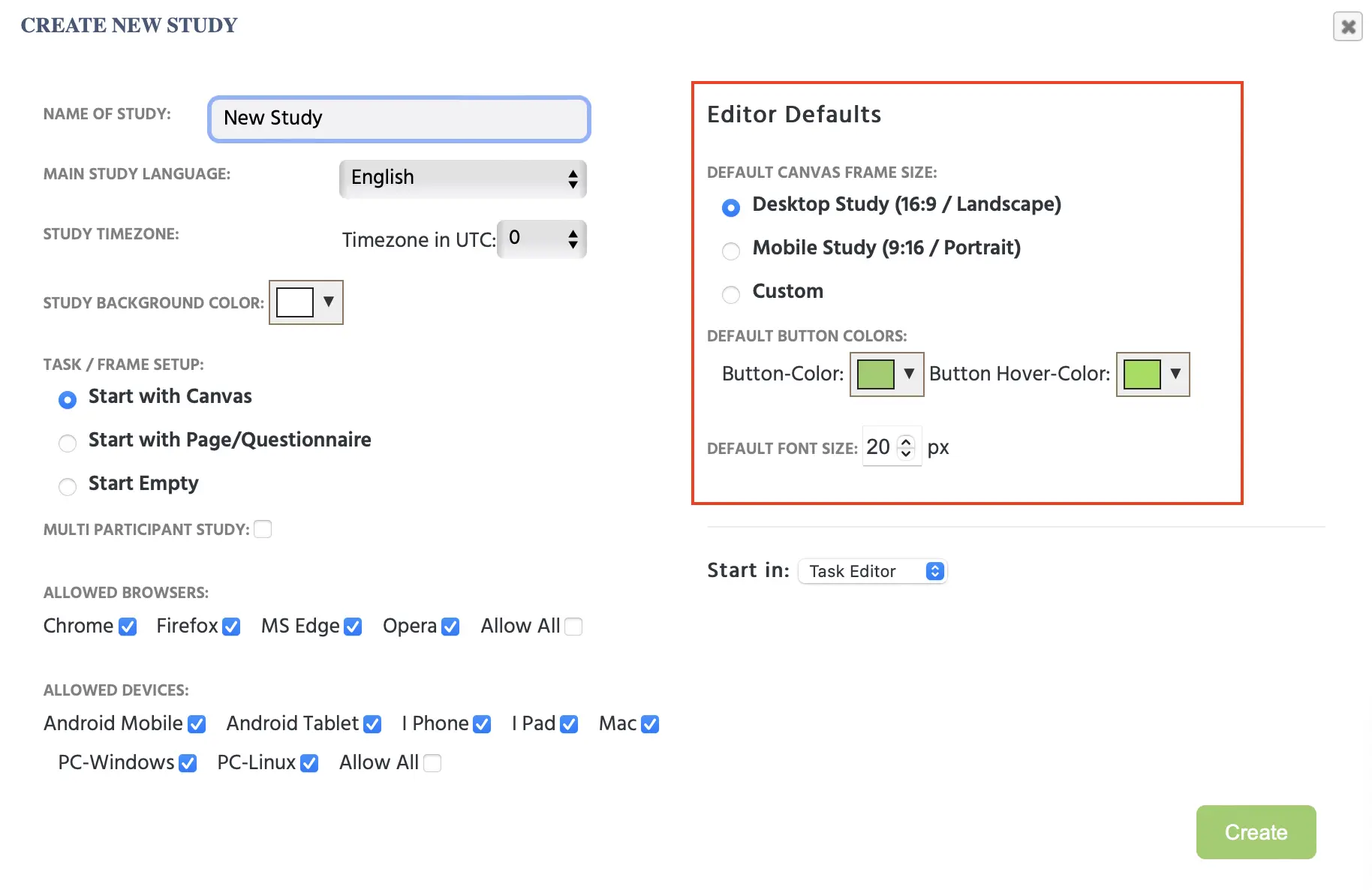

- Standard-Stil für Frames: Wie im Bild unten gezeigt, können Sie jetzt Ihre neue Studie einrichten, indem Sie Standards für Ihre Frames festlegen, z. B. die Rahmenbreite für mobile Studien mit einem Seitenverhältnis von 9:16.

- Standard-Stil für Studien-Buttons: Auch im Bild unten dargestellt, wenn Sie eine neue Studie erstellen, können Sie eine Standardoption für Buttons festlegen, sodass Sie nicht jedes Mal erneut stylen müssen, wenn Sie einen neuen Button zur Studie hinzufügen. Die ausgewählten Standardeinstellungen erstellen automatisch einen stilisierten Button.

- E-Mail-/Benachrichtigungs-Betreuung: Jetzt veröffentlicht - E-Mails und App-Benachrichtigungen sind jetzt aktiv, um Vorschläge zu machen und neue Ideen zu geben sowie neue Benutzer bei der Einarbeitung zu unterstützen, sowie mit der allgemeinen App-Erfahrung zu helfen.

VERBESSERUNGEN

- Foliensystem jetzt verbessert: Das Schieberegler-Element (verwendet für Fragebögen) funktioniert jetzt in allen Fällen, selbst wenn der Schiebereglergriff verborgen ist.

- Verbesserte Sicherheit: Wenn das Passwort geändert wird, sind Sie nun von allen Geräten abgemeldet und alle Sitzungen auf allen Geräten werden ungültig.

- Änderung Ihrer E-Mail automatisch: Die Änderung der mit Ihrem Konto verknüpften E-Mail kann jetzt einfach über die E-Mail-Verifizierung erfolgen.

NEUE DOKUMENTE

- Randomisierung & Balance: Entdecken Sie, wie Randomisierung und Balance in Labvanced behandelt werden und welche Teile der App Sie nutzen können, um sicherzustellen, dass Ihr Experiment randomisiert und ausgewogen ist.

- API-Zugriff: Welche verschiedenen APIs können Sie für Ihr Labvanced-Experiment verwenden? Vom Webhook-API bis zu WebSock und REST-API - wir haben alles für Sie! Erfahren Sie mehr über die Optionen und die Umstände, unter denen Sie sie in dieser API-Übersicht verwenden würden.

- Babyfreundliches & Fern-Augenverfolgung: Wie ist der Stand der Technik, wenn es um Fern- und babyfreundliche Augenverfolgung geht? In diesem Blog diskutieren wir die Herausforderungen und Lösungen für die Verwendung von Fern-Augenverfolgung als Methode in entwicklungspsychologischen Studien.

NEUE PUBLIKATIONEN

Wie nutzen andere Forscher Labvanced? Hier sind einige Highlights jüngster Publikationen!

- Parallelismen und Abweichungen: zwei Grundlagen einer Ästhetik der poetischen Diktion in den Philosophical Transactions of the Royal Society B von Menninghaus, W. et al. (2024).

- Berührung und Blick: Die Rolle von affektiver Berührung bei der Förderung der Aufmerksamkeit von Säuglingen auf komplexe visuelle Szenen in Infancy von Carnevali, L., Della Longa, L., Dragovic, D., & Farroni, T. (2024).

- Auswirkungen eines vorderen Bremslichts auf die Bereitschaft der Fußgänger, die Straße zu überqueren in Transportation Research Interdisciplinary Perspectives von Eisele, D., & Petzoldt, T. (2024).

- Auswirkungen von vertikal ausgerichteten Flankern beim Lesen von Sätzen im Journal of Experimental Psychology: Learning, Memory, and Cognition von Mirault, J., & Grainger, J. (2024).

KOMMENDE

- ChatGPT und weitere KI-Integrationen: Interessiert daran, wie Menschen KI wie chatGPT oder DALL-E nutzen? Wir glauben, dass die Forschung über die Nutzung von KI in den nächsten Jahren explodieren wird, und daher werden wir bald native Integrationen mit chatGPT und anderen bekannten KI-Anwendungen bereitstellen.

- Desktop-App: Wenn Sie ein regelmäßiger Nutzer von Labvanced sind, werden Sie erfreut sein zu sehen, dass bald eine dedizierte Anwendung (für Windows, Linux und Mac) verfügbar sein wird, die einige Vorteile gegenüber der rein browserbasierten Version von Labvanced hat.

- Alle Studien sind sowohl online als auch lokal direkt verfügbar, was das Beste aus beiden Welten kombiniert.

- LSL-Integration und andere dedizierte Hardwareverbindungslösungen über die Desktop-App werden als Nächstes kommen, sodass Sie EEG-Studien durchführen, sich mit einem Drittanbieter-Augenverfolger verbinden und mehr können.

- Weitere native Integrationen für den Datenexport, die Datenanalyse werden in der Desktop-Version verfügbar sein. Welche Funktion begeistert Sie am meisten?

- Augenverfolgung - SVG-Bereich: Mit dieser neuen Funktion können Sie komplexe Formen als definiertes Interessensgebiet für Augenverfolgungsstudien verwenden. Derzeit können Sie einfache Formen (wie ein rechteckiges Bild) als Interessensgebiet verwenden. Mit dieser neuen Funktion können Sie eine SVG einer komplexen Form (wie einem Elefanten) hochladen und Ihre eigenen unsichtbaren Masken erstellen und die Anzahl der Fixationen in diesem Bereich in Augenverfolgungsstudien zählen. In Zukunft werden Sie auch in der Lage sein, einen Bereich nachzuzeichnen.

- PageGazer: Zu verstehen, wie Online-Nutzer sich verhalten und Entscheidungen treffen, hat starke Auswirkungen auf UX-Designer, Marketingfachleute, E-Commerce-Besitzer und sogar auf Produktmanagement und politische Entscheidungsträger.

- Bestehende Werkzeuge, die anbieten, das Verbraucherverhalten auf Websites zu studieren, weisen jedoch klare Mängel auf. Die 3 schwerwiegendsten Einschränkungen sind: 1) Zusätzliche Installationen wie Browser-Plugins erforderlich, was stark einschränkt, wer teilnehmen kann. 2) Die gesamte Website wie ein Bild oder Video zu behandeln, was eine Nachverfolgung von Interaktionen oder eine Aggregation von Daten über Probanden hinweg unmöglich macht. 3) Nur Mausverfolgung anzubieten, aber keine Möglichkeit, die Aufmerksamkeitsprozesse mithilfe von Augenverfolgungstechnologie zu verfolgen.

- PageGazer ist ein neues und leistungsstarkes Tool für Online-Verhalten und Verbraucherforschung, das wir entwickeln und das diese Einschränkungen überwinden und damit die Art von Daten, die gesammelt werden können, und die Erkenntnisse, die in Fern-Datenerfassungs-Szenarien gewonnen werden können, erheblich erweitern wird.

- Wenn das für Sie interessant klingt, abonnieren Sie bitte unseren PageGazer-Newsletter, um über die neuesten Ankündigungen auf dem Laufenden zu bleiben.

Q4’23 Release-Notiz

- Neue & verbesserte Desktop-App - Fast hier: Bringen Sie Labvanced direkt auf Ihren Desktop. Eine überarbeitete und benutzerfreundliche App wird bald für Forscher zum Download auf ihren Desktop für Forschungsprojekte im Labor zur Verfügung stehen. Lokale Studien können direkt mit dem neuesten Online-Zustand automatisch synchronisiert werden, sodass die Erstellung/Bearbeitung von Studien und die lokale (offline) Ausführung miteinander verschmelzen. Wichtig ist, dass unsere vorgefertigten LSL-Python-Skripte hier verwendet werden können, um sich einfach mit externer Hardware wie EEG-Systemen während lokaler Aufzeichnungen zu verbinden. Unsere Vision ist es, eine einzige Anwendung anzubieten, die einfach verwendet werden kann, um sowohl Online- als auch lokale / im Labor durchgeführte Aufzeichnungen unter Verwendung derselben Studie und Code-Basis durchzuführen, anstatt Dinge in verschiedenen Umgebungen neu zu implementieren und auszuführen. Und das ist nur der Anfang!

- Smartphone-App: Beta-Tests: Bitte kontaktieren Sie uns, wenn Sie daran interessiert sind, die Smartphone-App in ihrer Beta-Phase auszuprobieren. Ideal für Forscher, die dieses Feature zukünftig nutzen möchten und Feedback geben möchten. Die Smartphone-App wird für Android und iOS verfügbar sein, was den Forschern mehr Möglichkeiten und Kontrolle über ihr experimentelles Design und die Durchführung in mobilen Testszenarien geben wird. Die App wird zwei grundlegende Zugangspunkte haben:

- Ein Login für Forscher, die sich anmelden und ihre Studien und Aufzeichnungen verwalten und als Admin-Portal nutzen können (auch um Aufzeichnungen zu starten). Dies kann besonders nützlich für Forschungsprojekte vor Ort und/oder klinische Forschung sein.

- Ein (passwortfreies) Remote-Login für Teilnehmer, die einen Deep Link verwenden können, um die App mit einer bestimmten Labvanced-Studien-ID zu öffnen, und die App in eine angepasste Anwendung für eine bestimmte Studie verwandeln. Mit anderen Worten, Sie können Ihre Studie wie gewohnt auf Labvanced erstellen, sie jedoch als mobile native App für Datenerfassungszwecke durchführen. Dies funktioniert natürlich auch in Kombination mit Crowdsourcing-Tools wie Prolific oder mTurk. Die Smartphone-App ist besonders nützlich für longitudinale Studien, d.h. Studien mit mehreren Sitzungen sowie für dezentralisierte klinische Studien oder Schulungssitzungen, in denen Bildungsinterventionen ein Hauptbestandteil sind. Automatische Push-Benachrichtigungen erinnern die Teilnehmer daran, die nächste Sitzung pünktlich abzuschließen. Hinweis: Während die Smartphone/Desktop-App noch nicht als Medizinprodukt lizenziert ist, kann sie in Szenarien verwendet werden, in denen Teilnehmer ins Labor, zur Klinik oder ins Arztbüro kommen, um einen Vor-Ort-Test durchzuführen, ohne auf eine Internetverbindung angewiesen zu sein. Die Daten werden lokal auf dem Gerät aufgezeichnet und automatisch in die Cloud hochgeladen, sobald die Internetverbindung wiederhergestellt ist.

- Falls Sie es verpasst haben: Der webcam-basierte Augenverfolger von Labvanced wurde begutachtet! Sehen Sie sich dieses Papier in der Zeitschrift Behavior Research Methods an und ziehen Sie in Betracht, es in Ihrer nächsten Veröffentlichung zu zitieren! Dies sind einige wichtige Ergebnisse aus dem Papier:

- Die webcam-basierte Augenverfolgung von Labvanced hat eine Gesamtgenauigkeit von 1.4° und eine Präzision von 1.1° mit einem Fehler von etwa 0.5° größer als das EyeLink-System.

- Interessanterweise verbessern sich sowohl Genauigkeit als auch Präzision (auf 1.3° und 0.9°, respektiv) wenn visuelle Ziele in der Mitte des Bildschirms präsentiert werden - etwas, das Forscher beachten sollten, da der Mittelpunkt des Bildschirms in vielen psychologischen Experimenten der Ort ist, an dem Stimuli präsentiert werden.

- Bei der freien Betrachtung und den fließenden Verfolgungsaufgaben betrug die Korrelation etwa 80% zwischen Labvanced- und EyeLink-Blickdaten. Um eine visuelle Demonstration zu sehen, wie diese Korrelation aussieht, siehe Abbildung 7 im Forschungspapier, das die Überlappung der Datenpunkte zwischen Labvanced (blaue Punkte) und EyeLink (rote Punkte) visuell zeigt.

- Auch die Genauigkeit war über die Zeit hinweg konstant. Insgesamt zeigen diese Ergebnisse, dass die webcam-basierte Augenverfolgung von Labvanced eine praktikable Option zur Untersuchung der physiologischen Signale der Aufmerksamkeit ist.

- In Arbeit:

- Erweiterte E-Mail- & Systembenachrichtigungen: Bald erhalten Benutzer maßgeschneiderte Ratschläge, wie sie das Beste aus der Plattform herausholen können, basierend auf maßgeschneiderten Vorschlägen, die über E-Mail und Benachrichtigungen geliefert werden.

- Studien-Assistent: Der Assistent ist ein interaktiver Schritt-für-Schritt-Leitfaden, der neuen Benutzern helfen wird, eine Studie zu erstellen, die mit einer Tabelle konfiguriert wird.

- ET Fixationen: Unsere begutachtete ET-Publikation zeigt unsere Exzellenz in der webcam-basierten Augenverfolgung und bietet arguably die genauesten Blickdaten, die mit dieser Methode erfasst werden. Während andere Lösungen existieren, scheint es, dass keine von ihnen an eine ordnungsgemäße Fixationsdetektion gedacht hat (wahrscheinlich, weil ihre Daten zu laut sind und zu wenige Proben enthalten). Die Klassifizierung von Fixationen ist jedoch ein sehr wichtiger Aspekt der Augenverfolgungsforschung, und während wir bereits einen Algorithmus verfügbar haben, besteht unser nächstes Ziel darin, ihn erheblich zu verbessern. Dafür laufen Rekrutierungs- und Zusammenarbeitsbemühungen.```markdown

Q3’23 Release Note

- Unsere neue Veröffentlichung zu unserem Webcam-basierten Eye Tracking: Wir freuen uns bekanntzugeben, dass unsere neueste Veröffentlichung, die die Genauigkeit unseres Webcam-Eye-Tracking-Systems mit einem Industriestandard (EyeLink 1000) vergleicht, endlich veröffentlicht wurde. Auch wenn wir dafür einiges an Zeit und Ressourcen aufwenden mussten, bestätigt sie unsere Methodik in einer sehr angesehenen Fachzeitschrift und wir freuen uns sehr, dies heute mit Ihnen zu teilen! Ein großes Dankeschön an alle Forscher, die unser Eye Tracking bereits verwendet haben, und eine große Einladung an alle anderen, es ebenfalls zu tun! Die Veröffentlichung finden Sie hier in der Zeitschrift für Verhaltensforschungsmethoden.

- Die wichtigsten Ergebnisse der Veröffentlichung:

- Das Webcam-basierte Eye Tracking von Labvanced hat eine Gesamgenauigkeit von 1,4° und eine Präzision von 1,1° mit einem Fehler von etwa 0,5° größer als das EyeLink-System

- Interessanterweise verbessern sich sowohl Genauigkeit als auch Präzision (auf 1,3° bzw. 0,9°), wenn visuelle Ziele in der Mitte des Bildschirms präsentiert werden - etwas, das für Forscher wichtig ist zu berücksichtigen, da die Mitte des Bildschirms der Ort ist, an dem in vielen psychologischen Experimenten Stimuli präsentiert werden.

- Für freie Betrachtungs- und glatte Verfolgungsaufgaben betrug die Korrelation etwa 80% zwischen den Blickdaten von Labvanced und EyeLink. Für eine visuelle Demonstration, wie diese Korrelation aussieht, siehe Abbildung 7 aus der Veröffentlichung, die die Überlappung zwischen den Datenpunkten von Labvanced (blaue Punkte) und EyeLink (rote Punkte) zeigt.

- Außerdem war die Genauigkeit im Zeitverlauf konsistent.

- Die wichtigsten Ergebnisse der Veröffentlichung:

- Auszeichnung mit der Finanzierung des Europäischen Netzwerks für KI-Exzellenz (ELISE): Als KI-Forscher, die Ihnen genaues Webcam-basiertes Eye Tracking ermöglicht haben, hilft uns die Auszeichnung mit dem Förderprogramm des Europäischen Netzwerks für KI-Exzellenz (ELISE), den nächsten Schritt zu machen, um Ihnen mehr Möglichkeiten für Online-Forschung durch die Entwicklung von PageGazer anzubieten. Während wir dieselbe zugrunde liegende Technologie nutzen, wird PageGazer eine neue Plattform sein, die sich auf die Durchführung von UI/UX-, Marketing- und allgemeiner Website-Forschung konzentriert. PageGazer wird die Fähigkeit haben, unsere innovative Eye-Tracking-Technologie in jede Website zu integrieren und dies mit intelligenter Website-Parsing zu kombinieren, um neue Forschungseinblicke zu gewinnen. Die Elise-Finanzierung wird uns helfen, dieses Ziel schneller und effizienter zu erreichen und bestätigt erneut die Exzellenz und Innovation unseres Ansatzes. Wenn Sie mehr darüber erfahren oder Teil einer EXKLUSIVEN und kostenlosen BETA-TESTPHASE für PageGazer sein möchten, kontaktieren Sie uns bitte. Wir suchen derzeit nach ersten Nutzern, die begeistert sind, etwas Neues auszuprobieren!

- Neue Funktionen:

- Canvas (Freihandzeichnen) Element: Das Canvas (Freihandzeichnen) Element ist jetzt als Formenobjekt verfügbar, das Sie in Ihrem Experiment verwenden können, um frei mit Formen, Strichen oder Text zu zeichnen. Dies ermöglicht Ihnen oder den Teilnehmern, freiformreiche Antworten in einem Experiment einzugeben.

- Medienelemente in Fragebögen: Es ist nun möglich, Medienelemente wie Videos direkt in Fragebögen (d.h. Seitenrahmen) einzufügen. Dies gibt Ihnen mehr Kontrolle über Ihren experimentellen Erstellungprozess, da Sie verschiedene Arten von visuellen Inhalten direkt in die Umfrage einfügen können.

- Resting API-Integration: Jetzt verfügbar, ermöglicht die Resting API den programmgesteuerten Download von Daten. Sie müssen nur ein API-Token in der Anwendung erstellen, um sich über den API-Client zu authentifizieren, was Ihnen den sofortigen Zugriff auf die Daten über den Server ermöglicht. Forscher haben bereits begonnen, diese neue Funktion zu nutzen, da sie es ihnen ermöglicht, ihren Prozess weiter zu optimieren, indem sie lokale Daten abrufen können. Die Resting API ist großartig für Organisationen und akademische Forschungseinrichtungen, die ihre Datenerfassung zentralisieren und ihre Daten gemäß ihrem Pipeline-Protokoll an speziellen Orten speichern möchten. Anstatt Daten manuell auszuwählen und lokal zu speichern, können Sie über Ihre Server auf die Daten zugreifen, was für das GDPR-Protokoll wichtig ist.

- Verbesserungen:

- Serverseitige Verbesserungen: Auch wenn sie für Sie in Ihrem täglichen experimentellen Erstellungs- und Prozess nicht direkt sichtbar sind, haben unsere neuesten serverseitigen Verbesserungen einen großen Einfluss auf Online-Studien, da sie eine verbesserte Leistung und Zuverlässigkeit gewährleisten. Einige Beispiele für die Verbesserungen, die wir vorgenommen haben, sind: erhöhte Serverkapazität, mehr automatisierte Updates, ein automatisches Failover, falls ein Server ausfällt, und bessere Überwachungsdienste zur Bewertung der Gesundheit der Server.

- Neuer Zahlungsablauf: Der neue Zahlungsablauf ist da! Für neue Lizenznehmer ist die Zahlung nun erforderlich, bevor die Lizenz aktiviert wird. Einige andere verwandte Verbesserungen umfassen: verbessertes UI, einen sicheren öffentlichen Zahlungslink, der einer anderen Person die Zahlung Ihrer Lizenz ermöglicht (wichtig für Einkaufsabteilungen), das Wiedereröffnen einer Bestellung und die automatische Erkennung von Zahlungen per Banküberweisung durch Referenzcodeerkennung.

- In Arbeit:

- Smartphone-App: Mit einer mobilen App können klinische Studien und Längsschnittstudien Labvanced stärker nutzen, z.B. durch Funktionen wie Push-Benachrichtigungen, um an die Teilnahme zu erinnern und nicht auf das Internet für bestimmte Aufgaben angewiesen zu sein.

- Desktop-App: Mit LSL-Integration und Online-/Offline-Modi (d.h. lokal) kombiniert in einer Desktop-App können Sie Labvanced mit lokalen Geräten wie EEG mit LSL-Integration verbinden.

- E-Mail-Nurturing und Benachrichtigungen: Bald werden Nutzer maßgeschneiderte Ratschläge erhalten, wie sie das Beste aus der Plattform herausholen können, basierend auf maßgeschneiderten Vorschlägen, die über E-Mail und Benachrichtigungen bereitgestellt werden.

- Neuer Studienassistent: Um eine beschleunigte Studienimplementierung sicherzustellen, wird ein Studienassistent für neue Nutzer verfügbar sein, die bei ihrem ersten Beitritt zu Labvanced eine Lernkurve erleben, um ihre Studie dorthin zu bringen, wo sie sein muss!

Q2’23 Release Note

- Forschungsstipendienprogramm: Eine neue und spannende Möglichkeit für alle Forscher da draußen, dieses Stipendienprogramm ist perfekt für diejenigen, die ihre Karrieren und Glaubwürdigkeit mit einem kleinen Stipendium fördern möchten, das ihre Forschung in Labvanced unterstützt. Zu den Vorteilen gehören finanzielle Unterstützung für die Teilnahme an Konferenzen sowie die Rekrutierung von Studien Teilnehmern.

- Freihandzeichnen-Element: Auf vielfachen Wunsch können Sie jetzt direkt im Editor zeichnen, dank des neu hinzugefügten Canvas-Zeichenelements. Diese neue Funktion ermöglicht es dem Experimentleiter und den Teilnehmern, frei zu zeichnen, aber auch Formen wie Kreise und Dreiecke einzufügen. Diese Funktion kann für viele experimentelle Anwendungsfälle wie freie Assoziation relevant sein.

Automatische Subjektzuweisung: Stärkere Randomisierung und Balance Diese Anfrage, die von vielen Forschern gestellt wurde, die stärkere Ausgleichsmethoden wollten, ist hier! Jetzt ist die automatische Subjektzuweisung in Labvanced möglich. Was bedeutet das? Angenommen, Subjekt 17 zieht sich aus dem Experiment zurück, das System kann jetzt automatisch ein Subjekt zuweisen, um diese Subjektnummer auszufüllen. Warum ist das wichtig? Weil die Subjektnummer in vielen Experimenten eine Rolle bei der Art der Stimuli spielt, die der Teilnehmer sieht. In der Vergangenheit berücksichtigte das System Ausfälle auf Stimuli-Ebene und nicht auf Gruppenebene. Durch dieses Feature ist die Randomisierung leistungsfähiger geworden. Ein weiteres Beispiel für diese Funktion wird während manueller Ausschlussverfahren sichtbar. Wenn der Forscher einen Teilnehmer aus beliebigem Grund manuell ausschließt, kann das nächste neu eingeschriebene Teilnehmer die Stelle des ausgeschlossenen Teilnehmers automatisch ausfüllen. Dadurch wird sichergestellt, dass das Experiment abgeschlossen wird und dass die Forscher alle benötigten Daten erhalten. - Umschalter für Eye Tracking, um es kindgerecht zu machen: In den Einstellungen für Eye Tracking gibt es einen neu implementierten Umschalter, der das kindgerechte Eye Tracking aktivieren kann. Dieser Umschalter schaltet diese Einstellung ein oder aus. Vor diesem Update war es nur eine Checkbox und sobald sie aktiviert war, ließ sie sich nicht mehr deaktivieren.

- Safari ist jetzt standardmäßig als Browser deaktiviert: Safari ist ein merkwürdiger Browser, der nicht immer wie erwartet funktioniert, insbesondere wenn es um innovative browserbasierte Technologien wie Labvanced geht. Wir haben Safari als Option für die Durchführung von Experimenten deaktiviert (ja, es kann wieder aktiviert und verfügbar gemacht werden). Der Grund für diese Entscheidung war, dass fortschrittlichere Funktionen wie Eye Tracking und Audio-Autoplay in diesem Browser nicht so gut funktionierten, daher wird Safari nicht für Experimente mit solchen fortgeschrittenen Funktionen empfohlen.

- Zusammenführung von Audio-/Video-Triggern und Objekt-Triggern in einen einzigen Trigger: Die Benutzeroberfläche des Editors wurde aktualisiert, sodass der Trigger für Audio/Video derselbe ist wie der Objekt-Trigger. Je nach Art des Triggers wird ein Dropdown-Menü mit spezifischen Optionen angezeigt. Dies hilft, den Prozess der Erstellung von Experimenten zu rationalisieren und verringert die Notwendigkeit, wiederholt mehrere Schritte auszuführen. Bitte beachten Sie, dass bestehende Studien, die den jetzt eingestellten Audio-/Video-Trigger verwenden, nicht betroffen sind.

- Zusammenführung von Audio-/Video- und Steuerobjektaktionen in eine einzige Aktion: Ähnlich wie bei dem oben genannten Punkt bezüglich der Trigger, wurde dasselbe für die entsprechenden Aktionen für Audio/Video und Steuerobjekt vorgenommen. Bitte beachten Sie, dass bestehende Studien, die den jetzt eingestellten Audio-/Video-Trigger verwenden, nicht betroffen sind.

- Easier sharing for group license holders: Wenn Sie eine Gruppenlizenz haben, ist es nun einfacher, Studien mit Personen zu teilen, die dieselbe Klassenlizenz oder Einlösungscode haben. Dies funktioniert für 6 Monate, nachdem der Code aktiviert wurde, auch wenn sie eine andere Lizenz haben oder nur ein kostenloses Konto besitzen.

- In Arbeit

- Neue Resting API: Dies ist eine Standard-API, die generiert wird und mit einem Code funktioniert, der es Ihnen ermöglicht, sich anzumelden und alle Ihre Daten programmgesteuert herunterzuladen. Die Resting API wird großartig für Organisationen und akademische Forschungseinrichtungen sein, die ihre Datenerfassung zentralisieren und ihre Daten gemäß ihrem Pipeline-Protokoll an speziellen Orten speichern möchten. Anstatt Daten manuell auszuwählen und lokal zu speichern, ermöglicht dies Organisationen, auf ihre Daten auf ihren Servern zuzugreifen, was für das GDPR-Protokoll wichtig ist.

- Onboarding: Wir arbeiten weiterhin am Onboarding-Prozess, bei dem neue Benutzer auf interaktive Weise lernen können, sobald sie ein neues Konto erstellen.

## <a id="q422-q123"></a> Q4’22 Release Note

* **Neues Dashboard:** Wir haben ein neues Dashboard eingeführt, das stärker ist als je zuvor und entwickelt wurde, um Ihnen zu helfen, die Labvanced-Plattform zu meistern und über alle aktuellen Updates informiert zu bleiben. Auf dem neuen Dashboard finden Sie:

* Checklisten, die speziell als Onboarding-Tools entwickelt wurden

* Studieneinblicke, um Ihren Forschungsfortschritt zu verfolgen

* Videos, die in der Reihenfolge angeordnet sind, die Ihnen am besten die LV-Plattform beibringt

* Benachrichtigungen, Bibliotheksupdates und Twitter-Feed alles an einem Ort

* **Aktionsgruppen:** [Ereignisse](https://www.labvanced.com/content/learn/de/guide/task-editor/event-system.html) haben zwei Hauptkomponenten, eine Variable und einen Trigger. Oftmals erfordert ein Trigger, dass mehrere Aktionen durchgeführt werden. Zum Beispiel, wenn ein Teilnehmer auf einen Knopf klickt, muss ein Stimulus vergrößert, die Position geändert und ausgeblendet werden. Jetzt können Sie diese drei Aktionen (und mehr, je nach Ihrem Experiment) in einer einzelnen Gruppe zusammenfassen! Das hilft bei der Organisation und dem Kopieren der Aktionen, damit Sie effizienter beim Erstellen eines Experiments arbeiten können.

* **Geteilte Variablen:** Geteilte Variablen sind dynamische Variablen, die über mehrere experimentelle Sitzungen und/oder Teilnehmer hinweg geteilt werden können. Die Variablen werden auf dem Labvanced-Server gespeichert und fungieren als Array, um Ihnen ein neues Niveau experimenteller Möglichkeiten beim Erstellen und Planen Ihrer Studie zu eröffnen. Die geteilten Variablen sind besonders nützlich für längsschnittliche Studien, aber auch für Multi-User-Studien und helfen sogar bei der Ausbalancierung zwischen den Teilnehmern. Hier ist ein Beispiel für geteilte Variablen in Aktion: Stellen Sie sich vor, Ihre Studie hat 10.000 Bilder und Sie möchten jedem Teilnehmer 100 Bilder zeigen. Mit der geteilten Variablen können Sie 'erinnern', welche der 100 Bilder gezeigt wurden, und die verbleibenden Bilder zufällig anderen Teilnehmern zuweisen. Ziemlich cool, oder?

* **'Von Lesen/Zu Schreiben'-Aktionsbefehl:** Dies ist eine neue Aktion, die Sie zu Ihren Variablen hinzufügen können, um Daten aufzuzeichnen (d. h. 'Von Lesen') und zu speichern (d. h. 'Zu Schreiben'). Jetzt können Sie die folgenden Optionen verwenden, um Variablenwerte aufzuzeichnen und zu speichern:

* **Option 1, Gerät:** Diese Option liest Variablen Daten und speichert sie auf dem lokalen Gerät. Dies ist nützlich für Daten, die lokal gespeichert werden müssen. Zum Beispiel, wenn Sie eine längsschnittliche Studie durchführen und sicherstellen müssen, dass die Teilnehmer dasselbe Gerät über das gesamte Experiment verwenden.

* **Option 2, Geteilte Variable:** Das Lesen und Speichern von Daten in geteilte Variablen ist eine sehr leistungsstarke Option. In diesem Fall werden die Daten auf den Servern gespeichert und können je nach dem, was Sie tun möchten, an andere Versuchssitzungen sowie Teilnehmer verteilt werden.

* **Benutzerdefiniertes CSS im Task-Editor:** Die CSS-Eigenschaften eines Elements können im Tab "Objekteigenschaften" geändert werden, indem Sie auf das Element klicken und das Kästchen „CSS-Eigenschaften ändern“ aktivieren. Dadurch wird die Fähigkeit hinzugefügt, benutzerdefinierten Code für ein Objekt zu schreiben, um dessen Erscheinungsbild spezifischer zu ändern als nur mit dem Fenster für Objekteigenschaften. Sehen Sie ein Beispiel von [wie das benutzerdefinierte CSS funktioniert](https://www.labvanced.com/content/learn/de/guide/task-editor/objects.html#description) im Task-Editor. Dies ist die erste Iteration und weitere Verbesserungen werden folgen.

* **Startseite: Neu & Verbesserte:** Die Startseite hat ein enormes Make-over erhalten! Sie enthält viele neue Informationen über die Labvanced-Plattform, Anwendungsfälle, Testimonials und die Möglichkeit, ein Support-Gespräch mit einem speziellen Dialogfeld zu beantragen, das sich öffnet, sowie ein Newsletterfeld, in dem Sie sich anmelden können, um Updates und Versionshinweise wie diesen hier zu erhalten.

* **Eye Tracking: Schneller & Präziser:** **Wahrscheinlich unsere aufregendste Ankündigung in diesem gesamten Veröffentlichungsnotiz, unser webcam-basiertes Eye Tracking hat ein großes Upgrade erhalten, das es Ihnen ermöglicht, neue Höhen der zeitlichen Genauigkeit in Ihrer Forschung zu erreichen!**