10 Exemples d'Expériences Linguistiques Populaires dans Labvanced

Les chercheurs en langue et en parole utilisent des plateformes d'expérimentation en ligne comme Labvanced pour réaliser leurs diverses études, car c'est un moyen de rassembler rapidement des participants et des données.

En menant des expériences dans un laboratoire de langue virtuel, en publiant des études en ligne et en les partageant via le web, les linguistes et les psychologues cognitifs non seulement complètent plus rapidement leurs recherches mais créent également leurs expériences rapidement et sans code.

Ci-dessous, nous mettons en avant 10 expériences linguistiques populaires qui peuvent être réalisées dans Labvanced pour étudier la perception de la parole et la compréhension du langage, chacune démontrant une capacité ou une caractéristique différente de la plateforme.

1. Tâche de l'Effet Stroop Multimodal

La Tâche de l'Effet Stroop Multimodal est une tâche classique qui remet en question les associations cognitives des participants.

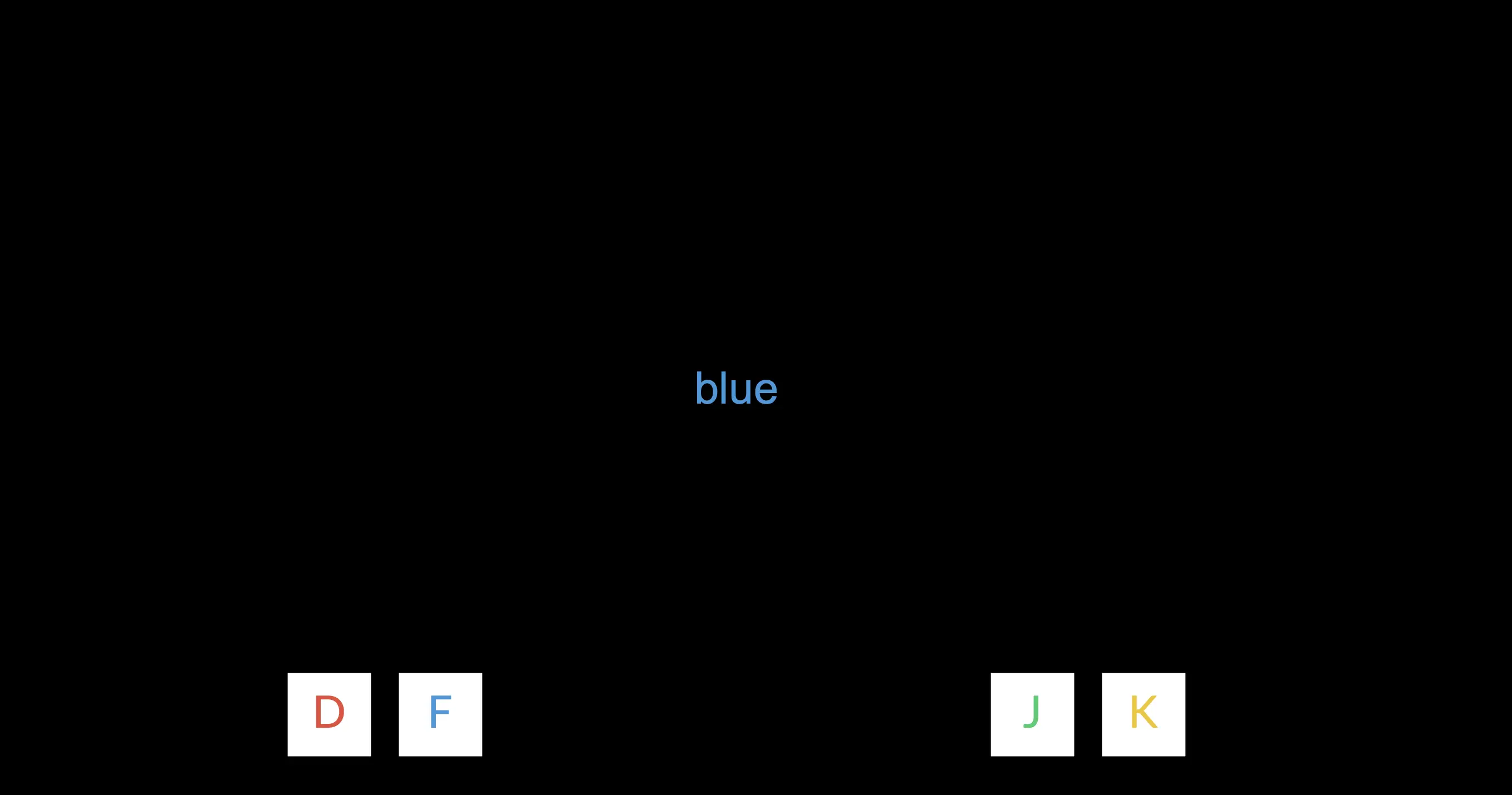

Dans l'étude, des mots comme ‘bleu’ ou ‘vert’ sont affichés un par un avec une couleur de texte variable, correspondant parfois à ce que le mot écrit indique. Cette incongruence met au défi le participant. Essayez-le ici !

L'étude invite le participant à se concentrer sur la couleur du texte et à ignorer la signification du texte. Pendant l'expérience, il y a aussi des mots auditifs distrayants prononcés, une voix qui dit l'une des 4 couleurs présentées.

Dans la session de formation, le participant s'entraîne à se concentrer sur la couleur du texte et à cliquer sur le bouton correspondant. Les deux autres dimensions (mot prononcé et texte écrit) sont congruentes et reflètent la couleur cible.

Dans l'exemple ci-dessous de la session de formation, la réponse correcte est ‘F’ car la couleur du texte est bleue. Mais le participant est également renforcé car le mot écrit est bleu et l'audio joué dit aussi automatiquement ‘bleu.’

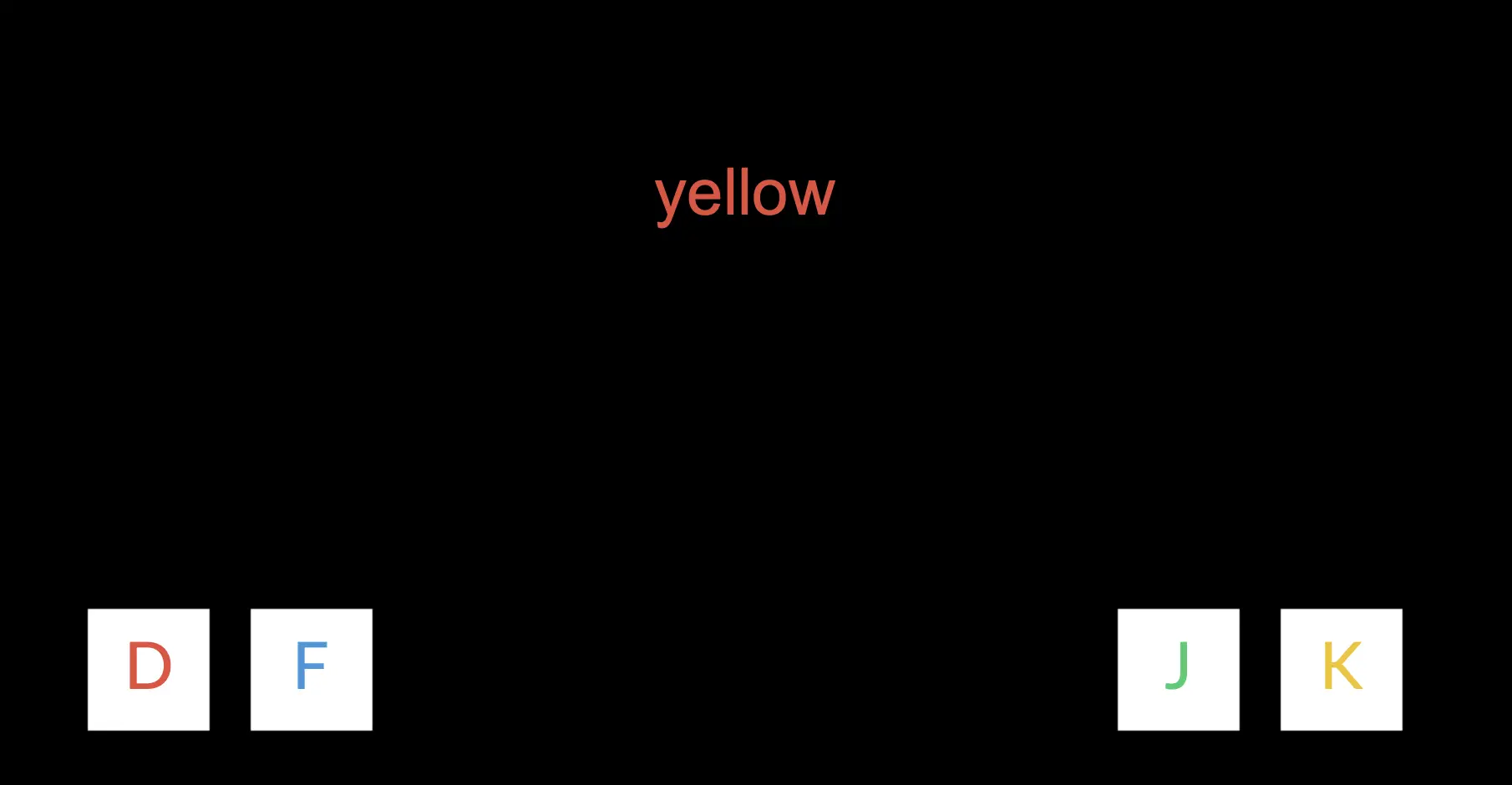

Dans l'expérience, les choses deviennent plus difficiles car les trois dimensions sont incongruentes.

Dans l'exemple ci-dessous, la réponse correcte est ‘D’ car la couleur est rouge, mais le mot écrit dit ‘jaune’ et la voix audio dit ‘bleu.’

Ainsi, le participant est mis au défi de se concentrer et de limiter les diverses associations cognitives afin de choisir la bonne réponse et de surmonter les indices linguistiques écrits et parlés.

📌 Mise en Avant de la Publication : L'influence de la dominance linguistique entre tâches linguistiques et non-linguistiques

Dans cette étude, réalisée dans Labvanced, les chercheurs ont créé et mis en œuvre une série de tâches linguistiques et non linguistiques afin de déterminer comment la dominance linguistique influence les effets d'interférence et de facilitation dans les tâches linguistiques et non linguistiques ainsi que la relation entre les performances sur les tâches linguistiques et non linguistiques. Par exemple, la Tâche d'Interférence Image-Mot (PWI) ainsi que la Tâche Stroop Spatial Non-Linguistique ont été administrées dans ce but. Les chercheurs suggèrent que la dominance linguistique module la performance tant sur les tâches linguistiques que non linguistiques.

Référence : Gálvez-McDonough, A. F., Blumenfeld, H. K., Barragán-Diaz, A., Anthony, J. J. R., & Riès, S. K. (2024). Influence de la dominance linguistique sur la résolution d'interférence crosslinguistique et non-linguistique chez les bilingues. Bilinguisme : Langue et Cognition, 1-14.

2. Terminez la Phrase

Cette étude, publiée par le Département de Linguistique de l'UCLA vise à tester comment les locuteurs natifs adultes de l'anglais américain terminent des phrases.

Les participants doivent écouter des fragments de phrases et ensuite fournir une réponse où leur voix est enregistrée en utilisant le microphone de leur ordinateur, complétant le fragment de phrase en une phrase complète.

Les participants sont invités à fournir une réponse en utilisant la première chose qui leur vient à l'esprit et sans aucune hésitation.

- Le participant teste la fonction d'enregistrement de Labvanced pour s'assurer que son enregistrement fonctionne.

- Le participant se rend à l'écran suivant et clique sur ‘Play’ pour entendre le fragment de phrase.

- Ensuite, le participant est invité à penser à une manière de compléter la phrase en commençant par le fragment qu'il vient d'entendre.

- Le participant clique sur le bouton d'enregistrement et dit la phrase entière à voix haute.

L'étude vise à accroître les connaissances scientifiques sur la parole et le langage humain. Les chercheurs affirment que les informations recueillies auront des implications positives pour plusieurs domaines, notamment : la mise en œuvre de technologies informatiques, l'enseignement des langues et le traitement en pathologie de la parole.

📌 Mise en Avant de la Publication : Tâche de complétion de phrase basée sur un labyrinthe

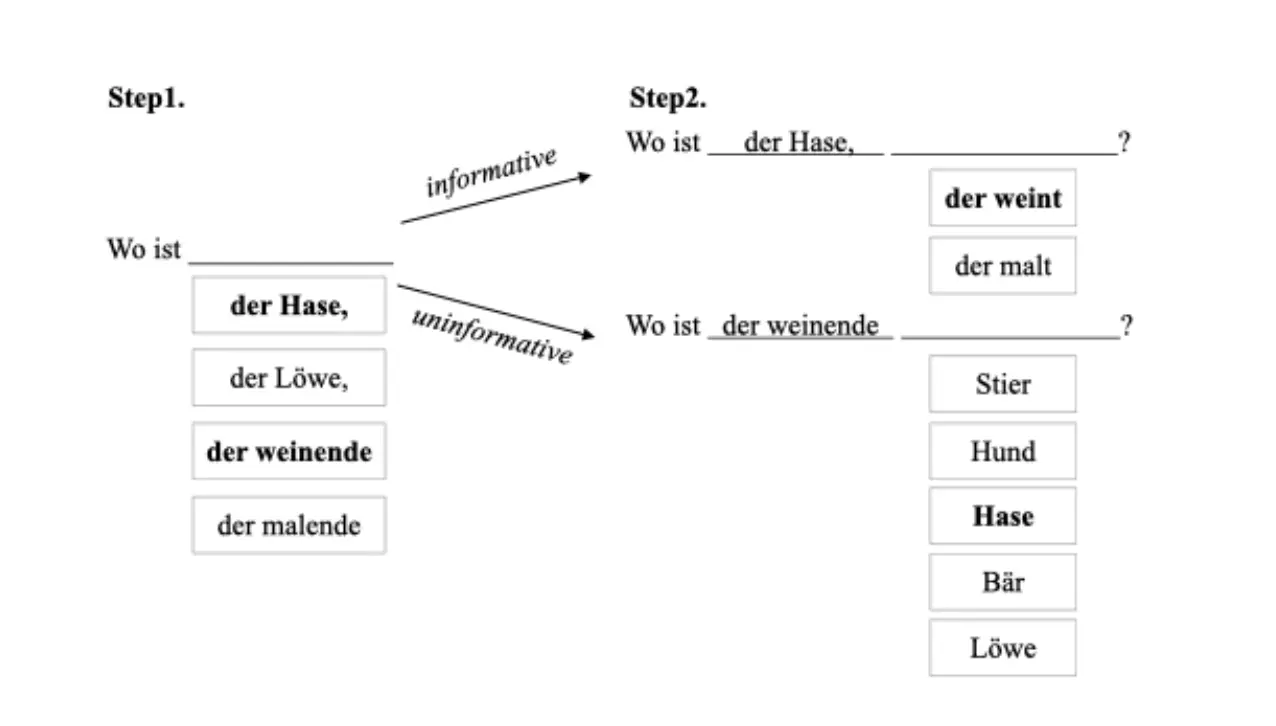

Une autre approche des tâches de complétion de phrase consiste à sélectionner ou à saisir un mot, au lieu de compléter la phrase en parlant (comme dans l'étude ci-dessus). Dans l'étude décrite ci-dessous, réalisée dans Labvanced par Li et al., 2023, les chercheurs ont administré une tâche de complétion de phrase basée sur un labyrinthe. Les participants devaient sélectionner une description pour une cible donnée en sélectionnant successivement deux parties de leurs expressions à partir d'une liste d'options :

Référence : Li, M., Venhuizen, N. J., Jachmann, T. K., Drenhaus, H., & Crocker, M. W. (2023). L'informativité module-t-elle les préférences de linéarisation dans la production de référence ?. Dans Actes de la Réunion Annuelle de la Société de Science Cognitive (Vol. 45, No. 45). CC BY 4.0

3. Dimensions & Sons

Dans cette expérience de parole et de langage du Max Planck Institute for Empirical Aesthetics à Francfort, les chercheurs ont cherché à étudier comment les vocalisations sont perçues.

Les participants commencent par remplir un simple questionnaire à leur sujet. Ensuite, ils sont instruits à écouter des sons et des vocalisations. Après avoir perçu les stimuli audio, les participants sont invités à évaluer le son sur 2 échelles.

Cette expérience démontre comment incorporer un questionnaire au début de l'étude puis utiliser l'audio pour étudier la perception humaine du son des vocalisations.

📌 Mise en Avant de la Publication : Interjections affectives et vocalisations à travers les langues

Dans cette recherche, qui a utilisé Labvanced, l'objectif était d'étudier, à travers les langues, la nature des signatures vocales dans les interjections émotionnelles et les vocalisations non linguistiques qui expriment la douleur, le dégoût et la joie à travers les langues. Les chercheurs ont analysé les voyelles et les interjections de plus de 130 langues et ont découvert plusieurs résultats intéressants.

Référence : Ponsonnet, M., Coupé, C., Pellegrino, F., Garcia Arasco, A., & Pisanski, K. (2024). Signatures vocaliques dans des interjections émotionnelles et des vocalisations non linguistiques exprimant la douleur, le dégoût et la joie à travers les langues. The Journal of the Acoustical Society of America, 156(5), 3118-3139.

4. Étude de Prononciation Espagnole

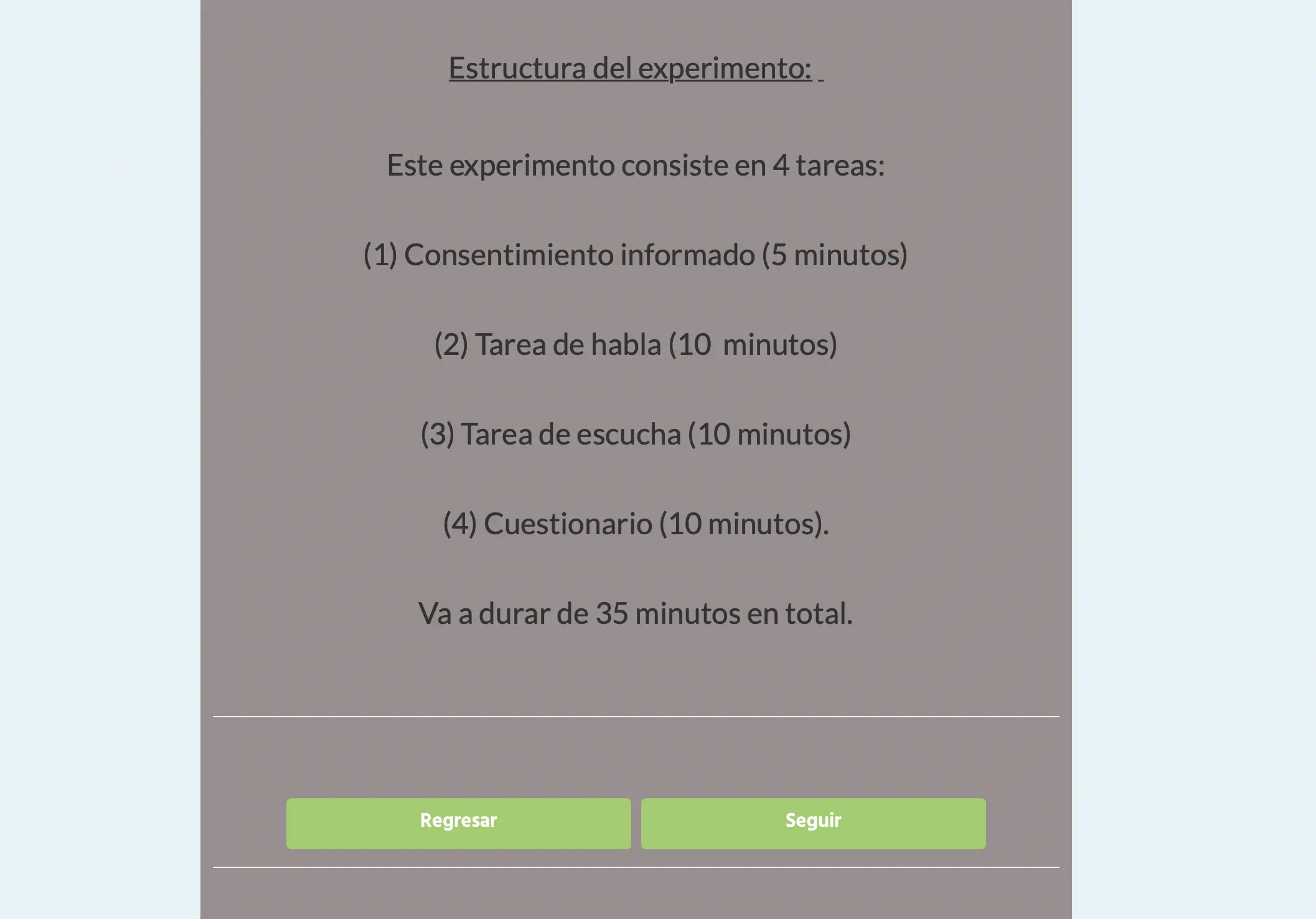

L'Étude de Prononciation Espagnole est l'un des nombreux expériences de l'Université de Toronto publiées dans Labvanced. L'expérience est en espagnol, mais peut également être administrée en portugais, et teste la compréhension et les capacités linguistiques du participant à travers des tâches de parole et d'écoute.

Dans cette étude, le participant passe en revue les informations concernant la procédure expérimentale. Ensuite, il y a 2 courtes tâches à compléter, d'environ 10 minutes chacune. La première tâche concerne la parole et la lecture et la seconde tâche concerne l'écoute.

À la fin, il y a un questionnaire afin que le participant puisse fournir des informations de base sur lui-même, ainsi que toute information pertinente sur son parcours d'apprentissage linguistique.

Labvanced est utilisé pour de nombreuses études d'apprentissage des langues et bilatérales. Les chercheurs peuvent concevoir leur expérience dans n'importe quelle langue, choisir de limiter une étude uniquement à des locuteurs spécifiques, et partager l'étude à l'international afin que différents locuteurs de langues puissent participer depuis le monde entier ou garder l'étude locale pour examiner l'apprentissage des langues dans un groupe spécifique, comme des étudiants d'une université apprenant une deuxième langue.

📌 Point de Publication : Prosodie de l'Espagnol de Montevideo

Dans cette étude, les chercheurs ont utilisé Labvanced afin de créer le premier profil de l'Espagnol de Montevideo (EM), une variété rioplatense parlée en Uruguay qui a des racines dans l'espagnol castillan et l'italien, ainsi que des influences d'autres langues, y compris le Guarani, le Quechua et le portugais. Cette recherche visait à fournir la première description prosodique complète de l'Espagnol de Montevideo (EM) en analysant son intonation, son rythme et son tempo. Les chercheurs ont utilisé Labvanced pour enregistrer des participants à travers différentes tâches de production afin de capturer une large gamme de discours naturalistes.

Référence : Machado, V., & Escobar, L. (2023). La prosodie de l'Espagnol de Montevideo : une description intonative, rythmique et temporelle. Canadian Journal of Linguistics.

5. Voix & Bien-être

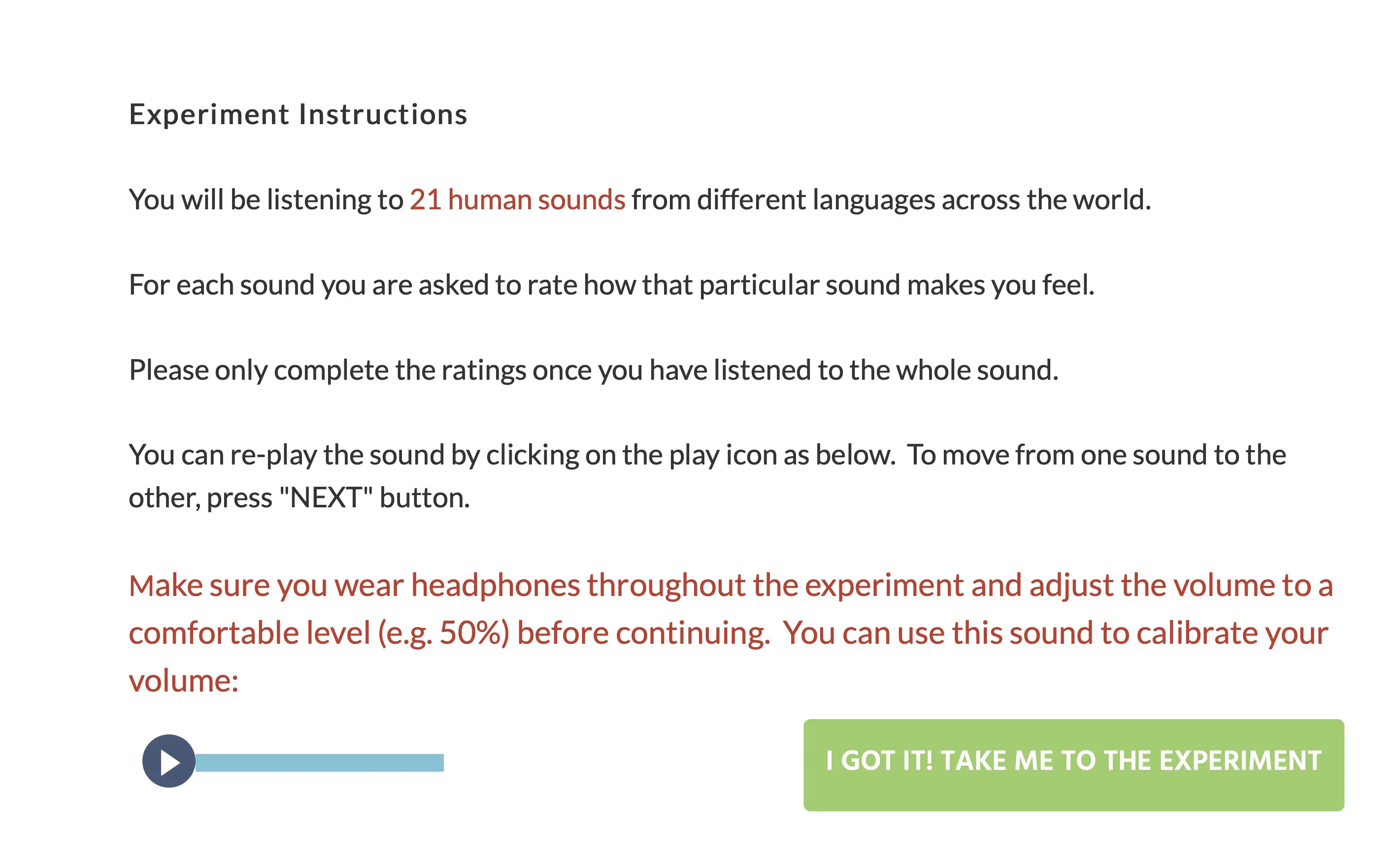

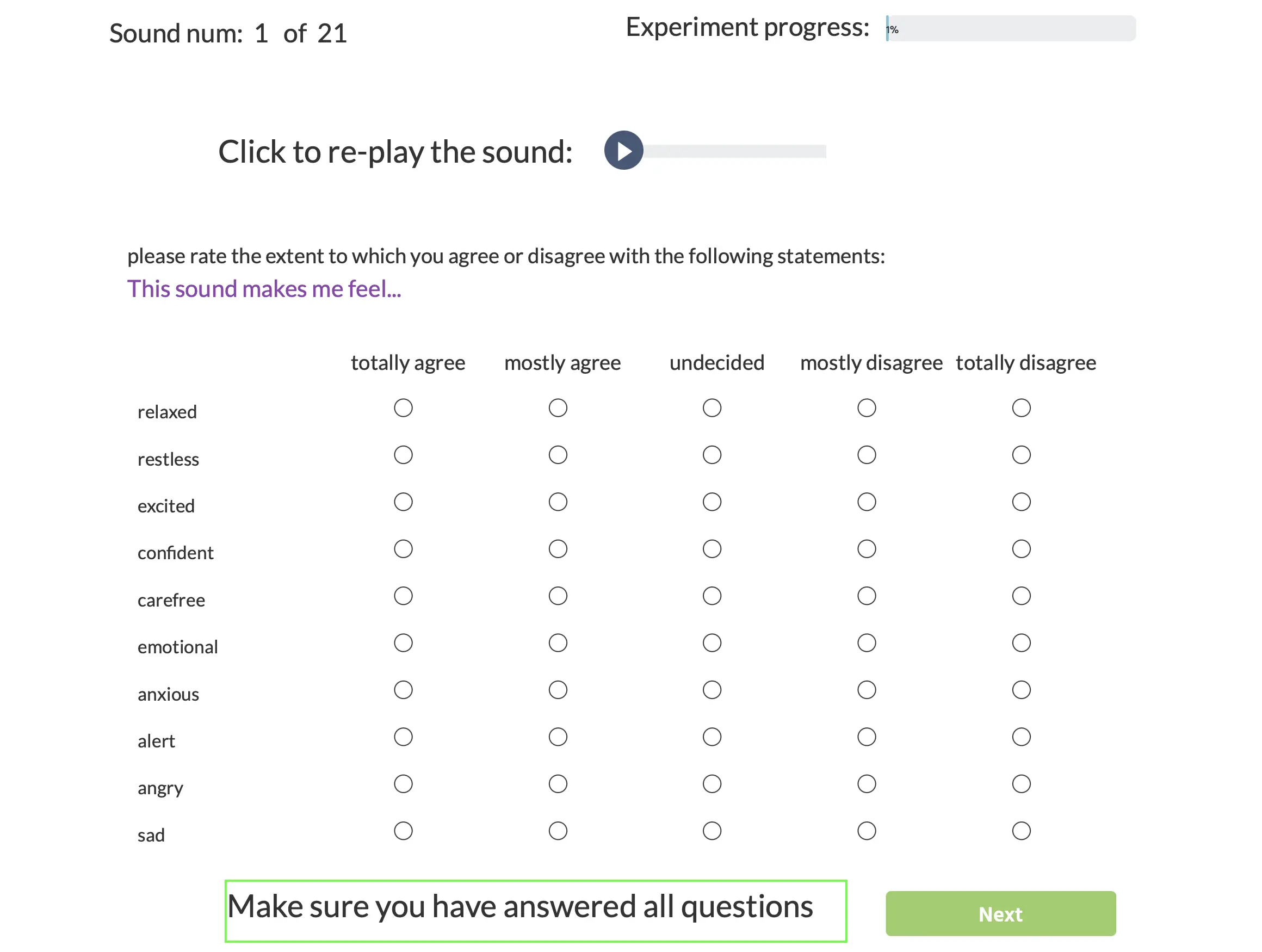

Dans cette étude, la relation entre la perception sonore et les émotions est évaluée. Les participants sont invités à écouter 21 sons humains provenant du monde entier. Après avoir entendu ce clip, le participant doit évaluer comment le son l’a fait se sentir en utilisant des échelles de Likert à 5 points.

L'écran expérimental s'ouvre avec les instructions de l'expérience. Vers la fin de l'explication, il y a un ajusteur de volume sonore où le participant peut ajuster et calibrer l'audio à un niveau confortable :

Après avoir calibré et ajusté le son, l'expérience commence.

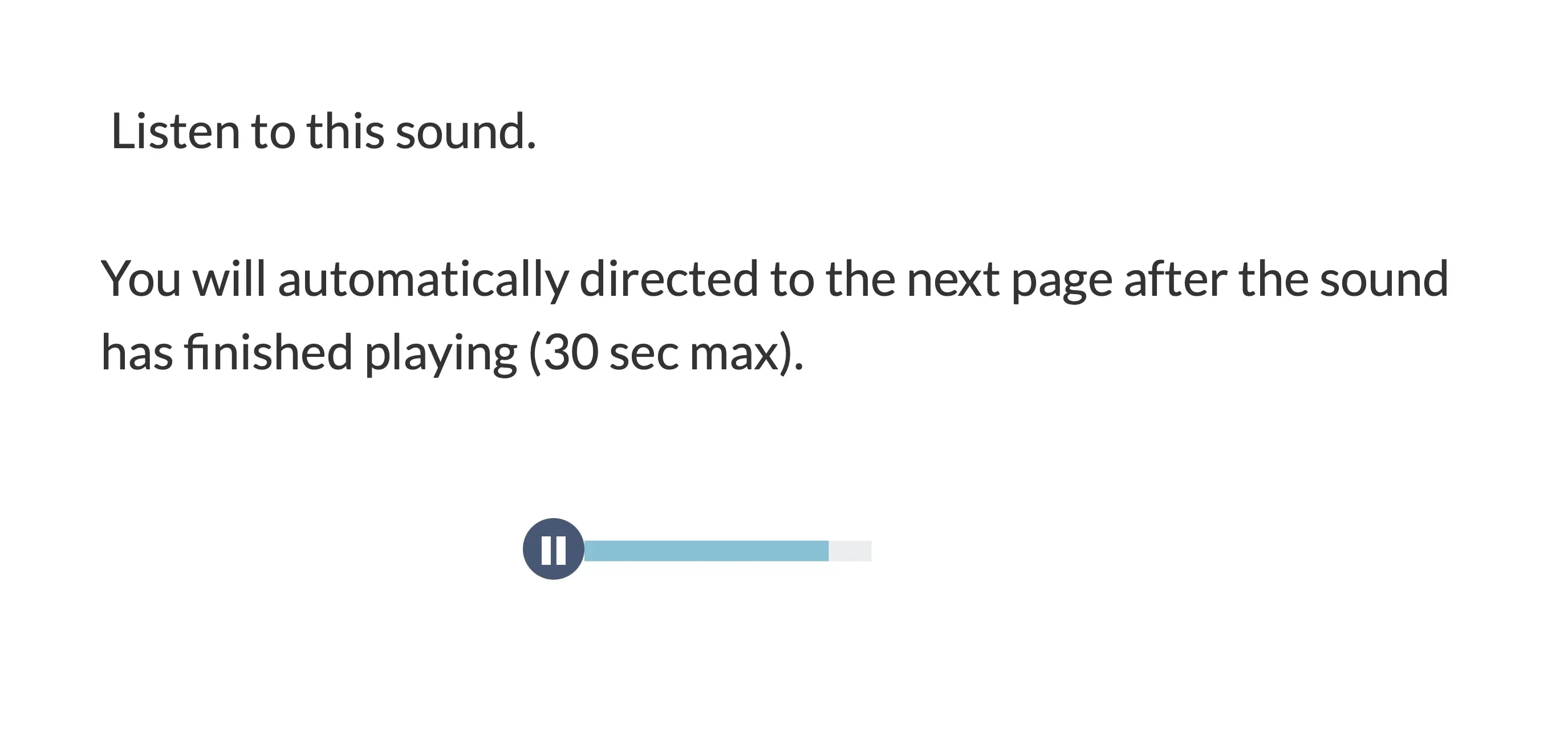

Le participant entend un son qui joue et dure environ 30 secondes :

Ensuite, après que le son ait été joué, le participant est invité à indiquer sur une échelle de Likert à 5 points dans quelle mesure certaines émotions et sentiments (comme la confiance, la tristesse ou la vigilance) ont été évoqués par l'audio :

Cette expérience est un excellent exemple de la façon de présenter des enregistrements audio, puis un questionnaire pour que le participant puisse fournir une réponse au son, à la langue ou à la vocalisation qu'il a perçue.

📌 Point de Publication : Préférences pour la voix chantée

L'objectif de l'étude était de prédire ce qui motive les préférences des participants lorsqu'ils 'aiment' un vocaliste en évaluant des caractéristiques perceptuelles et acoustiques, un sujet important dans le domaine de la psychologie de la préférence musicale.

Expérience Labvanced :

- Des évaluations perceptuelles ont été développées pour cette expérience sur des échelles bipolaires allant de 1 à 7 avec des mots d'ancrage contrastants à chaque pôle demandant aux participants d'évaluer les éléments suivants : précision de la hauteur, intensité, tempo, articulation, souffle, résonance, timbre, attaque/onset de voix, vibrato. Quarante-deux participants ont évalué 96 stimuli sur 10 échelles différentes

- Sous-échelle de 18 items de la Music Sophistication de l'Index de Sophistication Musical de Goldsmiths

- Inventaire de Personnalité en Dix Items (TPI)

- Test Révisé de Préférence Musicale (STOMP-R)

Principales conclusions : Les caractéristiques acoustiques et de bas niveau dérivées de la récupération d'informations musicales (MIR) expliquent à peine la variance dans les classements d'appréciation des participants. En revanche, les caractéristiques perceptuelles des voix ont atteint environ 43 % de prévision, suggérant que les préférences pour la voix chantée ne sont pas ancrées dans des attributs acoustiques en soi, mais plutôt par des caractéristiques perçues par les auditeurs. Cette découverte montre l'importance de la perception individuelle en ce qui concerne la psychologie de la préférence musicale. En savoir plus.

Référence : Bruder, C., Poeppel, D., & Larrouy-Maestri, P. (2024). Des caractéristiques perceptuelles (mais pas acoustiques) prédisent les préférences de voix chantée. Scientific reports, 14(1), 8977.

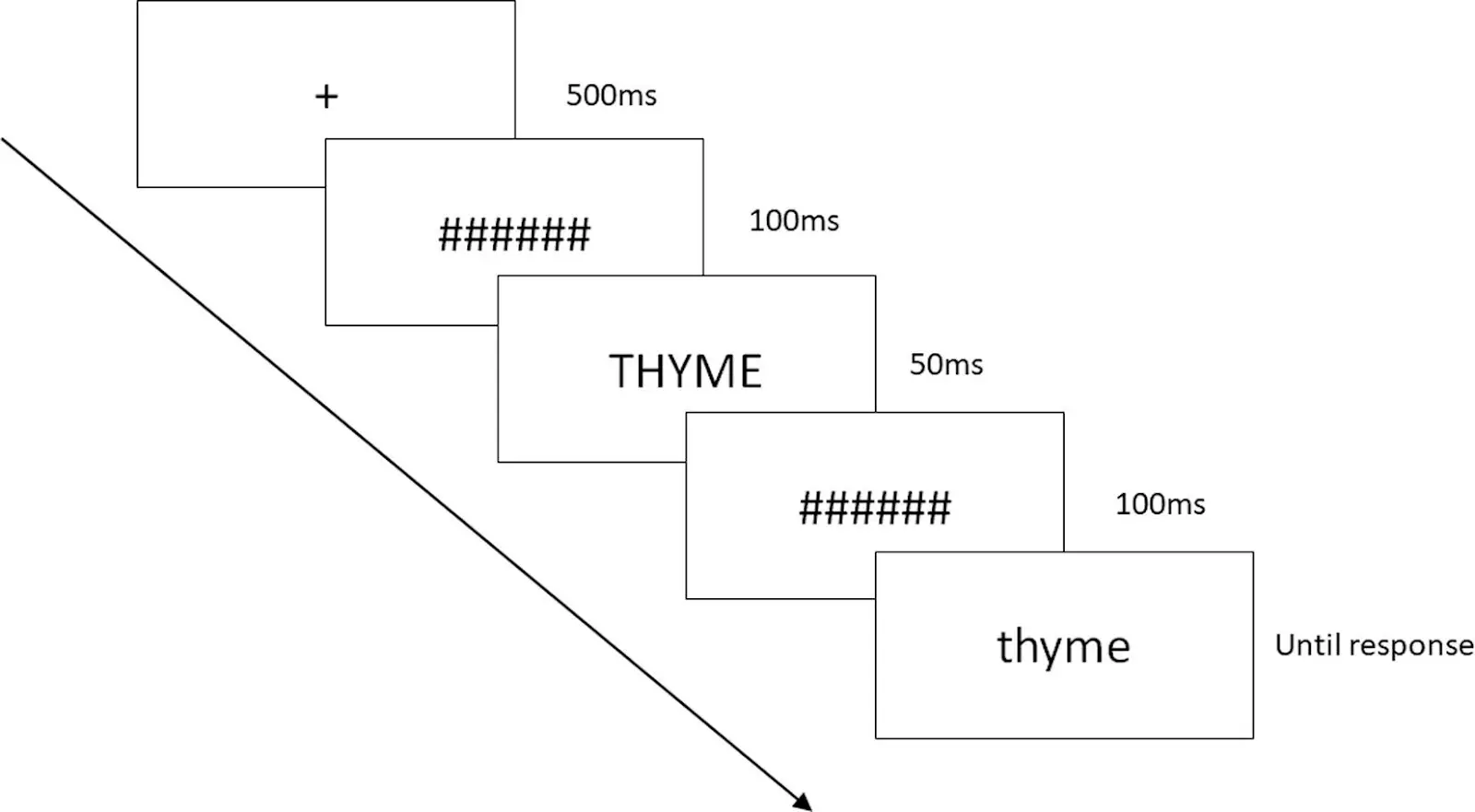

6. Tâches de Décision Lexicale

La Tâche de Décision Lexicale (TDL) est un autre excellent exemple d'une tâche basée sur la langue où les participants sont invités à indiquer si une chaîne de lettres présentée est un mot ou un non-mot dans la langue cible. Il existe plusieurs variations de la tâche de décision lexicale en raison de sa popularité dans le domaine. En savoir plus sur la TDL. ```markdown

📌 Mise en évidence de publication : Anosmie acquise et compréhension linguistique liée aux odeurs

Dans cette étude menée dans Labvanced, les chercheurs voulaient évaluer si l'anosmie acquise (la perte du sens de l'odorat survenant plus tard dans la vie) impacte la compréhension du langage lié aux odeurs. Les chercheurs ont administré une série de tâches, afin d'obtenir une image complète de la mémoire liée aux odeurs chez les anosmiques et les contrôles. Fait intéressant, l'étude a conclu qu'il n'y avait aucune preuve que l'anosmie acquise entrave la compréhension des mots liés aux odeurs ou aux saveurs, mais que les associations émotionnelles avec les mots liés aux odeurs et aux saveurs étaient altérées chez les anosmiques, avec des évaluations plus positives. Dans l'ensemble, ces résultats suggèrent que le traitement linguistique peut, dans certains cas, être indépendant de la capacité à avoir une expérience sensorielle olfactive.

Référence : Speed, L. J., Iravani, B., Lundström, J. N., & Majid, A. (2022). Perdre le sens de l'odorat n'entrave pas le traitement des mots liés aux odeurs. Brain and language, 235, 105200.

https://doi.org/10.1016/j.bandl.2022.105200 CC BY 4.0

7. Réseautage Sémantique

Dans cette étude psycholinguistique de l'Université Temple, les relations entre les mots sont évaluées. L'expérience est conçue pour tester la force des relations entre les mots (par exemple, sémantiques et phonologiques).

Les participants voient un mot, puis ils voient une séquence de lettres. Si la séquence de lettres signifie quelque chose dans la langue anglaise, le participant est invité à appuyer sur 'Y' au clavier, mais si la séquence de lettres ne signifie rien, alors 'N' doit être pressé.

Le design est simple et direct, mais il démontre comment recueillir les réponses des participants en utilisant des pressions de boutons après avoir présenté les mots visuellement dans une séquence particulière.

📌 Mise en évidence de publication : Suivi oculaire, langage et attention visuelle

Cette étude a examiné comment l'information sémantique, transmise par des mots ou des images, influence l'attention visuelle dans une tâche de signalement spatial. Les chercheurs ont utilisé le suivi oculaire par webcam de Labvanced comme vérification de validité pour s'assurer que les participants maintenaient une fixation centrale.

![]()

L'expérience a utilisé un design à mesures répétées et impliquait deux parties :

- Expérience 1 : Les participants ont vu soit de vrais mots soit des pseudomots comme primes, suivis d'un signal spatial les dirigeant vers une cible. L'objectif était d'évaluer comment ces primes influençaient la vitesse de détection de la cible.

- Expérience 2 : Les participants ont été présentés avec de vrais objets ou des pseudo-objets comme primes, qui correspondaient ou ne correspondaient pas à la cible. Cette expérience visait à explorer les effets de la congruence sémantique et perceptuelle sur l'engagement attentionnel et la détection de la cible.

Données collectées : Temps de réaction, données de suivi oculaire (fixations et schémas d'attention des participants), et détails sur les types de primes (vrais mots, pseudomots, objets connus, objets inconnus) et leur statut de correspondance (correspondance vs. non correspondance) avec les cibles.

Résultats : La connaissance sémantique, transmise par de vrais mots et objets, facilite significativement une détection plus rapide des cibles et améliore la capture attentionnelle, même lorsque les primes ne fournissent pas d'informations spatiales sur les cibles.

Référence : Calignano G, Lorenzoni A, Semeraro G et Navarrete E (2024) Mots avant images : le rôle du langage dans le biais de l'attention visuelle. Front. Psychol. 15:1439397.

8. Test de parole dans le bruit

Dans cette étude sur la parole dans le bruit, les chercheurs ont demandé aux participants de prendre part à une expérience dans Labvanced pour déterminer les mesures subjectives et objectives de la précision d'écoute et de l'effort. 67 participants, dont 42 ayant une audition normale et 25 avec une perte auditive, ont complété l'Échelle d'Évaluation de l'Effort (EAS) et une tâche de reconnaissance de phrases. Les phrases BKB ont été présentées dans un bruit de parole à des rapports signal/bruit (SNR) de -8, -4, 0, +4, +8, et +20 dB. Les participants ont répété les phrases à haute voix, et leurs réponses ont été enregistrées via webcam et notées par des assistants de recherche. L'étude a utilisé plusieurs mesures de résultats pour évaluer la précision et l'effort d'écoute, y compris l'intelligibilité objective, l'intelligibilité subjective, l'effort d'écoute subjectif, la tendance subjective à abandonner l'écoute et le temps de réponse verbal (VRT). L'effort d'écoute subjectif a été la première mesure à montrer une sensibilité à l'aggravation du SNR, suivi de l'intelligibilité subjective, de l'intelligibilité objective, de la tendance subjective à abandonner l'écoute, et de VRT.

Référence : Wiggins, I. M., Stacey, J. E., Naylor, G., & Saunders, G. H. (2025). Relations entre les mesures subjectives et objectives de la précision d'écoute et de l'effort dans une étude de parole en ligne dans le bruit. Ear and hearing, 10-1097.

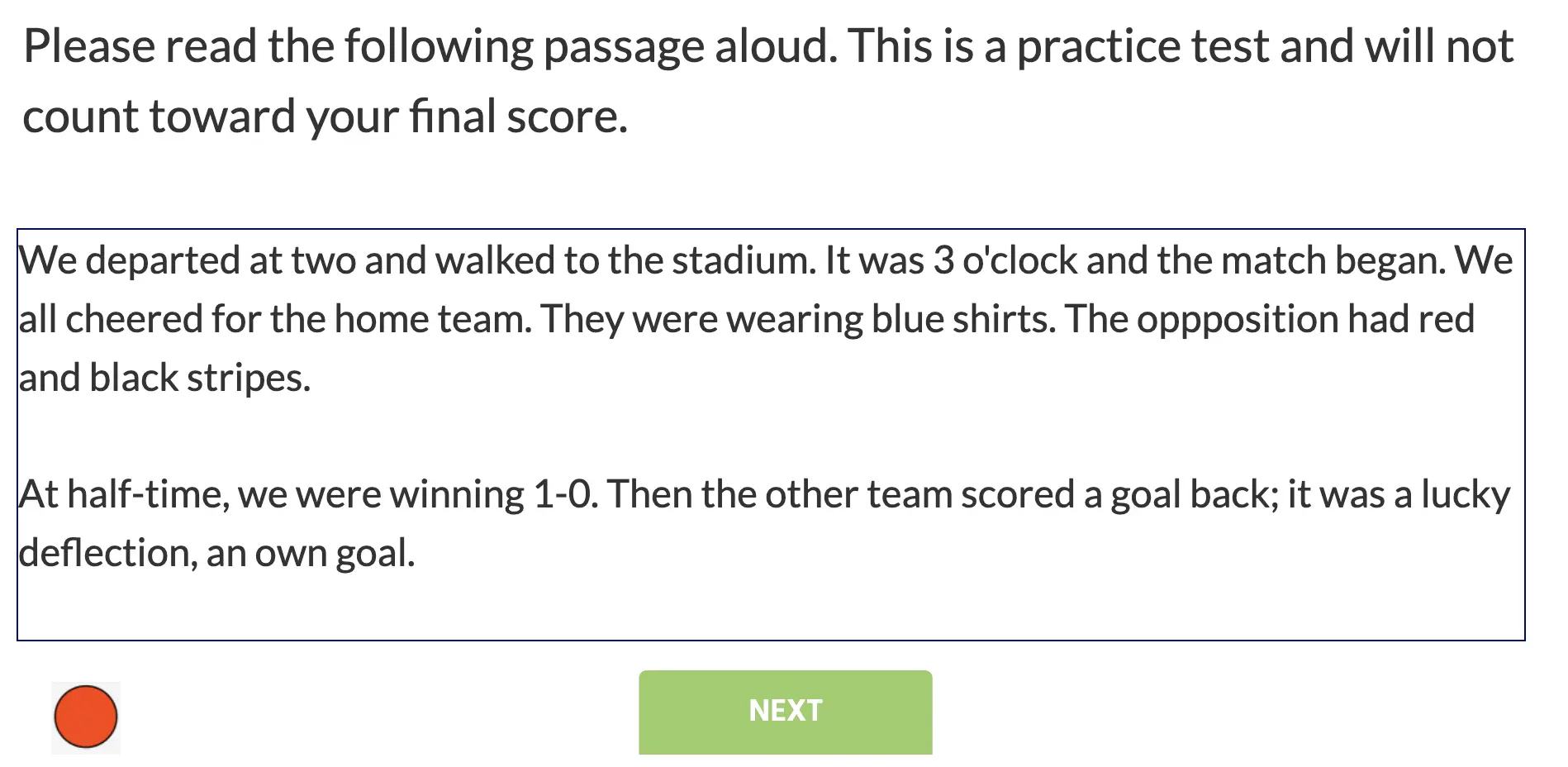

9. Test de lecture pour adultes

Le Test de lecture pour adultes de l'Université Nottingham Trent évalue la capacité d'une personne à lire un passage de texte à voix haute, en utilisant la fonctionnalité d'enregistrement vocal de Labvanced, puis à répondre à des questions sur le passage.

Avant de commencer la session d'entraînement, l'étude demande également aux participants de fournir leur adresse e-mail afin que les réponses d'une section précédente dans Labvanced puissent être liées.

Dans la session d'entraînement, le participant doit enregistrer sa voix en lisant le passage demandé à haute voix :

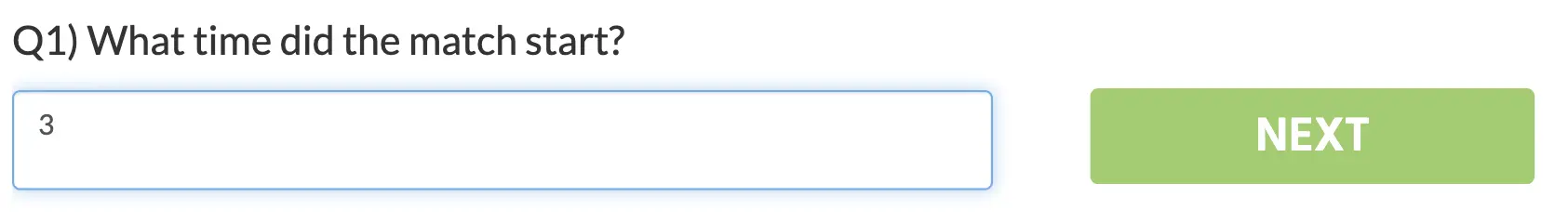

Après que l'enregistrement vocal ait été complété, une série de questions sur le passage suit :

Le Test de lecture pour adultes capture plusieurs types de mesures différentes, des enregistrements vocaux aux réponses aux questionnaires. C'est un excellent moyen de mesurer la compréhension et la maîtrise du langage et peut être adapté à d'autres langues et groupes de population.

Cette étude visait à comprendre comment les environnements de lecture numériques, avec des caractéristiques telles que le défilement et les liens hypertextes, affectent la compréhension de lecture des enfants.

Les chercheurs ont utilisé Labvanced pour :

* **Conception de tâche :** Elle incluait l'intégration de différentes conditions (clic, défilement, lien hypertexte et combiné).

* **Programmation des fonctionnalités de navigation :** Boutons de navigation (par exemple, suivant, précédent, retour à l'histoire) et fonctionnalités de lien hypertexte pour imiter les expériences de lecture numérique courantes.

* **Suivi des participants :** Facilitation de la participation à distance, permettant aux enfants de compléter les tâches depuis chez eux tout en étant surveillés par des assistants de recherche via des outils de vidéoconférence.

* **Collecte de données :** Métriques, telles que le temps passé par les participants à lire chaque passage, le temps pris pour faire référence au texte lors de la réponse aux questions, et la fréquence des activations du bouton de retour.

<!--

<p style="text-align:center;">

<img width="90%" height="auto" loading="lazy" style="border: 1px solid #39AECB;" src="/content_imgs/research/blog/2022-05-10-linguistic-experiments/krenca_reading_study.webp" alt="Test de lecture des adultes dans Labvanced"/>

</p>

-->

Les résultats ont montré que lorsque les enfants interagissaient avec des liens hypertextes survolés pour des définitions, cela avait un impact négatif sur leur compréhension de lecture, tandis que le défilement n'avait pas d'effets néfastes sur la compréhension.

<div class="section" style='background-color:#ECEDEF; color: #000000; border-left: solid #39AECB 4px; border-radius: 4px; padding:0.7em;'>

<span>

<p style='margin-left:1em;'>

<strong>Référence :</strong> Krenca, K., Taylor, E., & Deacon, S. H. (2024). Défilement et liens hypertextes : Les effets de deux fonctionnalités numériques prévalentes sur la compréhension de lecture numérique des enfants. <i>Journal of Research in Reading.</i> </p></span></div>

<br>

## 10. Tâche de sensibilisation prosodique

Une tâche de sensibilisation prosodique est conçue pour évaluer la capacité d'un individu à reconnaître et manipuler les caractéristiques prosodiques du langage. Dans la démonstration ci-dessous dans Labvanced, les participants sont invités à prononcer un mot puis à identifier où se trouve la syllabe accentuée dans ce mot.

<div class="video-block" style="pointer-events:none;">

<iframe max-width="100%" height="auto" loading="lazy" src="https://www.youtube.com/embed/9PrFj7Jjf_g?&autoplay=1&mute=1&controls=0&showinfo=0&loop=1&playlist=9PrFj7Jjf_g" frameborder="0"></iframe> </div>

## Exemples supplémentaires

### Édition dynamique de texte

Dans certains cas, vous pourriez être intéressé à déterminer comment les participants modifient activement un texte écrit. La vidéo ci-dessous montre comment vous pouvez suivre l'édition de texte en temps réel, y compris les clics de souris, les frappes et les modifications de paragraphe en utilisant Labvanced.

<div class="video-block">

<iframe max-width="100%" height="auto" loading="lazy" src="https://www.youtube.com/embed/eB-LvzmDakU?si=cJBiwXv6PiUlIheW" frameborder="0" allow="accelerometer; autoplay; clipboard-write; encrypted-media; gyroscope; picture-in-picture" allowfullscreen></iframe> </div>

Essayez cette [démonstration d'édition dynamique de texte,](https://www.labvanced.com/page/library/67925) comme indiqué ci-dessus, pour vous-même en cliquant sur le bouton `Participer` ou `L'importer` sur votre compte.

### Mesures de dépistage de l'audibilité

Dans certains cas, il peut être important de vérifier l'audibilité de base des stimuli auditifs avant de passer aux essais expérimentaux principaux. Dans cette étude comparant la faisabilité des tests neuropsychologiques à distance par rapport aux tests en face à face pour la recherche sur la démence.

La recherche a commencé par demander aux participants d'écouter un ensemble de 10 phrases de la liste Bamford-Kowal-Bench (BKB) dans Labvanced.

<p style="text-align:center;">

<img width="70%" height="auto" loading="lazy" style="border: 1px solid #39AECB;" src="/content_imgs/research/blog/2022-05-10-linguistic-experiments/bkb.webp" alt="Le test de mots BKB dans Labvanced pour la recherche sur la démence"/>

</p>

Dans l'exemple ci-dessus, la phrase prononcée était “Le moteur de la voiture tourne” et les participants devaient indiquer le dernier mot entendu. Pour chaque phrase, deux éléments trompeurs étaient affichés aux côtés de la cible, tous deux ayant du sens dans la phrase lorsqu’ils remplaçaient la cible. De plus, l'un des éléments trompeurs était également sélectionné pour rimer de manière lâche avec le mot cible (par exemple ici, ce serait "battement").

<div class="section" style='background-color:#ECEDEF; color: #000000; border-left: solid #39AECB 4px; border-radius: 4px; padding:0.7em;'>

<span>

<p style='margin-left:1em;'>

<strong>Référence :</strong> Requena-Komuro, M. C., Jiang, J., Dobson, L., Benhamou, E., Russell, L., Bond, R. L., ... & Hardy, C. J. (2022). Tests neuropsychologiques à distance par rapport aux tests en face à face pour la recherche sur la démence : une étude comparative chez des personnes atteintes de la maladie d'Alzheimer, de démence frontotemporale et de personnes âgées en bonne santé. <i>BMJ open, 12</i>(11), e064576.</p></span></div>

<br>

### Glisser et déposer des stimuli pour la catégorisation

Cette étude a mené des recherches sur les sons musicaux en déterminant comment les participants classeraient des extraits comme étant « semblables à la parole » ou « semblables à la musique ».

**Expérience Labvanced :** En utilisant 30 enregistrements de percussions dùndún (un tambour ouest-africain utilisé également comme substitut de parole), les participants devaient classer les enregistrements. Les chercheurs cherchaient à déterminer des prédicteurs potentiels des catégories musique-parole. 15 des enregistrements étaient traités comme de la « musique » et consistaient en des rythmes de Yorùbá àlùjó (danse), tandis que les 15 autres enregistrements étaient des « substituts de parole », contenant des proverbes et oríkì (poésie) Yorùbá. Les participants devaient faire glisser et déposer pour catégoriser les stimuli audio que les participants pouvaient écouter librement (voir l'image ci-dessous). Différents participants ont participé à chaque expérience.

Dans la première expérience, les catégories étaient fournies, à savoir « semblables à la parole » et « semblables à la musique ». Dans la deuxième expérience, les participants devaient déterminer eux-mêmes quelles seraient les deux catégories pour différencier les sons et les étiqueter par la suite.

<!--

<p style="text-align:center;">

<img width="90%" height="auto" loading="lazy" style="border: 1px solid #39AECB;" src="/content_imgs/research/blog/2022-05-10-linguistic-experiments/speech_music_linguistic_experiment.webp" alt="Dans cette expérience de linguistique, les chercheurs demandent aux participants de classifier si des extraits audio appartiennent aux catégories parole ou musique."/>

</p>

-->

**Résultats :** Le regroupement hiérarchique des regroupements de stimuli par les participants montre que la distinction parole/musique émerge et est observable, mais n'est pas primaire. Une analyse plus approfondie de la tâche de réponse libre a montré que les étiquettes attribuées par les participants convergent avec les prédicteurs acoustiques des catégories. Une telle découverte soutient l'effet de priming dans la discrimination entre la musique et la parole, et éclaire ainsi les mécanismes de catégorisation de tels signaux auditifs courants.

<div class="section" style='background-color:#ECEDEF; color: #000000; border-left: solid #39AECB 4px; border-radius: 4px; padding:0.7em;'>

<span>

<p style='margin-left:1em;'>

<strong>Référence :</strong> Fink, L., Hörster, M., Poeppel, D., Wald-Fuhrmann, M., & Larrouy-Maestri, P. (2023). Caractéristiques sous-jacentes à la parole et à la musique en tant que catégories d'expérience auditive. <i>Pré-impression.</i></p></span></div>

<br>

## Conclusion

Ensemble, ces 10 expériences linguistiques plus les exemples supplémentaires représentent non seulement ce que vous pouvez faire dans Labvanced, mais aussi comment des chercheurs de diverses universités étudient la parole et le langage, mais aussi la perception en utilisant des expériences en ligne pour enregistrer des données et des réponses.

[](https://www.labvanced.com/page/registerpage?refer=10leb)