Bevorzugter Blick Test

Der Bevorzugte Blick Test misst die visuelle Präferenz, indem er verfolgt, wohin die Teilnehmer ihren Blick lenken, wenn sie konkurrierende Reize präsentiert bekommen. Die Teilnehmer sehen mehrere Reize gleichzeitig, und ihr Blickverhalten wird verwendet, um Aufmerksamkeit und Wahl inferieren. Es wird häufig in der Entwicklungs- und kognitiven Forschung eingesetzt, um Wahrnehmung, Lernen und Aufmerksamkeit zu untersuchen.

Inhaltsverzeichnis

Aufgabenformat | Bevorzugter Blick Test Online & In-Lab

Im Bevorzugten Blick Test werden den Teilnehmern zwei Reize (sozial und nicht-sozial) nebeneinander präsentiert, während das Blickverhalten aufgezeichnet wird, um die visuelle Präferenz inferieren. Die Aufgabe integriert Eye Tracking und Kopfverfolgung für verbesserte Genauigkeit und Datenqualität, zudem ist eine optionale Webcam-Videoaufnahme für die nachträgliche Analyse verfügbar.

Die Vorlage unterstützt sowohl bildbasierte als auch videobasierte Stimulusformate. Die Bildversion präsentiert statische Reize, während die Video-Version dynamische Clips zeigt. Beide folgen demselben Betrachtungsverfahren und Datenaufbereitungspipeline.

Jede Sitzung beginnt mit einem kurzen Kalibrierungsprozess, um eine genaue Blickverfolgung zu gewährleisten. Ein optionaler Voraufgaben-Videoanruf kann hinzugefügt werden, um die Anweisungen mit den Teilnehmern zu überprüfen. Während der Versuche sehen die Teilnehmer die Reize auf natürliche Weise, ohne manuelle Reaktionen, während Blickbewegungen und Webcam-Video aufgezeichnet werden. Nach Abschluss der Versuche wird eine Ergebniszusammenfassung erstellt, die wichtige Blickmetriken zeigt.

Bevorzugte Blickaufgabe Metriken und gesammelte Daten

Die Bevorzugte Blickaufgabe erfasst eine Vielzahl von Verhaltens- und multimodalen Messungen, die zeigen, wie visuelle Aufmerksamkeit und natürliches Blickverhalten zwischen sozialen und nicht-sozialen Reizen verteilt sind. Mit vordefinierten Interessengebieten (AOIs) können Forscher quantifizieren, wie lange die Teilnehmer auf bestimmte Bereiche des Bildschirms achten.

Die aufgezeichneten Variablen ermöglichen es den Forschern, auf blickbasierten Metriken wie Fixationsdauer, Fixationsanzahl und Zeit bis zur ersten Fixation zu bewerten, neben Kopfverfolgungsmaßnahmen und synchronisierten Videoaufzeichnungen. Diese Maßnahmen helfen dabei, Aufmerksamkeitsbias, visuelles Engagement und Orientierungsverhalten während des passiven Betrachtens zu quantifizieren. Alle Variablen können im Variablen Tab der Aufgabe eingesehen und angepasst werden.

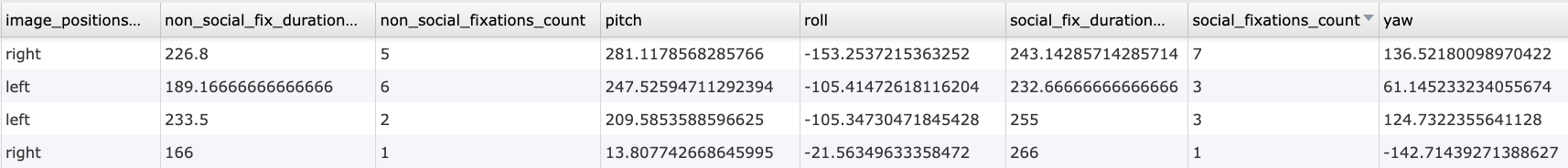

Nachfolgend sind Beispiele für Variablen aufgeführt, die in der Labvanced-Version der Bevorzugten Blickaufgabe gesammelt wurden:

| Variablenname | Beschreibung |

|---|---|

image_positions_NS | Position des nicht-sozialen Reizes (links / rechts) |

non_social_fix_duration_trial_mean | Gesamte Fixationsdauer auf nicht-soziale AOI |

non_social_fixations_count | Anzahl der Fixationen auf nicht-sozialen Reiz |

pitch | Vertikale Kopfbewegung (Grad) |

roll | Kopfneigung (Grad) |

yaw | Horizontale Kopfbewegung (Grad) |

social_fix_duration_trial_mean | Gesamte Fixationsdauer auf soziale AOI |

social_fixations_count | Anzahl der Fixationen auf sozialen Reiz |

Datentabelle mit einem Auszug individueller Versuchsergebnisse aus der Bevorzugten Blickaufgabe, einschließlich Fixationsdauer, Fixationsanzahl, Reizposition und Kopforientierungsmetriken.

Diese Studie misst visuelle Präferenz und Aufmerksamkeitsbias mithilfe von Blickverfolgung. Die Teilnehmer sehen soziale und nicht-soziale Reize, während Verhaltens-, Kopfbewegungs- und Videoaufzeichnungen zur Analyse erfasst werden.

Technologie für die Bevorzugte Blickaufgabe für Online- & In-Lab-Forschung

Labvanced umfasst mehrere Technologien, die die Bevorzugte Blickaufgabe hochgradig geeignet für Entwicklungs-, Fern- und multimodale Forschungen machen:

Webcam-Eye-Tracking: Messen Sie Blickrichtung, Fixationsdauer und Aufmerksamkeitsverschiebungen ohne spezielle Hardware.

Integration der Kopfverfolgung: Überwachen Sie die Positionierung und Kopfbewegung (Neigung, Gier, Roll) während des Betrachtens.

Attention Getter und Kalibrierungsunterstützung: Einschluss von Fixationshinweisen und Kalibrierungsschritten zur Verbesserung der Blickgenauigkeit, insbesondere für kinderfreundliche Designs.

Videoaufzeichnungsobjekt: Nehmen Sie Webcam-Video der Teilnehmer während der Aufgabe auf, um eine nachträgliche Kodierung und Verhaltensüberprüfung zu ermöglichen.

Video-Conference-Objekt: Ermöglichen Sie die Live-Interaktion mit Teilnehmern zur Anleitung von Einrichtung, Kalibrierung und Anweisungen.

Präzise Steuerung des Stimuluslayouts: Präsentation von nebeneinander stehenden Reizen mit kontrollierten Abständen, Ausrichtung und Größe.

Webbasierte und Desktop-Implementierung: Durchführung von Studien online oder in kontrollierten Laborumgebungen.

Unterstützung für Fern- und longitudinale Studien: Datensammlung über mehrere Sitzungen und Standorte mithilfe integrierter Werkzeuge.

Webcam-Eye-Tracking

Erfassen von Blickmustern und visueller Aufmerksamkeit mit integriertem, codefreiem und begutachtetem Webcam-Eye-Tracking.

Timing-Präzision

Erfassen von Reaktionszeiten, Aufgabenleistungen und mehr mit Millisekunden-Genauigkeit für zeitkritische Aufgaben.

Desktop-App

Durchführung von Laborstudien mit der Desktop-App, die mit EEG und anderer LSL-verbundener Laborhardware kompatibel ist.

Anpassung der Bevorzugten Blickaufgabe

Es gibt viele Möglichkeiten, diese Vorlage für die Bevorzugte Blickaufgabe anzupassen, um spezifische Forschungsfragen zu beantworten. Nachfolgend sind mehrere Anpassungsthemen aufgeführt, die Forscher häufig erkunden, wenn sie diese Aufgabe ändern.

Auswahl der Stimulusversion

Teilnehmer können bildbasierte oder videobasierte Versionen zugewiesen werden. Forscher können modifizieren, welche Version angezeigt wird, und die Anweisungen im Aufgabeneditor anpassen.

Stimulusinhalt und Präsentation

Nebeneinander stehende Reize können direkt unter Verwendung von Image Object oder Video Object ersetzt werden. Eigenschaften wie Größe, Position und Erscheinungsbild können im Object Properties-Panel angepasst werden.

Interessengebiete und Blickmetriken

Ansehregionen werden als Interessengebiete (AOIs) definiert. Eye-Tracking-Events referenzieren diese Regionen, um die Anzahl und Dauern von Fixationen zu berechnen.

Videoaufzeichnung und Konferenzablauf

Das Video Recording Object und das Video Conference Object können aktiviert, deaktiviert oder angepasst werden, um Aufzeichnungs- und Interaktionsphasen zu steuern.

Kalibrierung und Versuchstiming

Kalibrierungsverfahren, Betrachtungsdauern und Übergänge können durch Bildtiming und Events modifiziert werden.

Wenn Sie Hilfe bei der Anpassung dieser Aufgabe benötigen, zögern Sie bitte nicht, uns zu schreiben und zu fragen:

Empfohlene Verwendung und Anwendungen der Bevorzugten Blickaufgabe

Die Bevorzugte Blickaufgabe wird in verschiedenen Forschungsbereichen verwendet, die Wahrnehmung, Lernen und Aufmerksamkeit untersuchen.

Entwicklungsforschung: Wird verwendet, um Wahrnehmung und Lernen bei Säuglingen und kleinen Kindern durch Blickverhalten zu studieren.

Studien zum Sprachen- und Kategorienlernen: Untersucht, wie Teilnehmer visuelle Reize mit Geräuschen oder Kategorien assoziieren.

Forschung zu Aufmerksamkeit und visueller Präferenz: Untersucht, wie visuelle Merkmale Aufmerksamkeit und Präferenzen leiten.

Klinische und neuroentwicklungsbezogene Forschung: Wird verwendet, um atypische Blickmuster bei Entwicklungsbedingungen zu untersuchen.

Forschung zu sozialen und emotionalen Verarbeitungen: Untersucht die Präferenz für Gesichter, Ausdrücke und soziale Hinweise.

Referenzen

Teller, D. Y. (1979). Die Technik des erzwungenen Wahl-Verfahrens für den Einsatz bei menschlichen Säuglingen. Infant Behavior and Development, 2(2), 135–153.

Dubey, I., Brett, S., Ruta, L., Bishain, R., Chandran, S., Bhavnani, S., Belmonte, M. K., Estrin, G. L., Johnson, M., Gliga, T., Chakrabarti, B., & START-Konsortium (2022). Quantifizierung der Präferenz für soziale Reize bei kleinen Kindern mithilfe zweier Aufgaben auf einer mobilen Plattform. PLoS One, 17(6), e0265587.